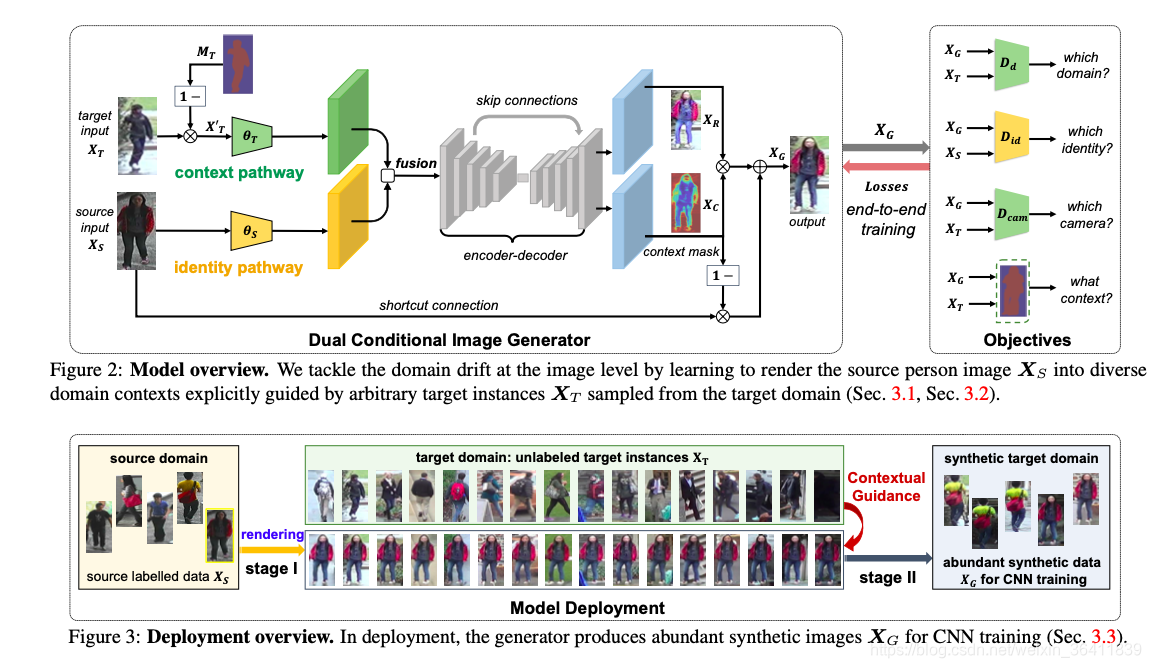

- Instance-Guided Context Rendering for Cross-Domain Person Re-Identification

Idea:使用U-net网络,生成源域行人图像和目标域背景相结合的多张图像,扩充数据集的延展性。是一件非常有意义的事情。

判别器:使用了四个判别器帮助网络进行训练,

Adversarial Loss,Camera Loss,Context Loss,Identity Loss

- Adaptive Transfer Network for Cross-Domain Person Re-Identification

这篇文章的特殊之处在于,是从三个方面进行如下转换,使用了三个CycleGAN分别生成光照差异、摄像头角度差异、分辨率差异。在此基础上,利用三者进行风格迁移。突破了数据集之间跨域的问题,直接将所有数据集都转换成为了三种风格。

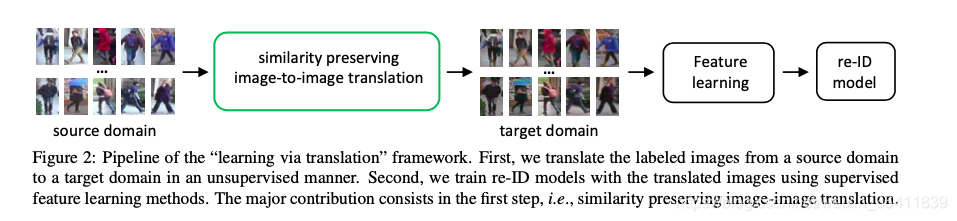

3, Image-Image Domain Adaptation with Preserved Self-Similarity and Domain-Dissimilarity for Person Re-identification

早期基于CycleGAN的风格迁移模型,主要是

SPGAN = CycleGAN + L(ide)+L(con)

问题:从文中生成样本的图示中,可以看出转换后的行人style并没有非常明显的风格转换,行人的前景和背景并没有很大的变化。因为我的理解是,跨域的风格转换,应该是保证行人的前景不变,背景的风格应该有所转变,随意这篇文章的意义不是很懂。

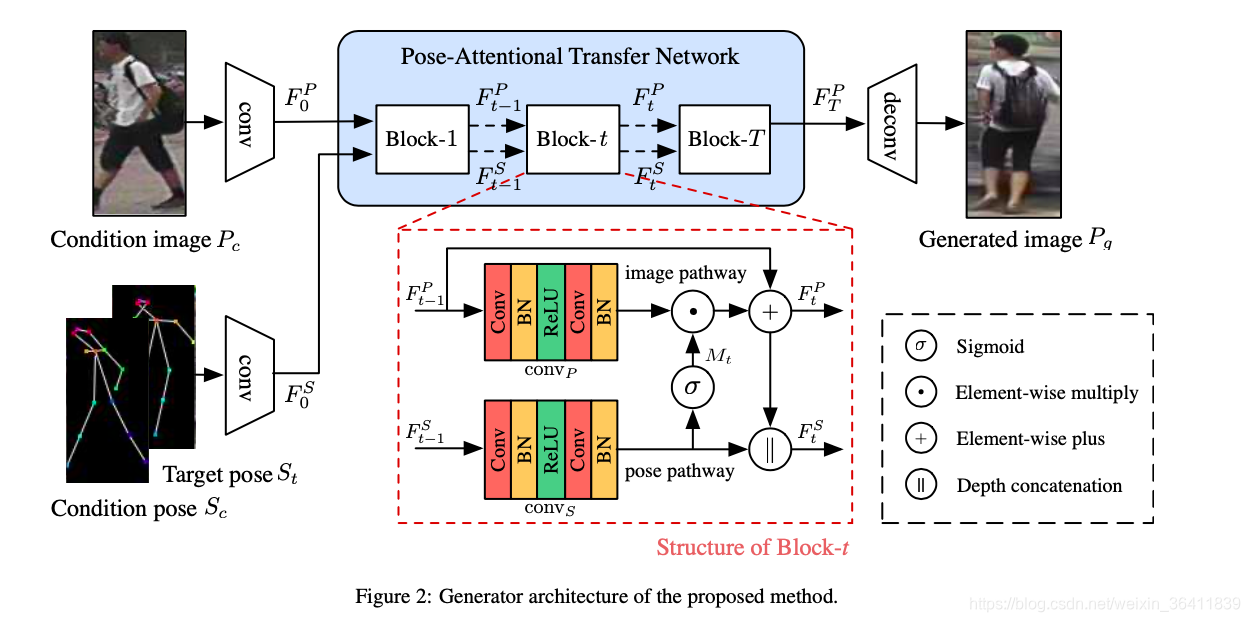

4,Progressive Pose Attention Transfer for Person Image Generation(详解)

文章的主要贡献,是设计了一个渐进式的姿态转移注意力机制模块,并使用这个这个模块作为生成器。

文章主要思想:使用注意力机制更好的关注到行人姿态的兴趣区域,引导生成器更好的关注行人的外观特征表示和姿态特征表示。

- 设计了一个姿态注意力机制网络(Pose-Attention Transfer Network),重点关注pose机制

- 更新image feature的同时,也在更新pose feature

- 设计了两个判别器,一个判别图像,一个判别姿态