行人重识别之多维度数据库风格迁移

Adaptive Transfer Network for Cross-Domain Person Re-Identification

原文链接

之前研读的数据库风格迁移方面的文章,直接使用cyclegan对风格进行迁移,外加一些损失函数进行约束。这篇文章对数据库之间差异的原因进行分析并分为三类:光照差异、摄像头角度差异、分辨率差异。在此基础上,利用三者进行风格迁移。

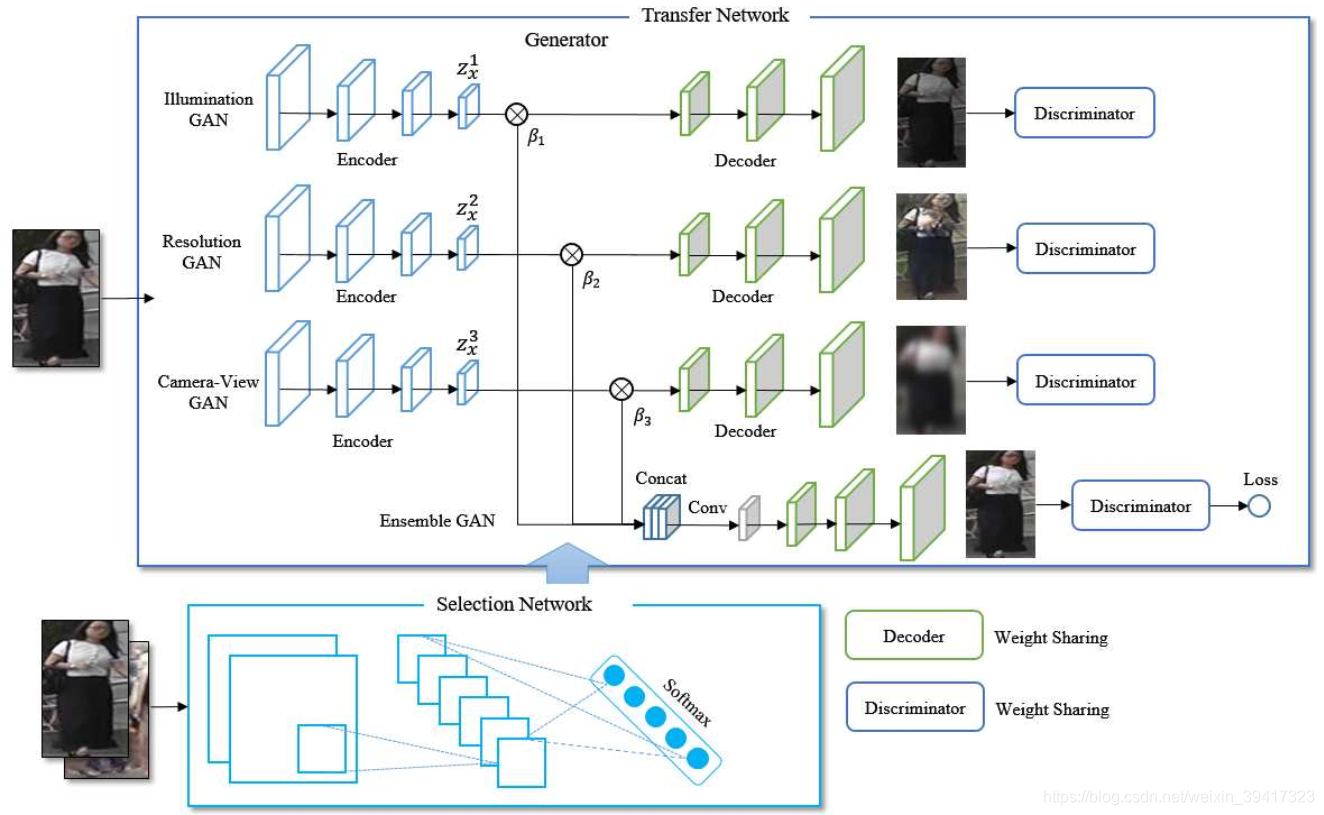

如图所示,是使用本文框架进行风格迁移的三个例子。可以看出,使用三个cyclegan实现光照、摄像头视角、分辨率的风格迁移,然后对其赋予不同的权重,从而合成最后的迁移图像。

其具体框架如下图:

使用编码器提取三个维度的特征z,然后根据图下的网络计算出的权重对三个特征加权连接,生成新的图像。

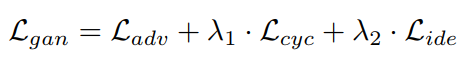

与其它论文类似,每一个gan网络的损失函数由三部分组成,gan的损失,cyclegan的损失,类内标签损失。这里再解释一下类内标签损失,即生成后的图像和原图像还是同一个人的特征。损失函数如下所示:

权重计算方法:

作者认为,三个gan对应的损失越大,那么该图像的这个维度与生成的图像的关联越小。所以,在训练的过程中,作者使用损失的倒数作为三个维度的权重,以获得训练时的标签。训练的输入是图像对,一张来自源域,一张来自目标域。

总结:这篇文章从三个角度进行数据风格迁移,是一个亮点。然而在一些细节方面介绍的实在不够清楚,可能是受困于会议文章的长度。

完

欢迎讨论 欢迎吐槽