文章目录

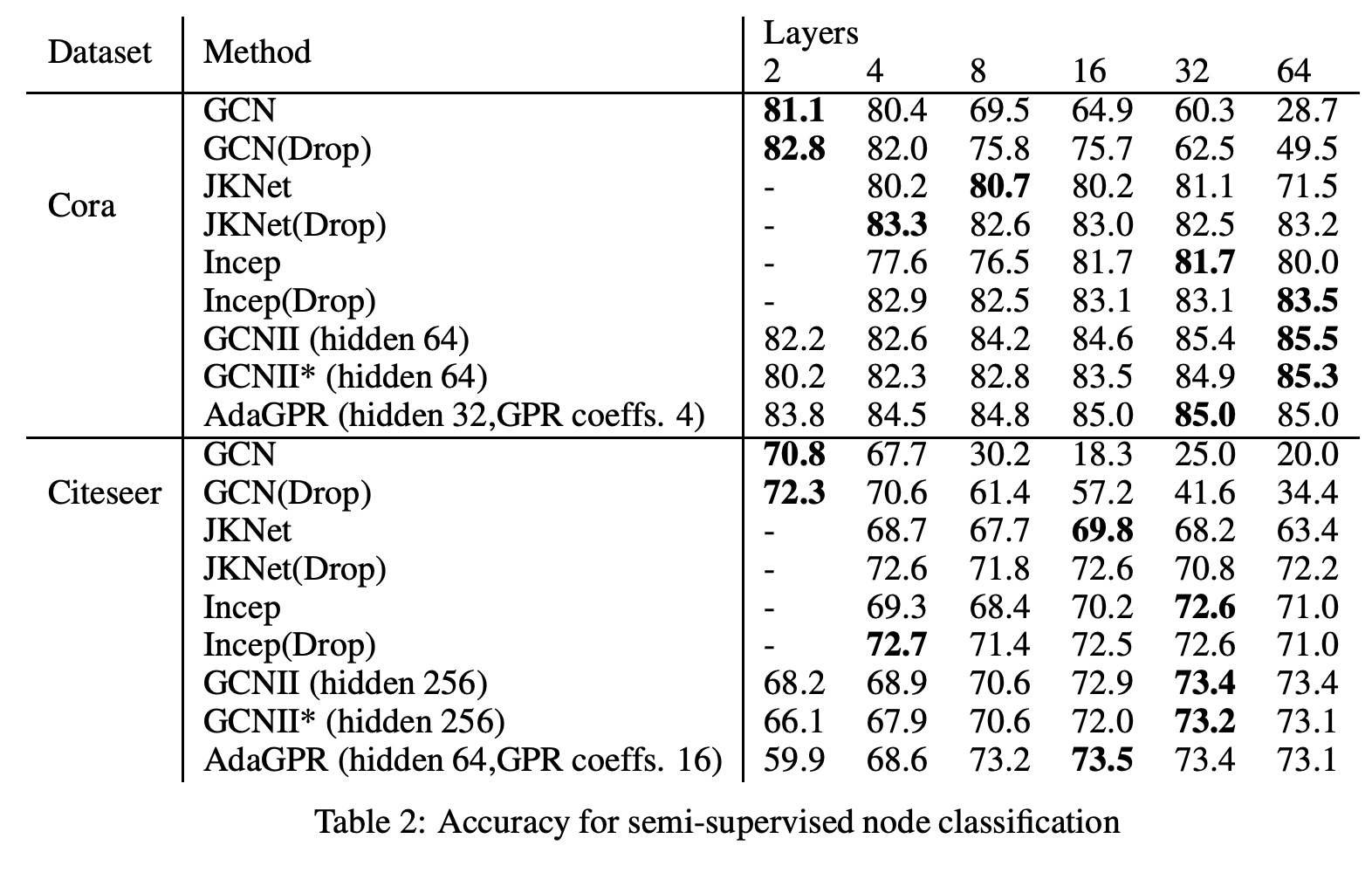

一、AdaGPR

AdaGPR 是一种自适应的分层图卷积模型。 AdaGPR 通过学习使用稀疏求解器预测广义 Pagerank 的系数,在 GCNII 模型的每一层应用自适应广义 Pagerank。

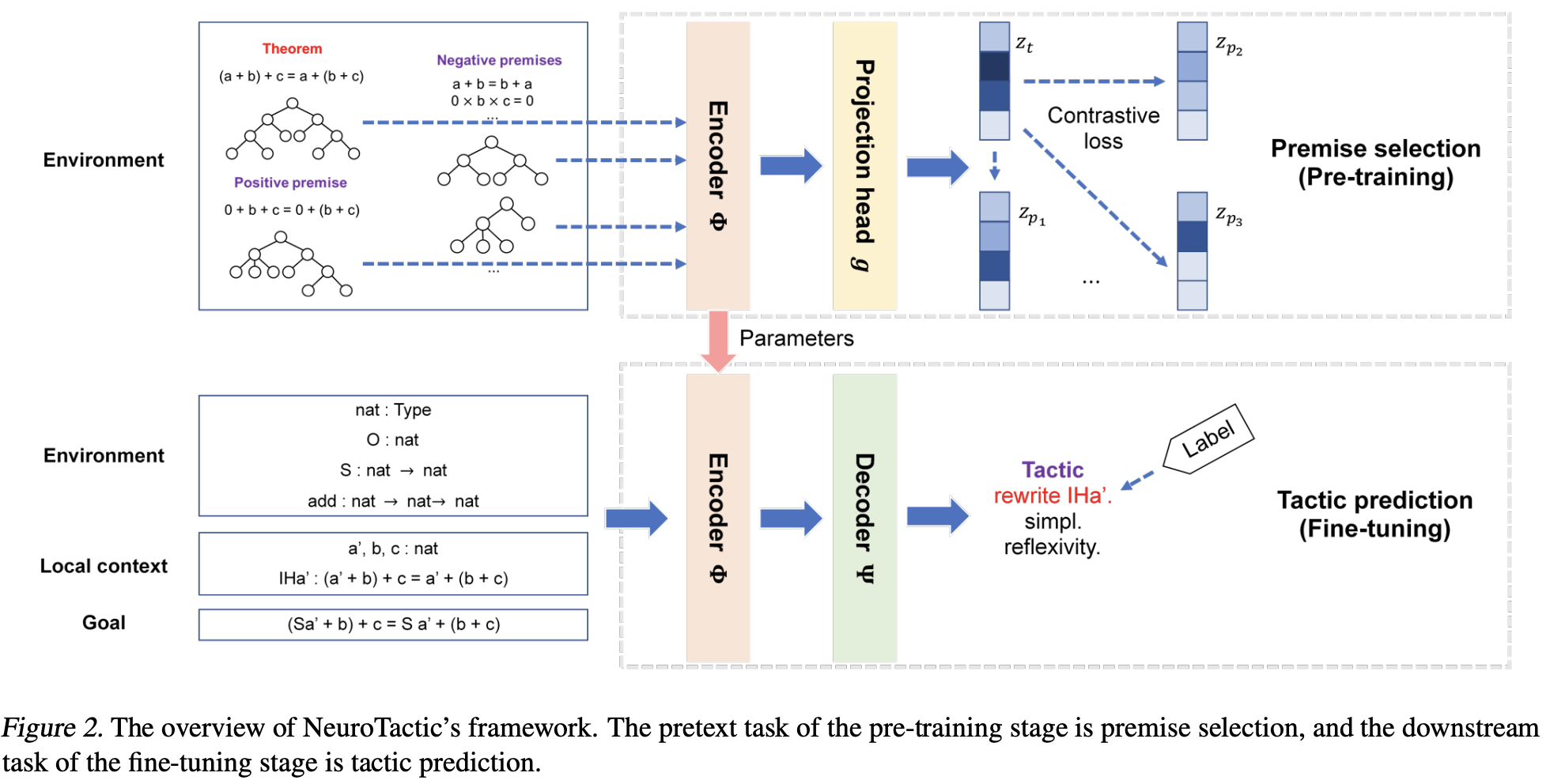

二、NeuroTactic

NeuroTactic 是一种定理证明模型,它利用图神经网络来表示定理和前提,并应用图对比学习进行预训练。 具体来说,前提选择被设计为图对比学习方法的借口任务。 然后将学习到的表示用于下游任务,即策略预测

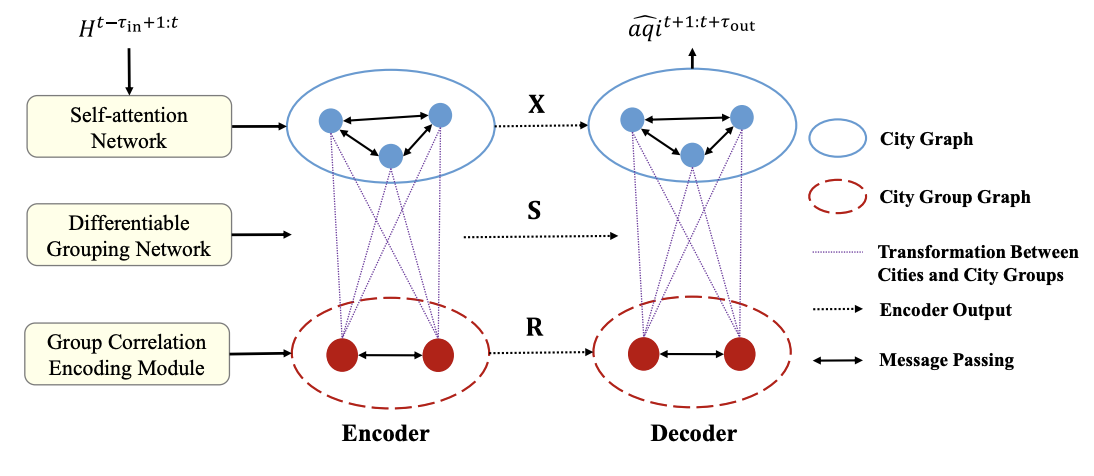

三、Group-Aware Neural Network(GAGNN)

GAGNN(群体感知图神经网络)是用于全国城市空气质量预测的分层模型。 该模型构建了城市图和城市群图,分别对城市之间的空间依赖关系和潜在依赖关系进行建模。 GAGNN引入可微分组网络来发现城市之间的潜在依赖关系并生成城市组。 基于生成的城市组,引入组相关性编码模块来学习它们之间的相关性,可以有效捕获城市组之间的依赖关系。 图构建完成后,GAGNN 实现消息传递机制来建模城市和城市群之间的依赖关系。

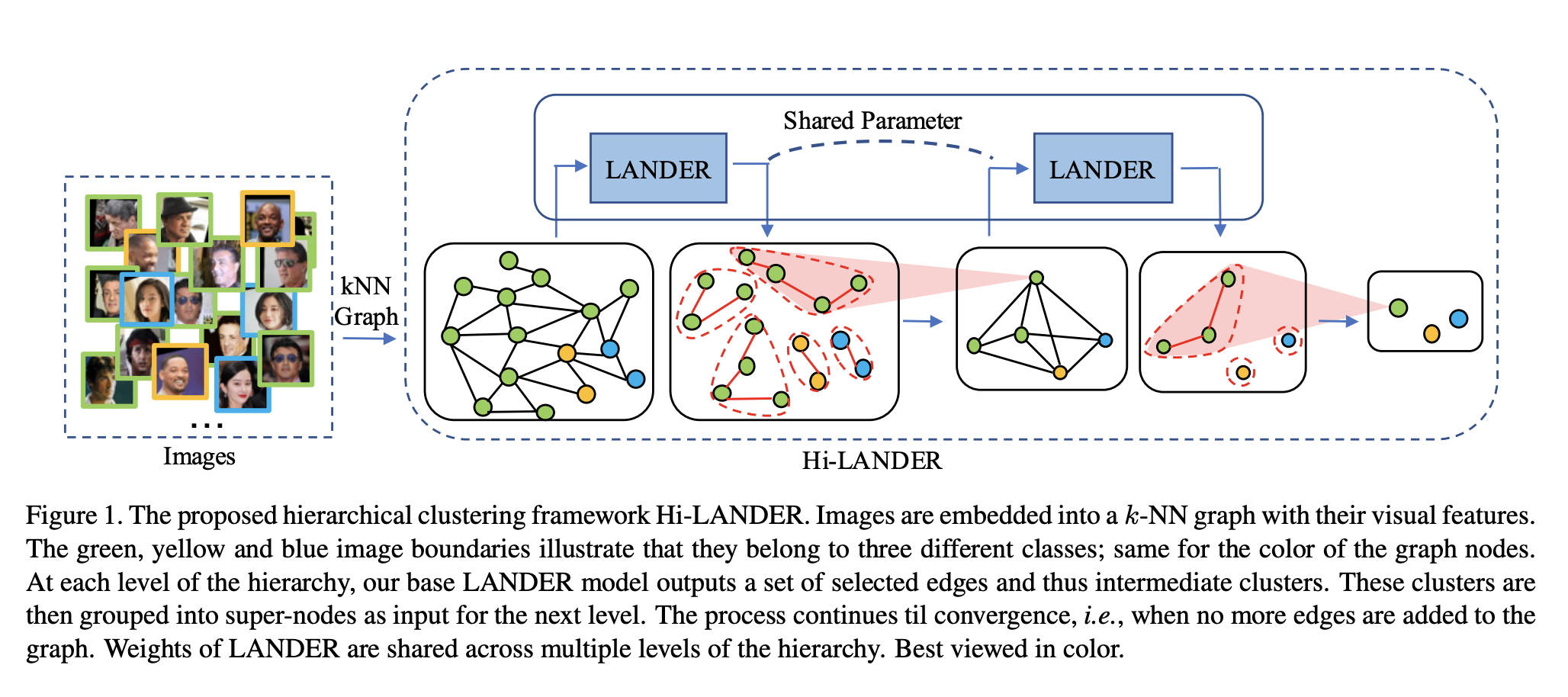

四、Hi-LANDER

Hi-LANDER 是一种分层图神经网络 (GNN) 模型,它学习如何使用带有属于不相交身份集的标签注释的图像,将一组图像聚类为未知数量的身份。 分层 GNN 使用一种方法来合并在分层结构的每个级别预测的连接组件,以在下一个级别形成新的图。 与完全无监督的层次聚类不同,分组和复杂性标准的选择自然源于训练集中的监督。

五、CayleyNet

CayleyNet 的核心成分是一类新型参数有理复函数(凯莱多项式),允许在专门针对感兴趣频段的图上高效计算频谱滤波器。 该模型生成丰富的光谱滤波器,这些滤波器在空间中局部化,与稀疏连接图的输入数据的大小线性缩放,并且可以处理拉普拉斯算子的不同结构。

六、Dual Graph Convolutional Networks

双图卷积神经网络共同考虑半监督学习的两个基本假设:(1)局部一致性和(2)全局一致性。 因此,设计了两个卷积神经网络来分别嵌入基于局部一致性和全局一致性的知识。

七、PGC-DGCNN

PGC-DGCNN 提供了图卷积滤波器的新定义。 它概括了最常用的过滤器,添加了一个控制所考虑邻域距离的超参数。 该模型遵循从众所周知的多维张量卷积滤波器得出的直觉,扩展了图卷积。 这些方法涉及一种简单、高效且有效的方法来在图卷积上引入影响滤波器大小的超参数,即其在所考虑的图上的感受野。

八、StoGCN

StoGCN 是一种基于控制变量的算法,允许对任意小的邻居大小进行采样。 为算法收敛到GCN的局部最优提供了新的理论保证。

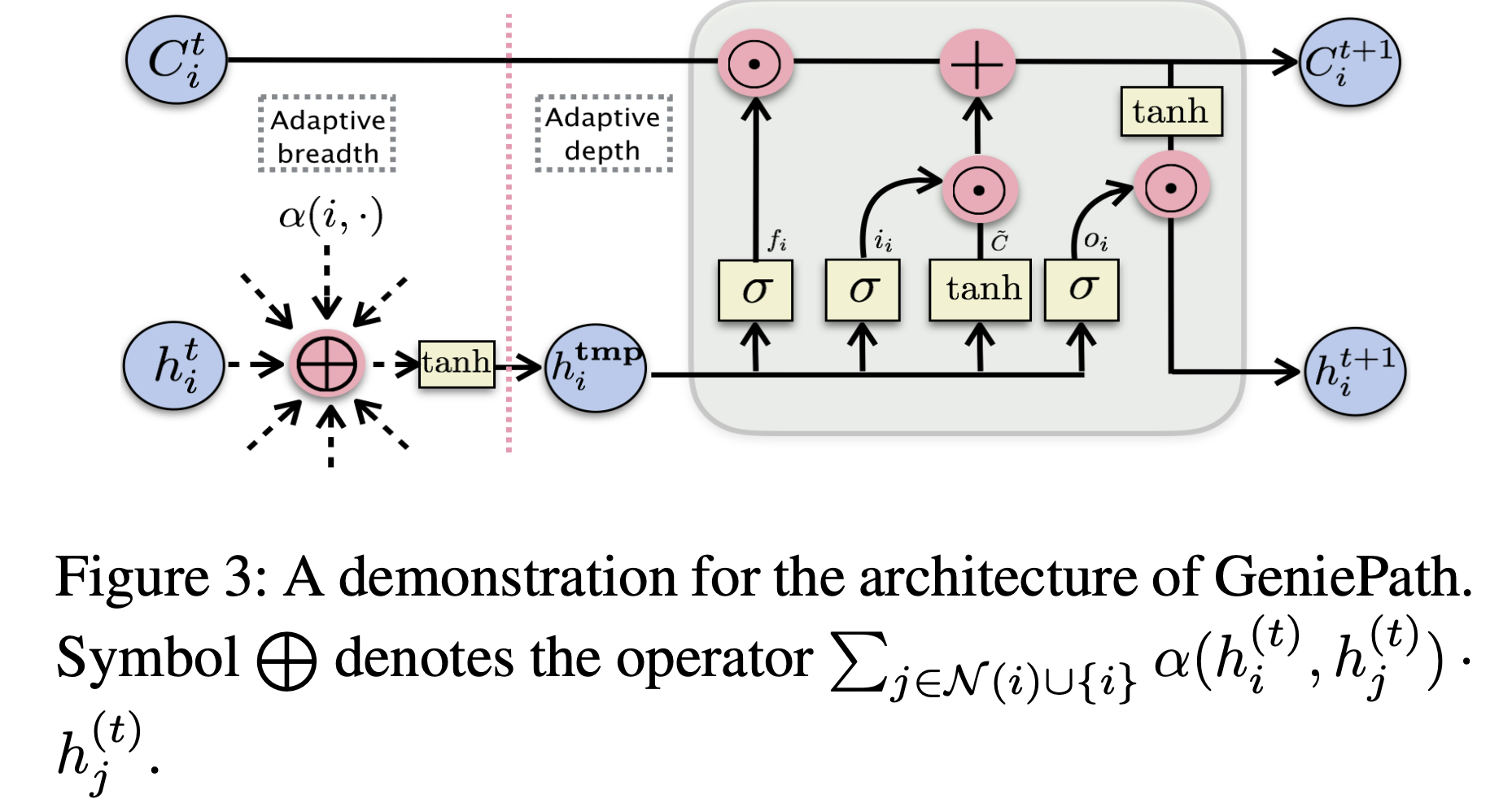

九、GeniePath

GeniePath 是一种可扩展的方法,用于学习在排列不变图数据上定义的神经网络的自适应感受野。 在 GeniePath 中,我们提出了一个自适应路径层,它由两个分别为广度和深度探索设计的互补函数组成,前者学习不同大小邻域的重要性,而后者提取和过滤从不同跳数的邻居聚合的信号。

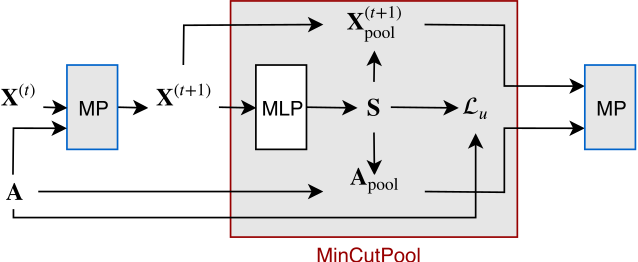

十、MinCut Pooling

MinCutPool 是一个可训练的图池运算符,它学习将节点映射到集群中。 该方法经过训练以近似图的最小 K 割,以确保集群平衡,同时还共同优化当前任务的目标。

十一、Spectral Gap Rewiring Layer

TL;DR:GAP-Layer 是一个 GNN 层,它能够以归纳、无参数的方式重新连接图,优化谱间隙(最小化或最大化瓶颈大小),学习一种可微分的方法来计算 Fiedler 向量和 图的费德勒值。

概括

GAP-Layer 是一个基于以归纳方式最小化或最大化光谱间隙(或图瓶颈大小)的重新布线层。 根据我们想要在图表中执行的挖掘任务,我们希望最大化或最小化瓶颈的大小,旨在建立更多连接或更多分离的社区。

GAP层:光谱间隙重新布线

十二、Automated Graph Learning

自动化图学习是一种旨在发现不同图任务/数据的最佳超参数和神经架构配置的方法,无需手动设计。

十三、Graph Echo State Network

图回声状态网络(GraphESN)模型是图域回声状态网络(ESN)方法的推广。 GraphESN 提供了一种有效的递归神经网络 (RecNN) 建模方法,可扩展以处理循环/非循环、有向/无向、标记图。 网络的循环存储库在图上计算固定的收缩编码函数,并且在初始化后不进行训练,而前馈读出实现自适应线性输出函数。 状态转移函数的收缩性意味着状态动力学的马尔可夫特征以及循环存在下状态计算的稳定性。 由于使用固定(未经训练)编码,该模型既代表了极其高效的版本,又代表了具有经过训练的连接的递归模型的性能基线。

十四、Neural network for graphs

NN4G 基于具有状态变量的建设性前馈架构,该架构使用没有反馈连接的神经元。 通过一般的遍历过程将神经元应用于输入图,该遍历过程放宽了通过分层输入数据的因果关系假设导出的先前方法的约束。