笔记目录(部分笔者省略)

Unity Style Transfer for Person Re-Identification

arXiv:2003.02068v1 [cs.CV] 4 Mar 2020

行人重识别的一致风格转移

注:限于作者水平,本笔记难免存在不妥之处,欢迎批评指正

Abstract

现有工作视图用camera-invariant descriptor subspace learning来解决风格差异问题。

缺点:当取自不同摄像机的图片间差异更大时将会产生更多的人工图片。

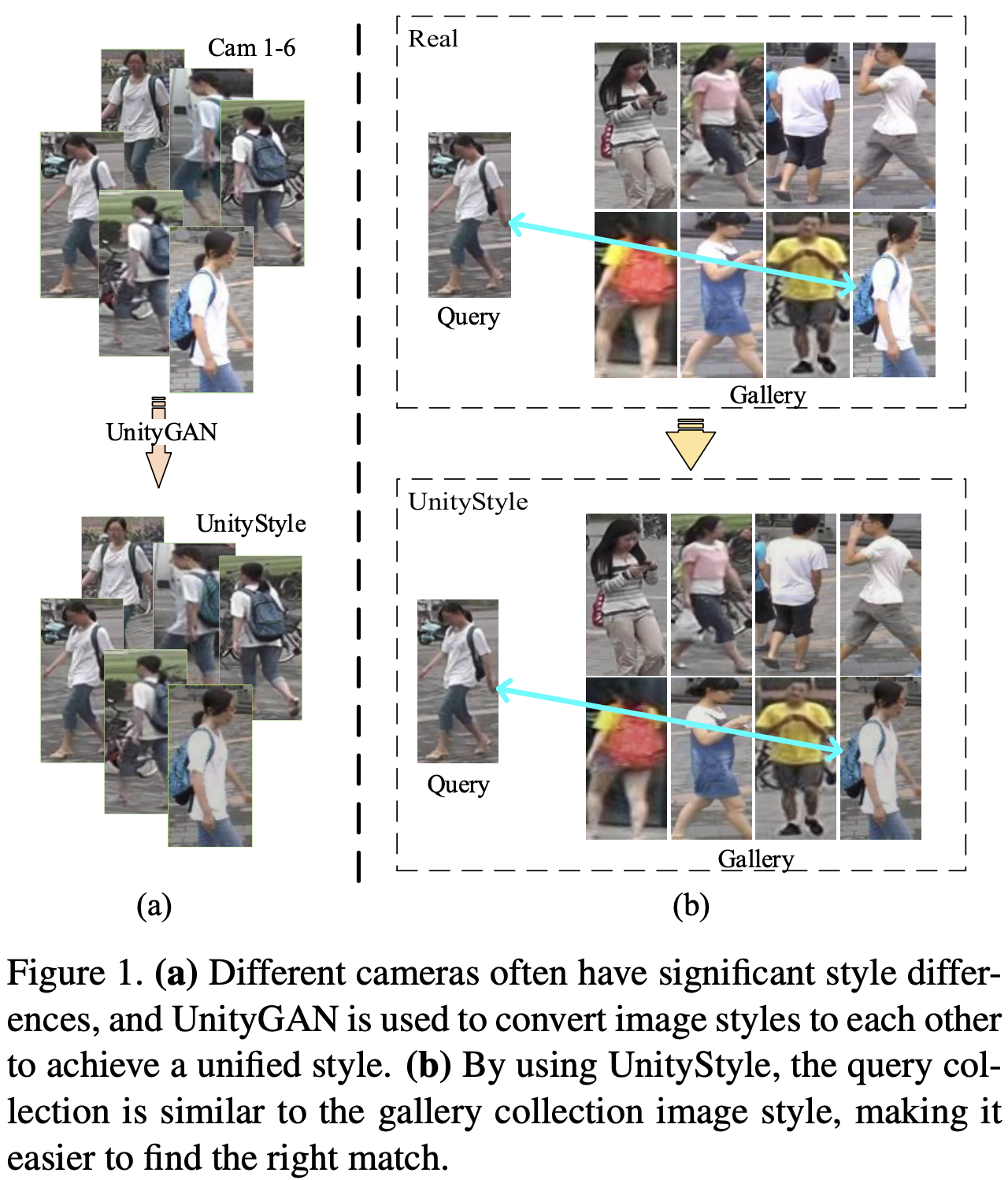

本文提出一个一致风格适应方法,该方法可以平滑相同和不同摄像机间的风格不一致。

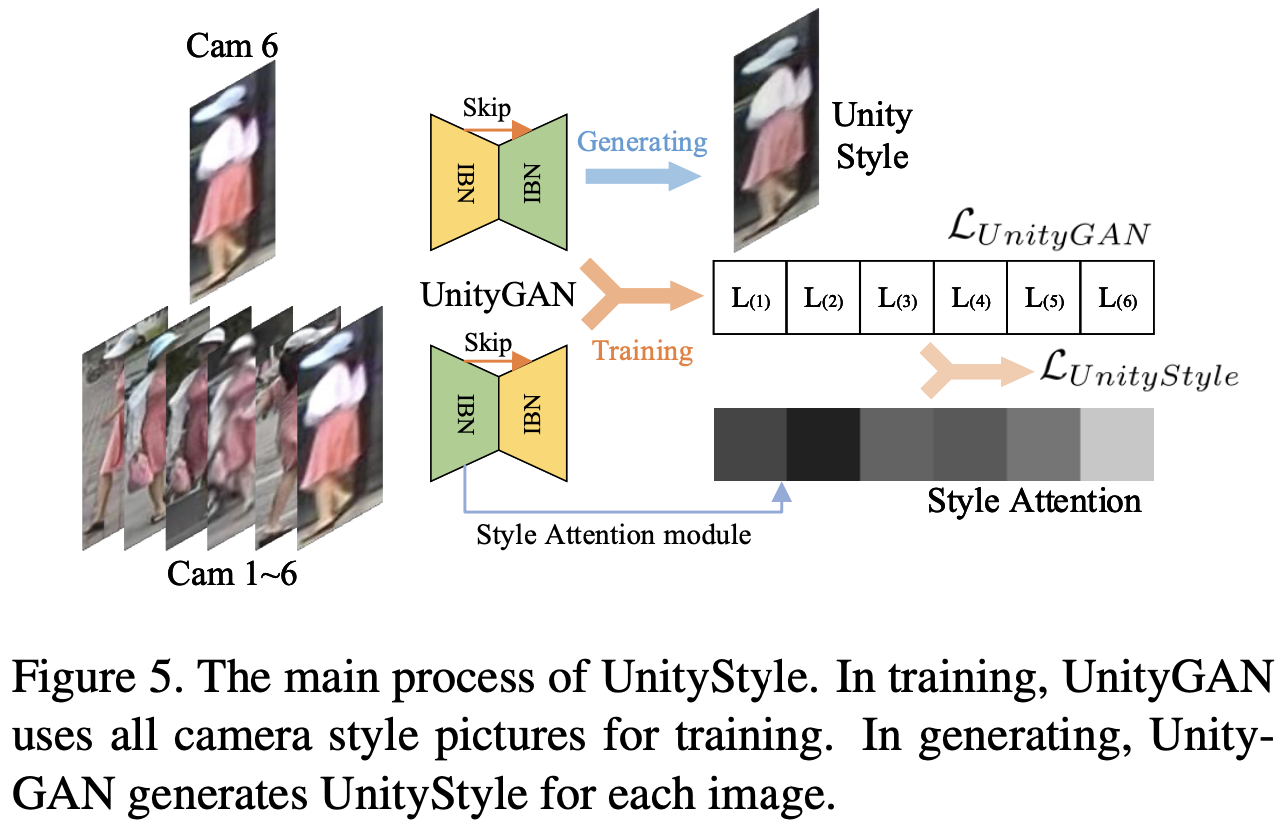

创建UnityGAN来学习摄像机间的风格变化,生成对于每个摄像机形状稳定的风格一致的图片,被称为UnityStyle images。

同时使用UnityStyle images消除不同图片的风格差异以在query and gallery间达成更优匹配。

1.Introduction

CamStyle使用GANs去学习不同摄像机之间的风格不一致,然后通过风格转移方法加强数据。

本文从CamStyle出发,并优化了CamStyle的4个主要问题。

将CycleGAN做简单变形,成为UnityGAN,生成的风格一致图片具有更高质量。

将真实图片和UnityStyle images一同作为训练集新的数据补充。

2.3IBN-Net

Batch Normalization(BN)提升图片内容特征的敏感度。

Instance Normalization(IN)提升风格类变化的鲁棒性。

shallow features与风格有关,deep features与high-level features(content features例如面部、姿势)有关。

本文方法的条件设置:

IN只用于shallow network,不用于deep network,原因是IN提取的特征削弱了图片间的差异,不能放置在deep layer去影响分类效果。

shallow BN layer依旧保持,以确保内容相关的信息能平滑地传递到deep layer。

3.1UnityGAN

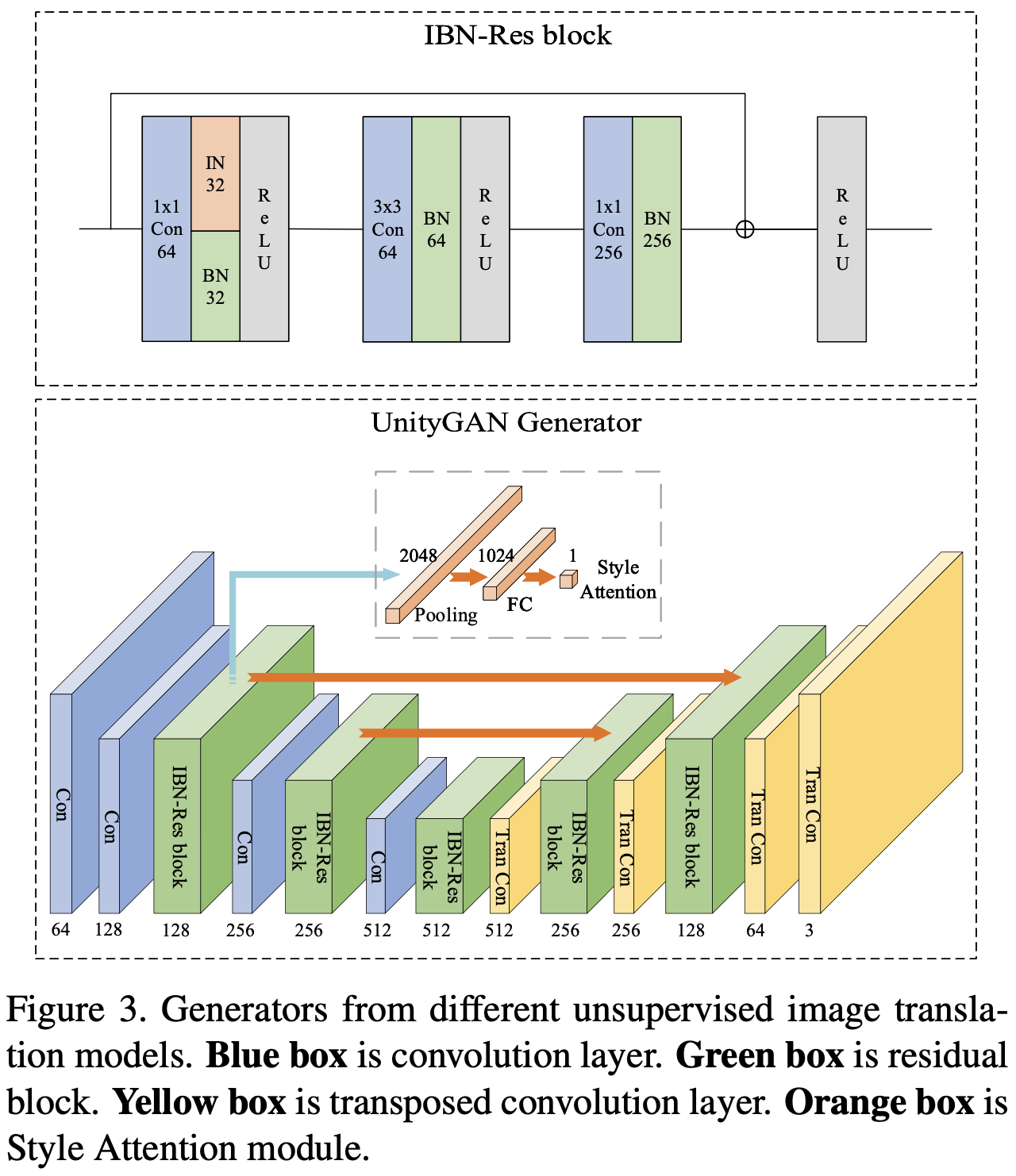

UnityGAN结合DiscoGAN和CycleGAN并改善它们。

创建IBN-Res block,增加风格变化鲁棒性的同时保持结构信息。

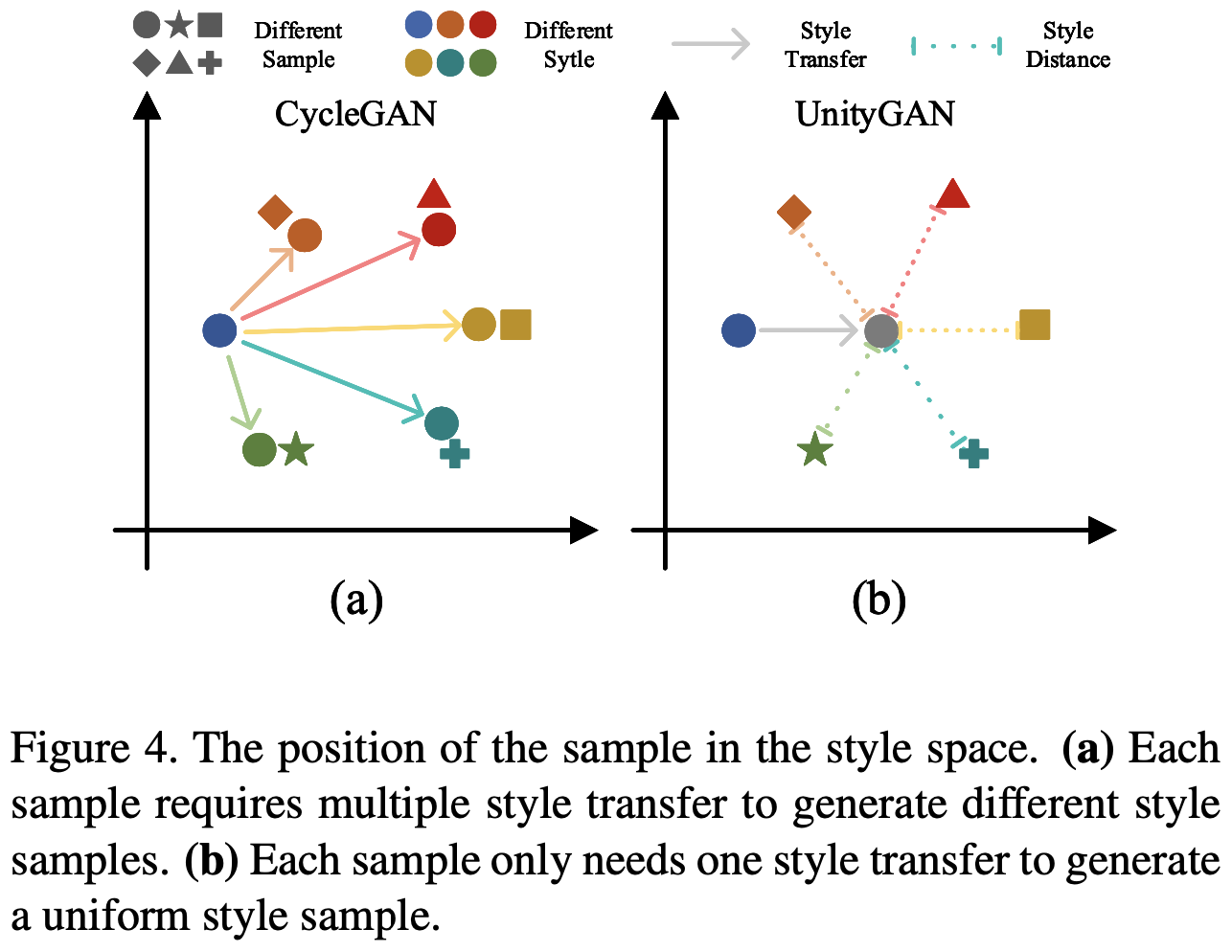

不同于CycleGAN,UnityGAN尝试生成一个混合所有风格的图片,无需为每个风格学习一个转移。

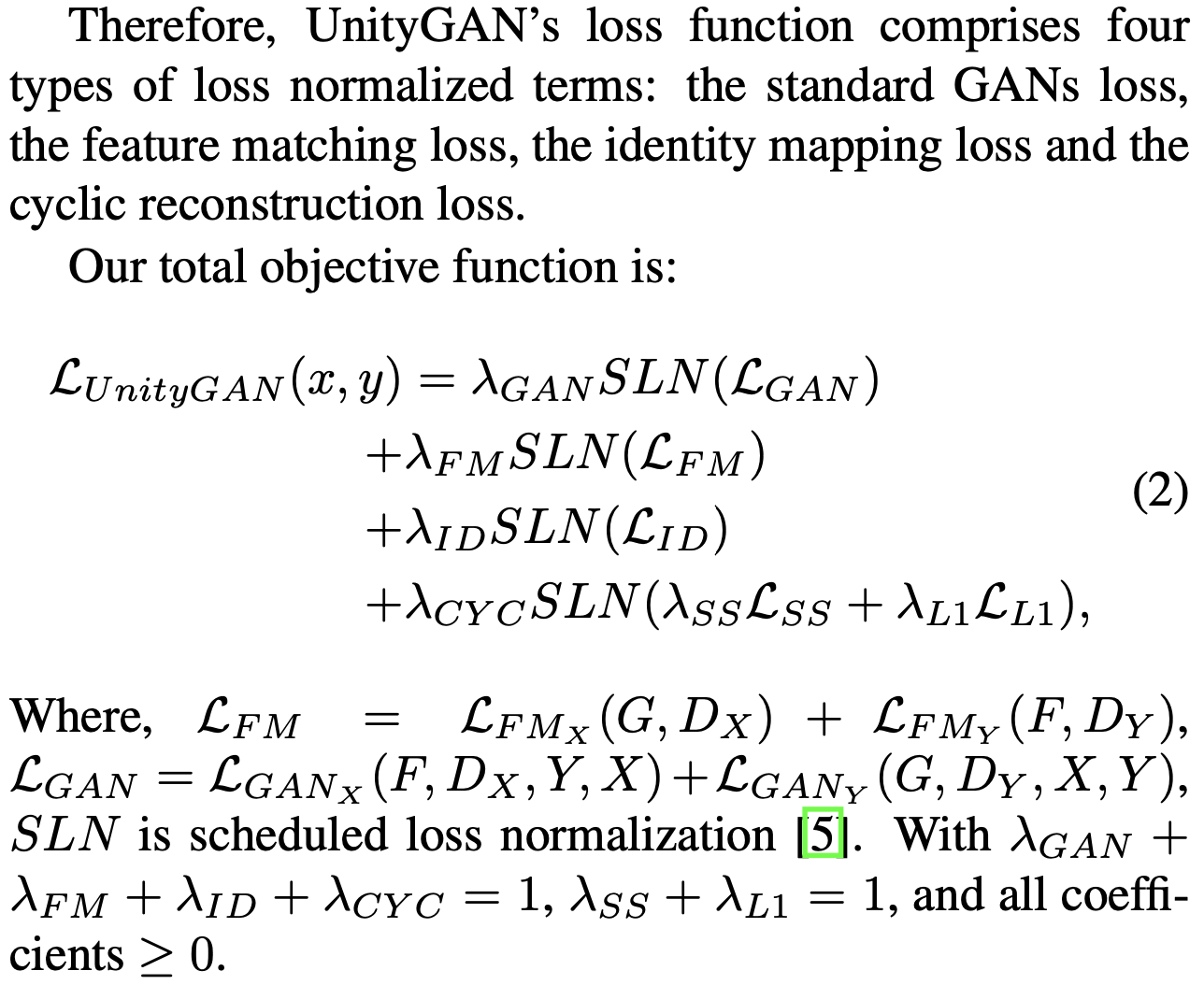

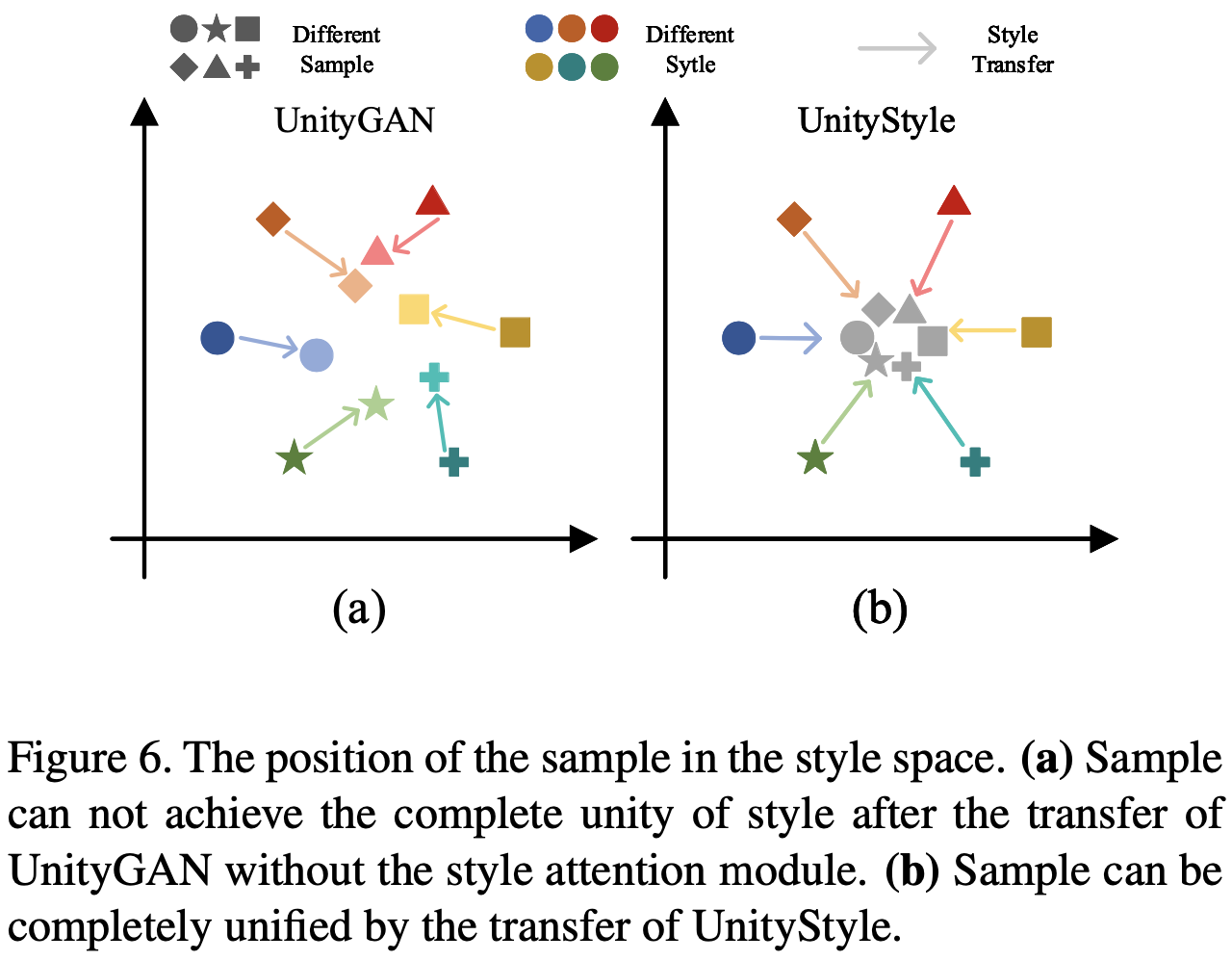

UnityGAN能生成结构稳定的图片并且减少训练模型的数量,但生成的图片在风格上不稳定,提出UnityStyle loss function解决该问题。

3.2UnityStyle

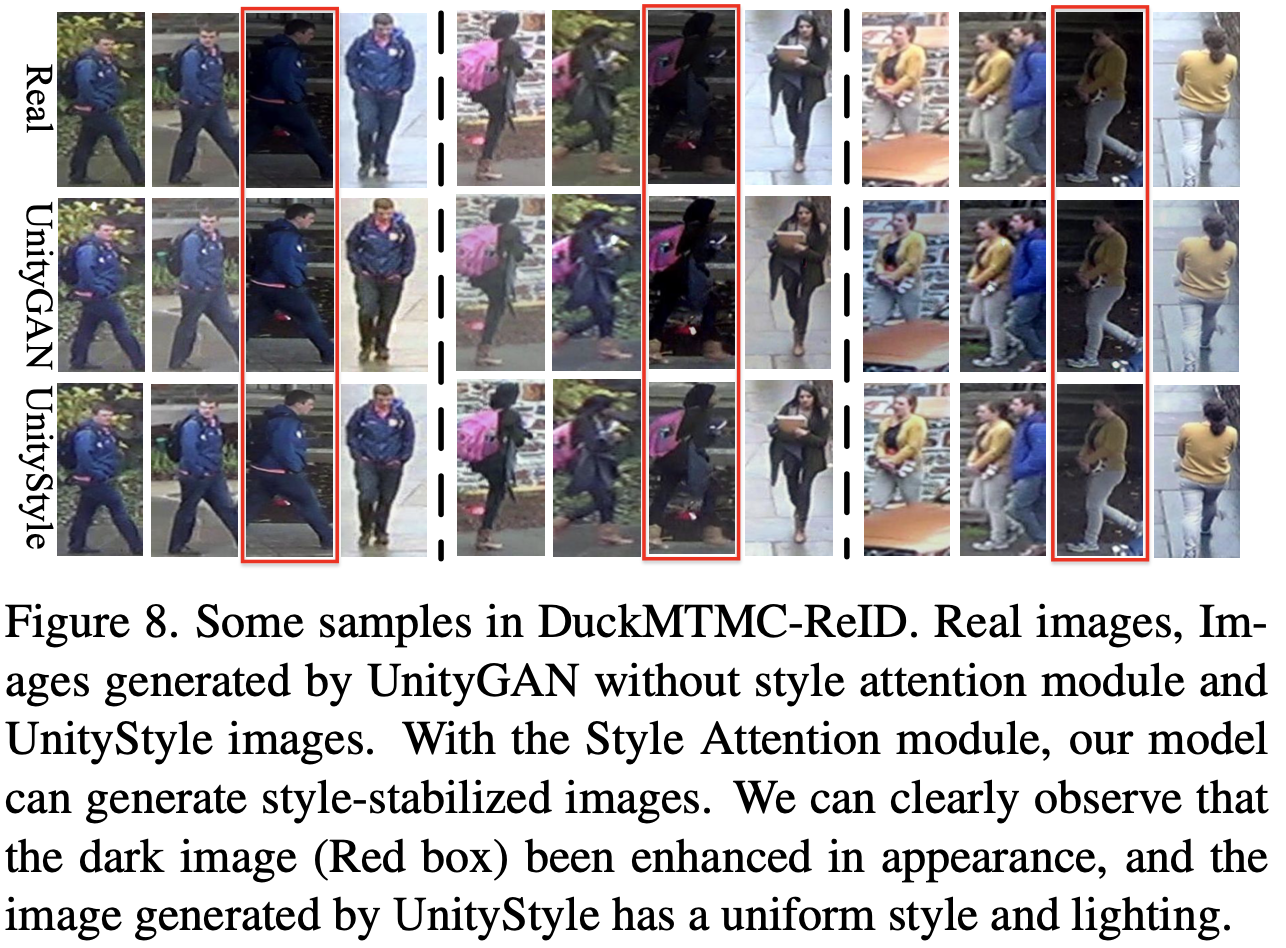

在UnityGAN Generator上添加Style Attention module。

Attention square颜色越浅,相应图片风格离一致风格越远,所占权重越小,确保对生成图片风格影响更小。

风格信息主要包含在shallow layer,这也是为什么本文将Style Attention module加在shallow layer的原因。

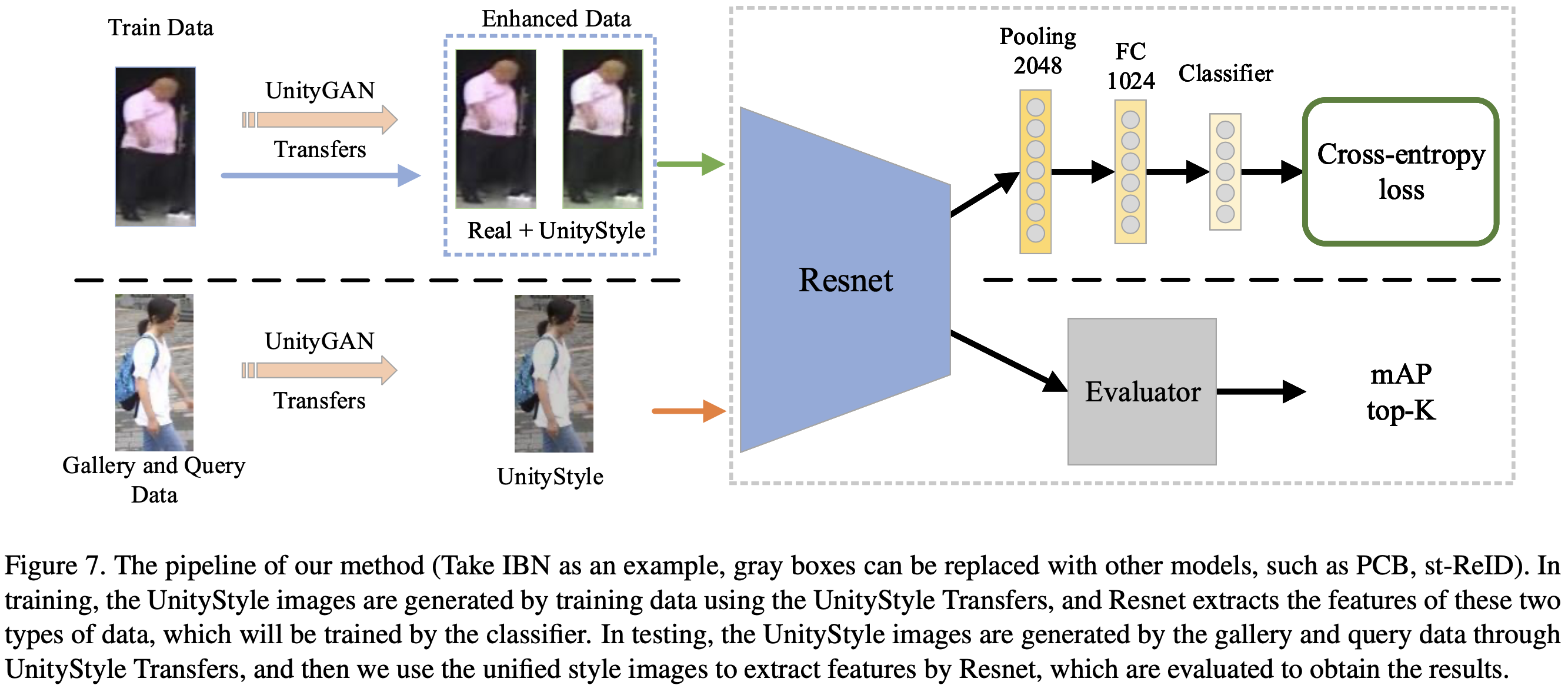

3.4.1Training

将加强训练集的图片作为输入,所有输入图片尺寸设置为256x128。

随机取N个真实图片和N个UnityStyle图片。

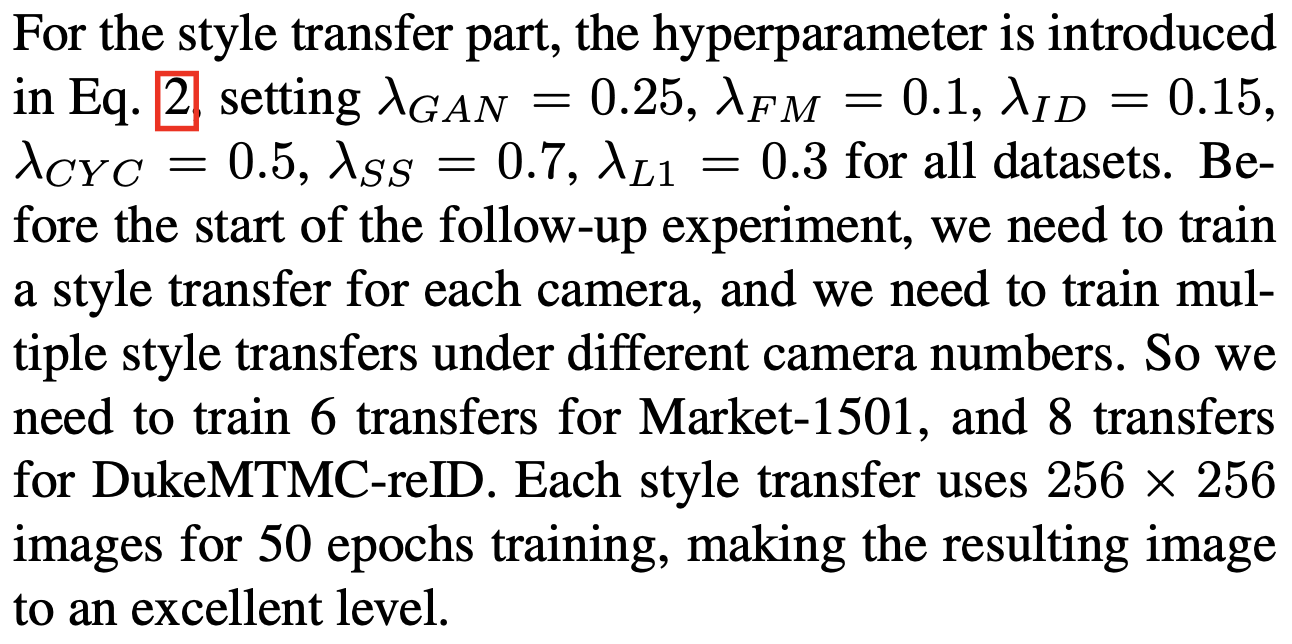

4.2.1UnityStyle Transfer Model

4.2.2Deep Re-ID Model

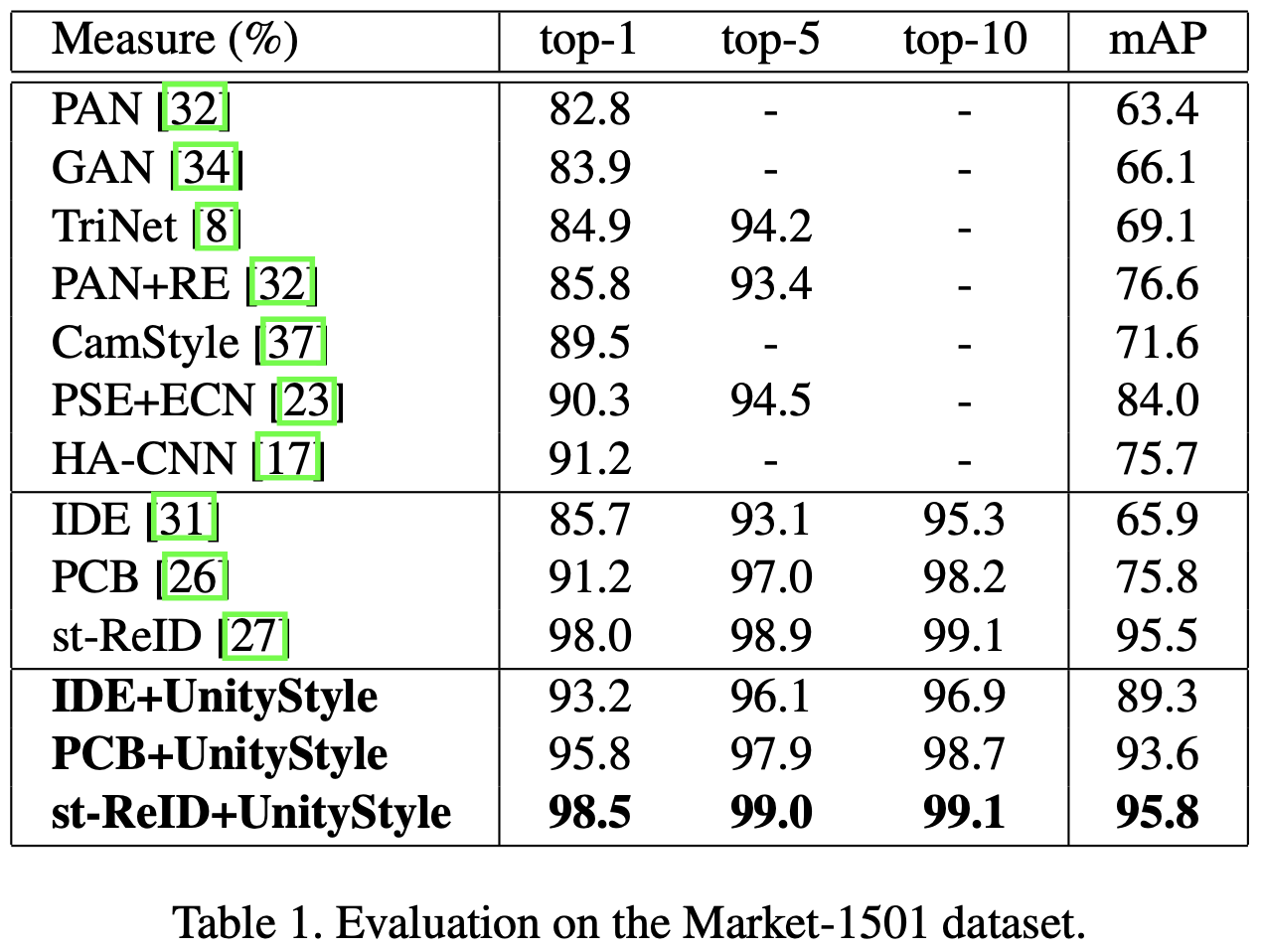

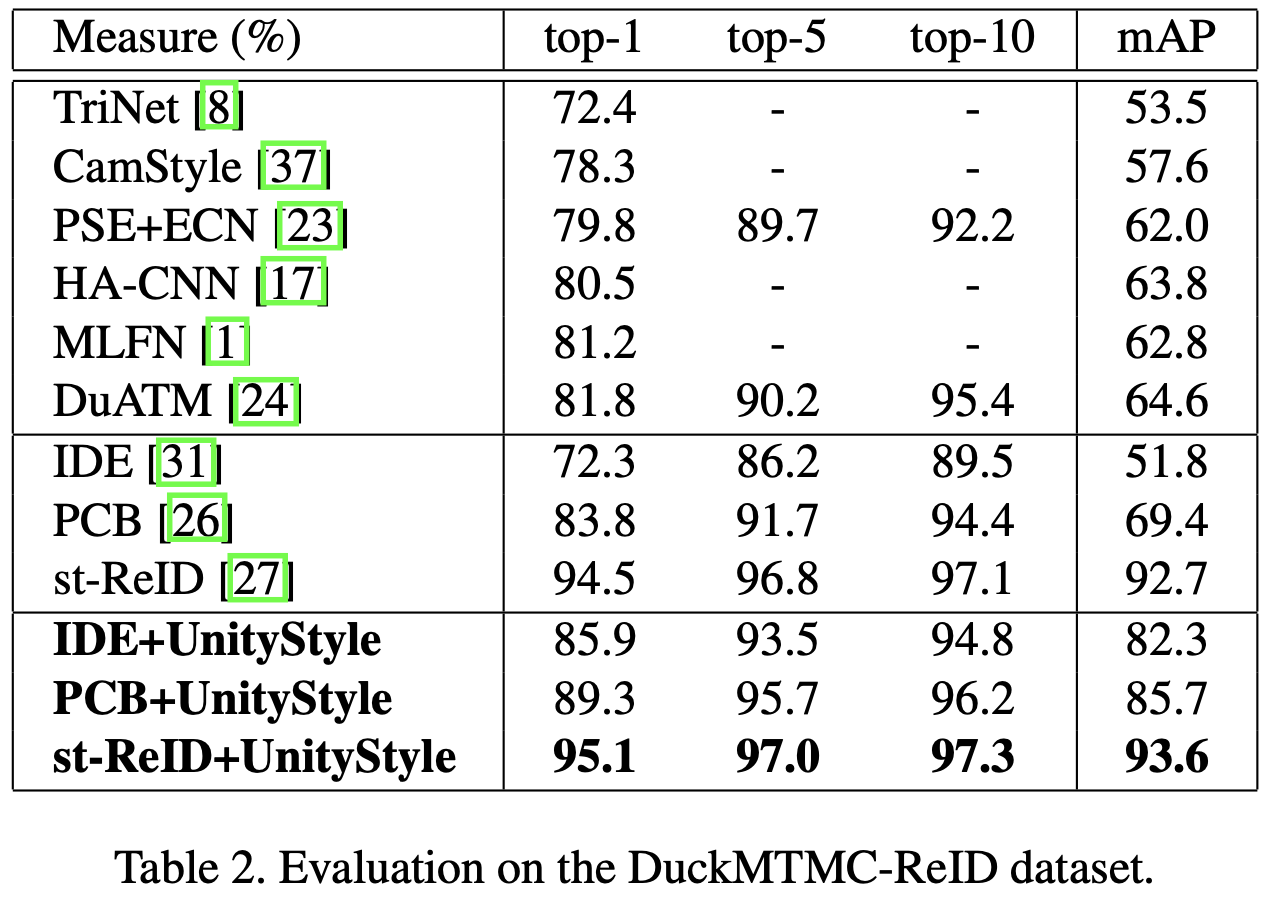

本文使用了IDE、PCB、st-ReID三个模型。

4.3Evaluation

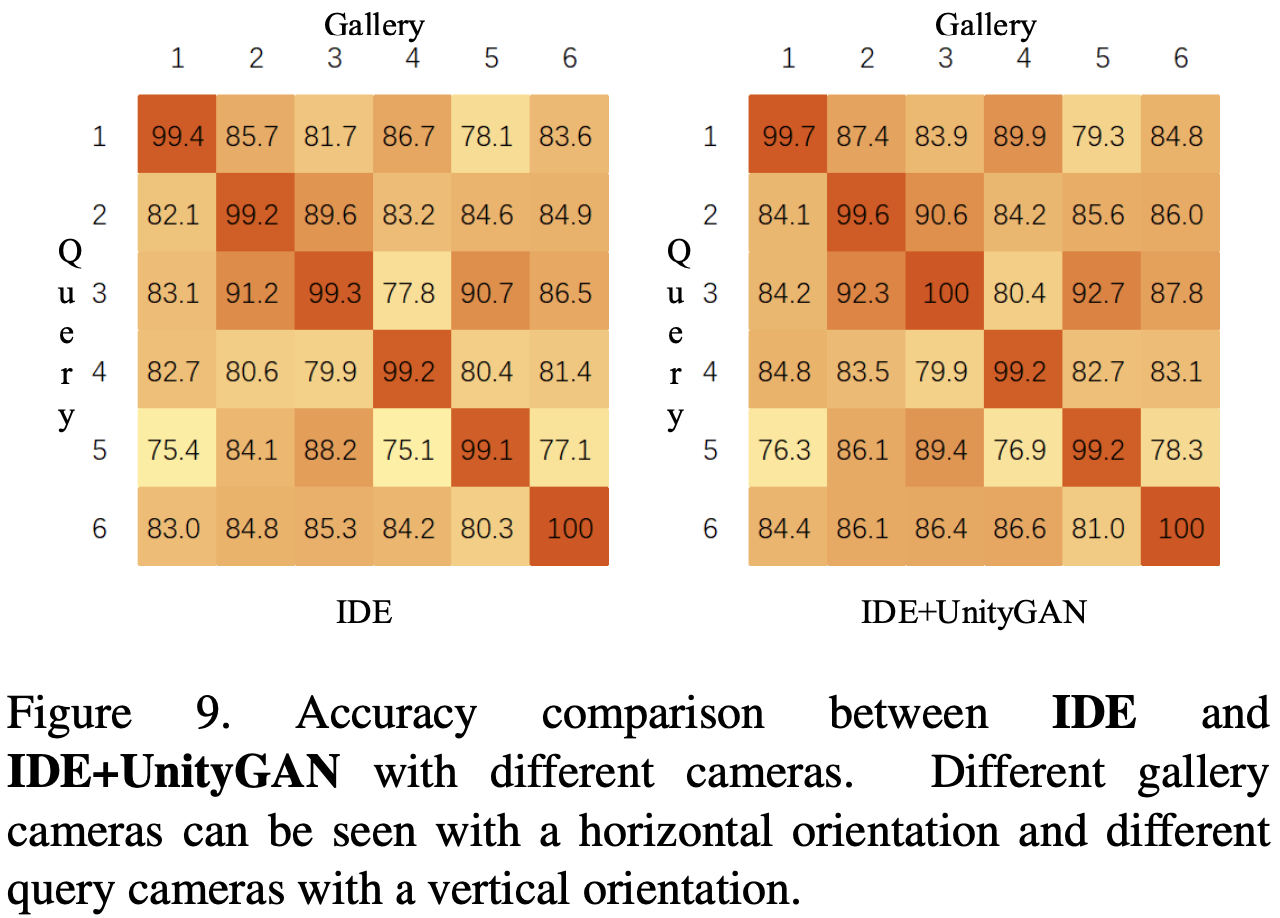

4.4.1UnityGAN

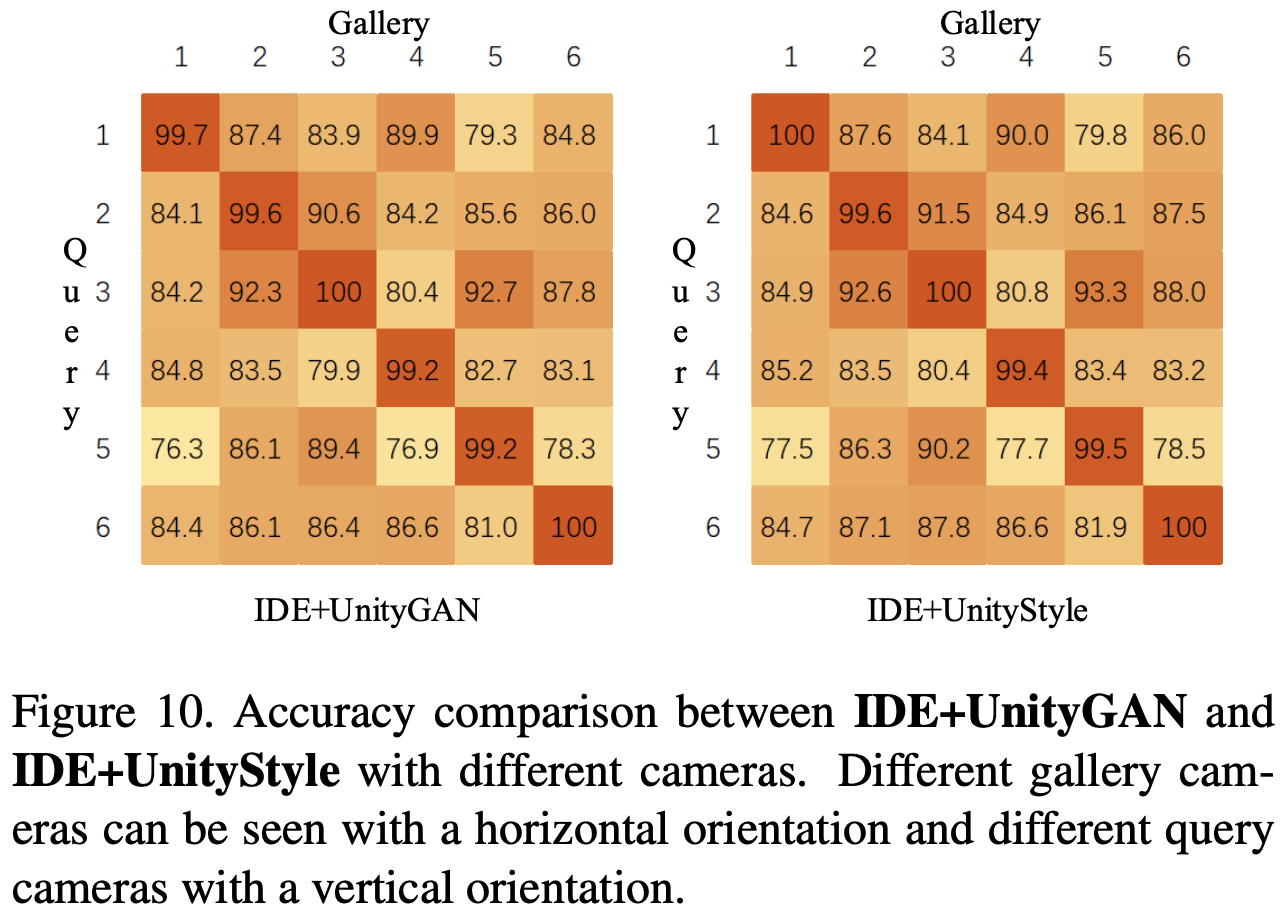

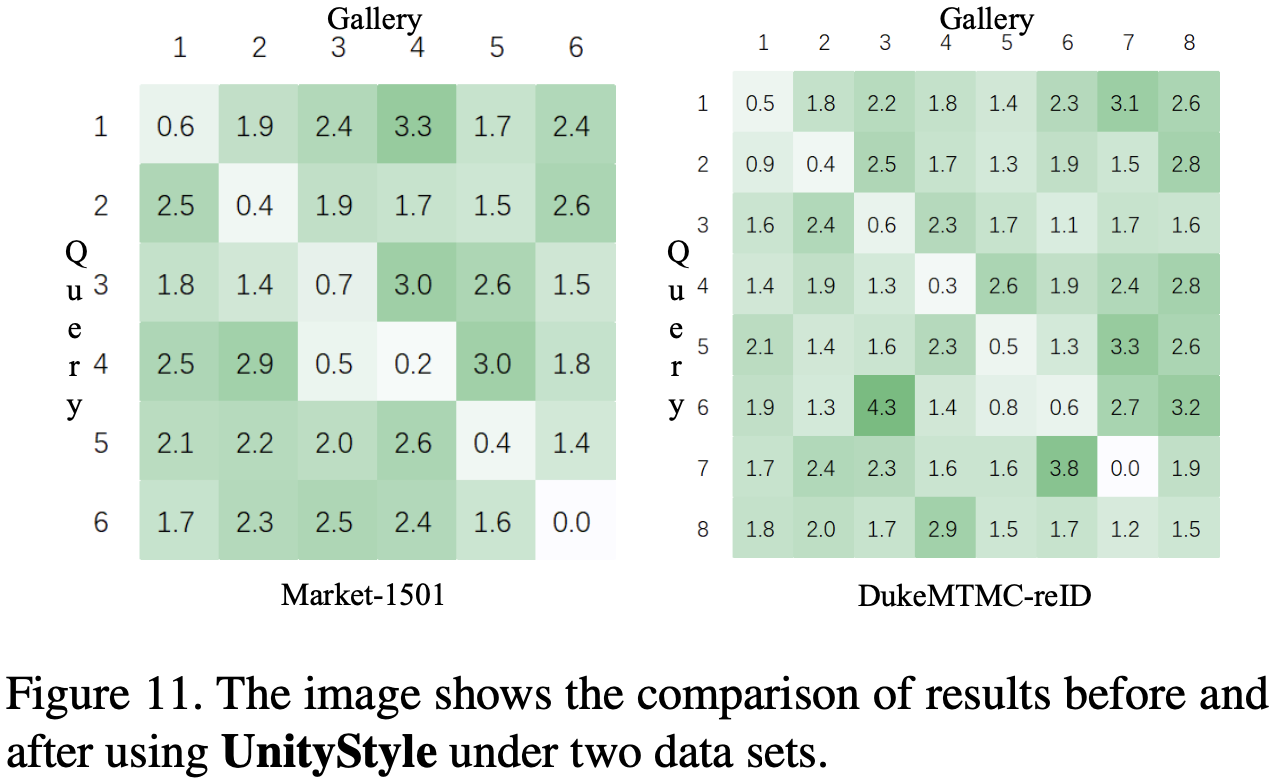

4.4.2UnityStyle

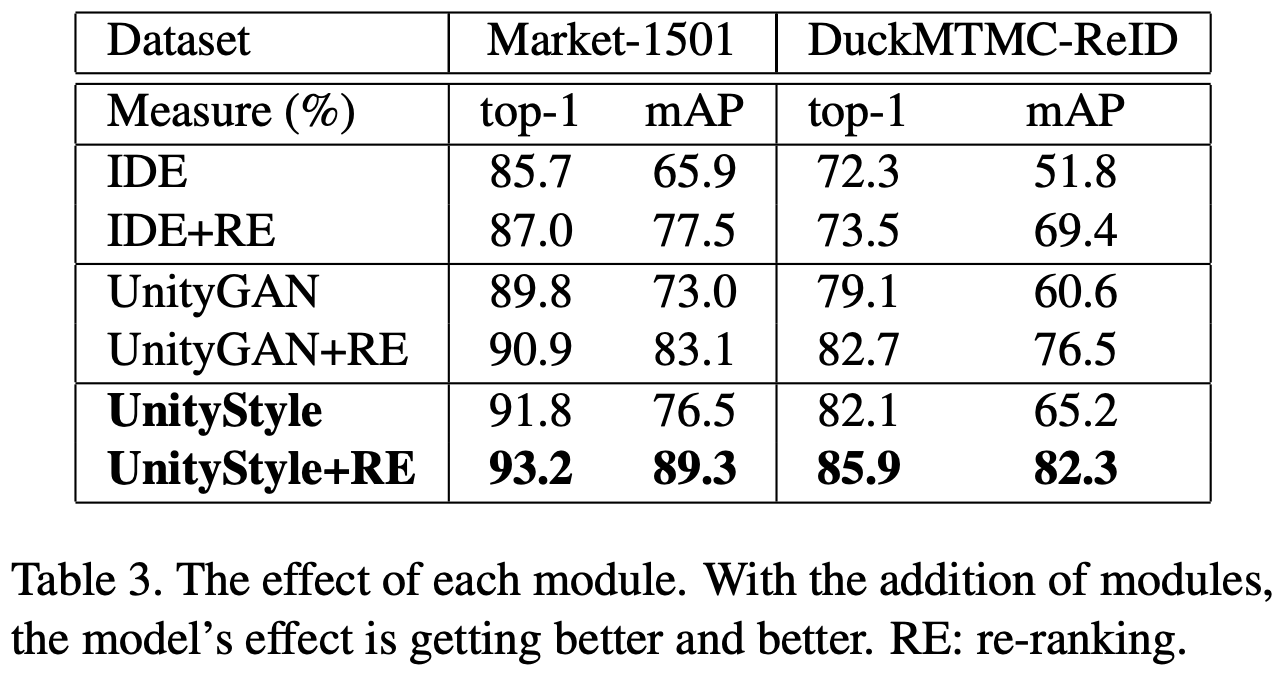

4.4.3Ablation Study

个人总结

此篇论文主要是提出了一个生成多摄像头一致风格图片的模型。

此篇论文提出的UnityGAN+UnityStyle确实体现较好的精度提高效果。

此篇论文从其他前有论文的模型做改进,缺少一定创新。

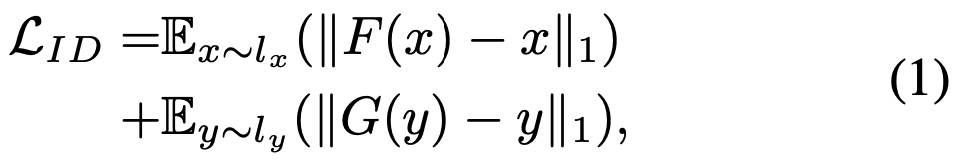

此篇论文中的一些数学公式引用了前有论文,稍有不清晰。

此篇论文的超参没有给出研究过程,缺乏一定科学性。