嗯…,之所以写这个,是因为最近上课在学这个。。。 想了又想,还是做个记录吧。

最近有点不在状态,仿佛是开学导致的(小声bb)。难受!

话不多说,开始正题!

1.模型表示

概念:单元线性回归,试图学得一个线性模型以尽可能准确地预测实值输出标记。单变量这个词仅仅是称呼单一变量的高大上的方式。

在回归中,均方误差(平方损失)是回归任务中最常用的性能度量。

通过让均方误差最小化来得到最优解。如果是拟合更加复杂的比如非线性函数 ,就不是用线性回归。

下面是一个根据房屋面积预测房屋价格的例子。

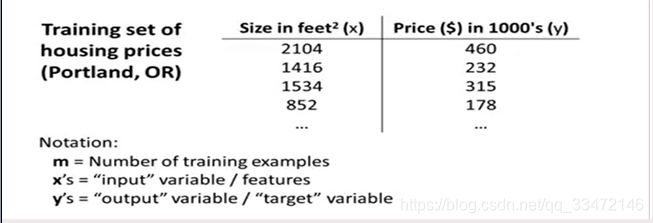

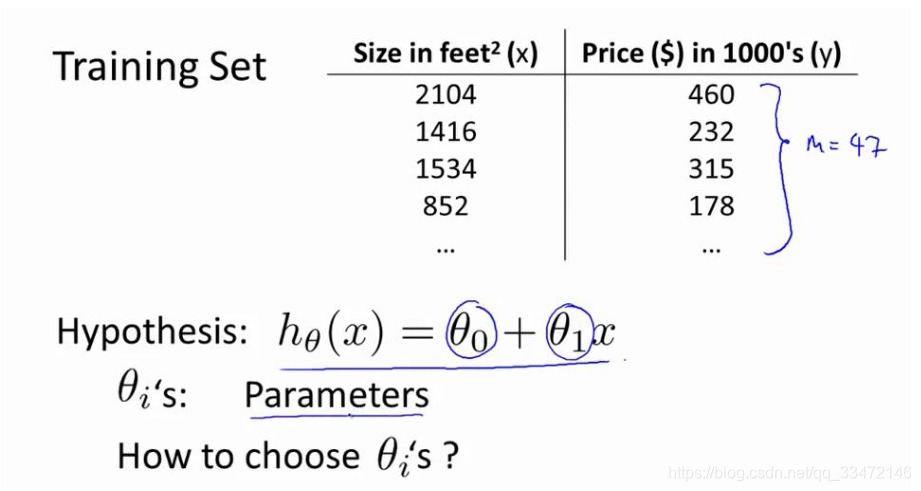

假使我们回归问题的训练集(Training Set)如下表所示:

我们将要用来描述这个回归问题的标记如下:

m 代表训练集中实例的数量

x 代表特征/输入变量

y 代表目标变量/输出变量

(x,y) 代表训练集中的实例

(x (i) ,y (i) ) 代表第 i 个观察实例

h 代表学习算法的解决方案或函数也称为假设(hypothesis)

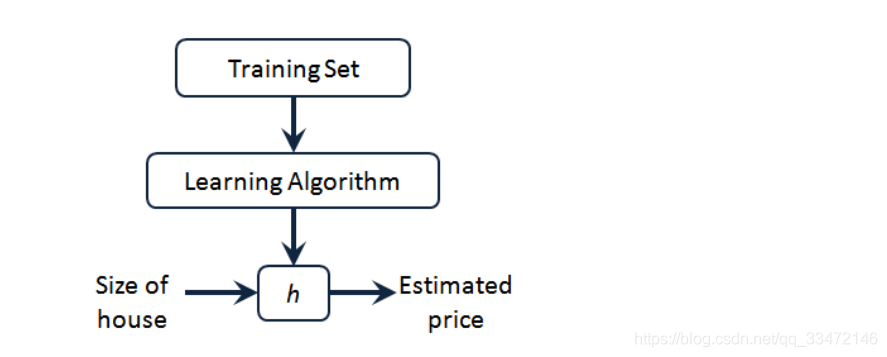

训练集是通过一种监督学习算法之后得到一个假设函数。

因而,要解决房价预测问题,我们实际上是要将训练集“喂”给我们的学习算法,进而学习得到一个假设 h,然后将我们要预测的房屋的尺寸作为输入变量输入给 h,预测出该房屋的交易价格作为输出变量输出为结果。

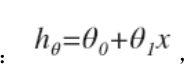

一种可能的表达方式为:

因为只含有一个特征/输入变量,因此这样的问题叫作单变量线性回归问题。

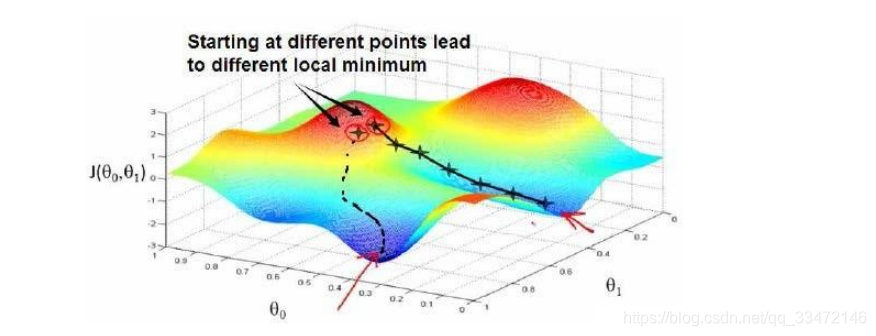

2.代价函数

概念:用于进行参数选择(即拟合),代价函数是用于寻找最优解(假设函数)的目标函数,代价函数也正是用来做这件事的。 也叫损失函数,用来进行参数估计。

当用一个确定的方程来拟合一些数据集时,为了保证方程最为合适拟合程度最好,即每一个点的预测值和真实值的差距都要小,故可用求方差的方法,将每一个点的预测值与真实值的差求平方和后再除以数据样本的个数。值越小说明方程越能反映真实情况,把这个方程中的参数看做未知数,则变成了参数的方程,求方程最小值参数即可确定。

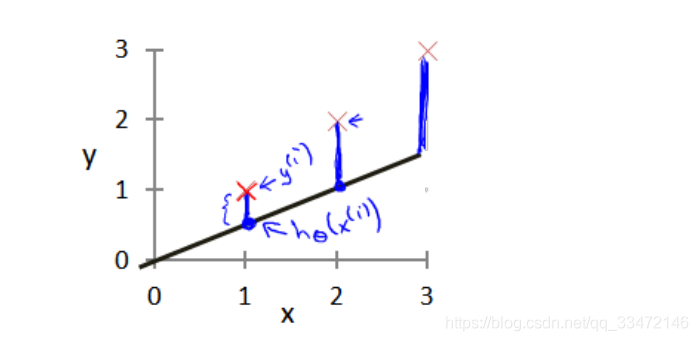

举例: 如下图所示

我们现在要做的便是为我们的模型选择合适的参数(parameters)θ 0 和 θ 1, 在房价问题这个例子中便是直线的斜率和在 y 轴上的截距。

我们选择的参数决定了我们得到的直线相对于我们的训练集的准确程度, 模型所预测的值与训练集中实际值之间的差距(下图中蓝线所指)就是建模误差(modeling error)。

我们的目标便是选择出可以使得建模误差的平方和能够最小的模型参数。 即使得代价函数最小(这里的1/2是为了便于后续计算)。

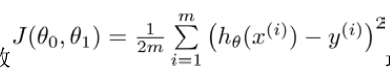

我们绘制一个等高线图,三个坐标分别为 θ 0 和 θ 1 和 J(θ 0, θ 1 ):

则可以看出在三维空间中存在一个使得 J(θ 0, θ 1 )最小的点。

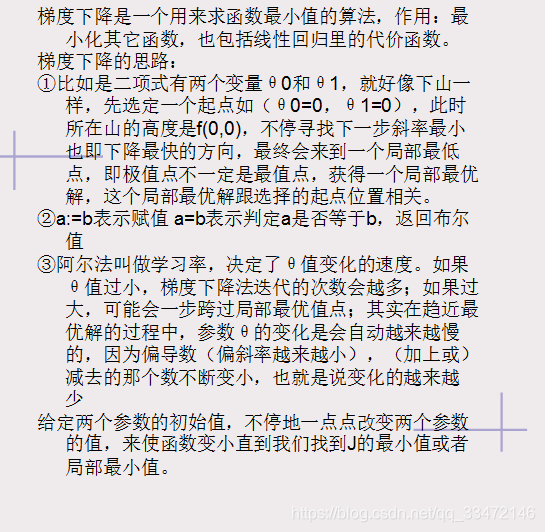

3.梯度下降

梯度下降是一个用来求函数最小值的算法,我们将使用梯度下降算法来求出代价函数J(θ 0 ,θ 1 ) 的最小值。

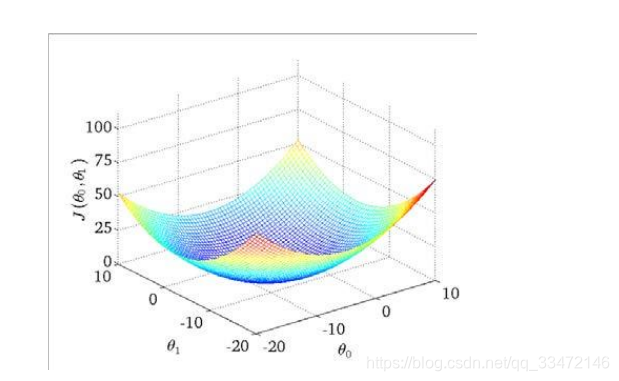

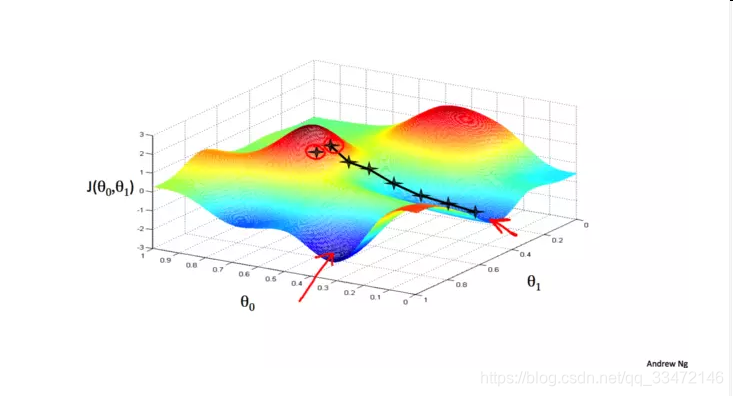

梯度下降背后的思想是:开始时我们随机选择一个参数的组合(θ 0 ,θ 1 ,…,θ n ),计算代价函数,然后我们寻找下一个能让代价函数值下降最多的参数组合。我们持续这么做直到到一个局部最小值(local minimum)。

因为我们并没有尝试完所有的参数组合,所以不能确定我们得到的局部最小值是否便是全局最小值(global minimum),选择不同的初始参数组合,可能会找到不同的局部最小值。

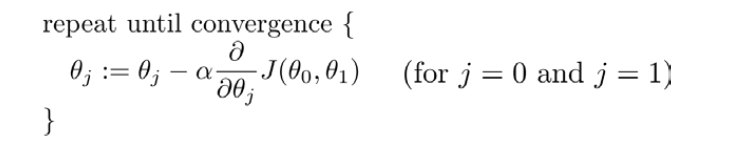

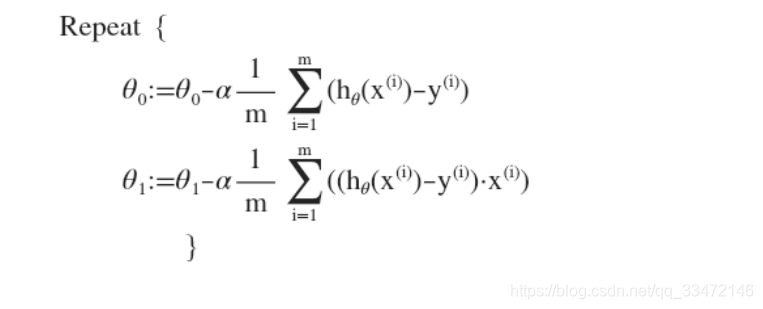

批量梯度下降(batch gradient descent)算法的公式为:

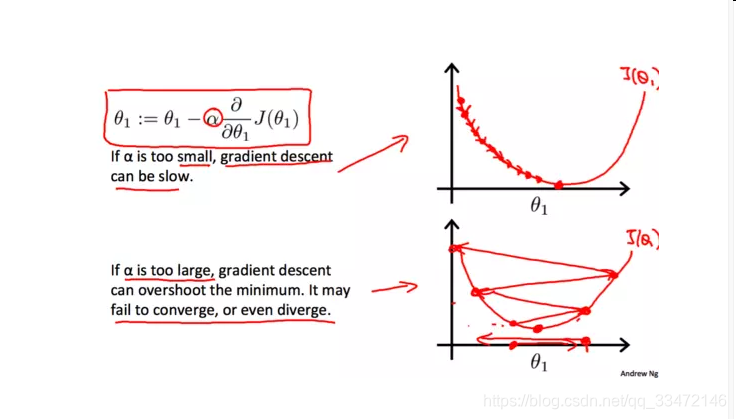

其中 α 是学习率(learning rate),它决定了我们沿着能让代价函数下降程度最大的方向向下迈出的步子有多大,在批量梯度下降中,我们每一次都同时让所有的参数减去学习速率乘以代价函数的导数。

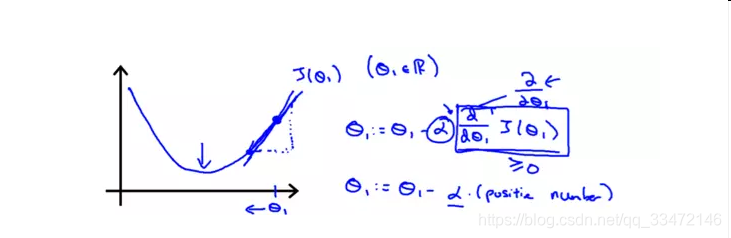

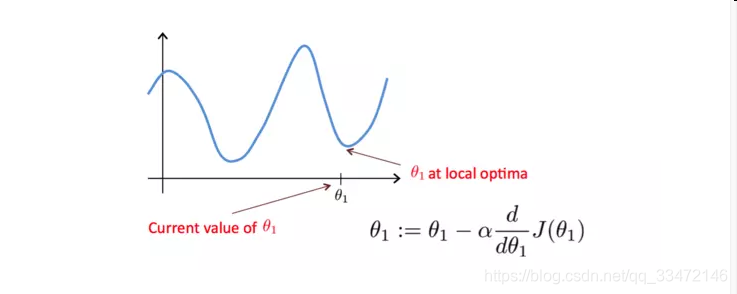

梯度下降算法如下图:

描述:对θ赋值,使得 J(θ)按梯度下降最快方向进行,一直迭代下去,最终得到局部最小值。其中 α 是学习率(learning rate),它决定了我们沿着能让代价函数下降程度最大的方向向下迈出的步子有多大。

梯度下降算法得到的结果会受到初始状态的影响, 即当从不同的点开始时, 可能到达不同的局部极小值, 如下图:

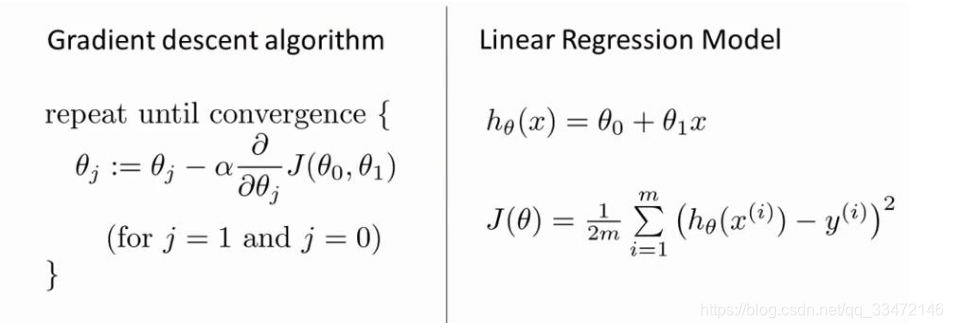

梯度下降算法和线性回归算法比较如图:

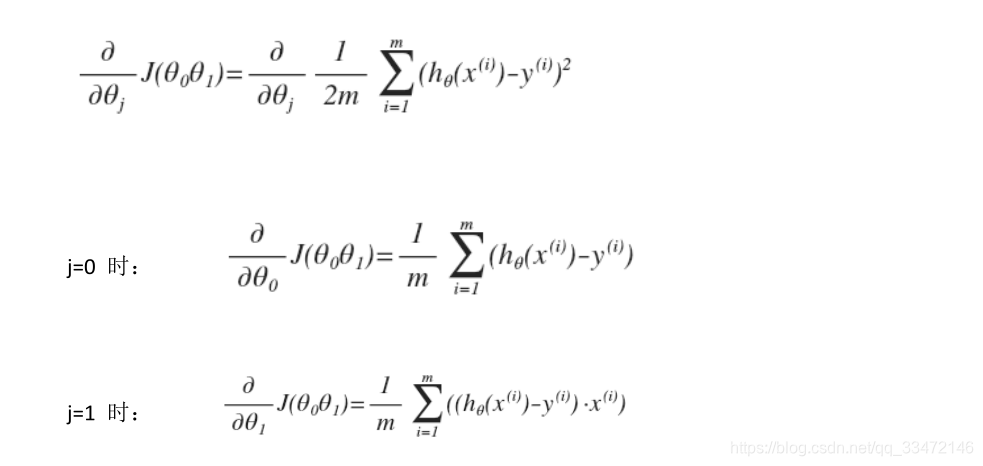

对我们之前的线性回归问题运用梯度下降法,关键在于求出代价函数的导数,即:

则算法改写成:

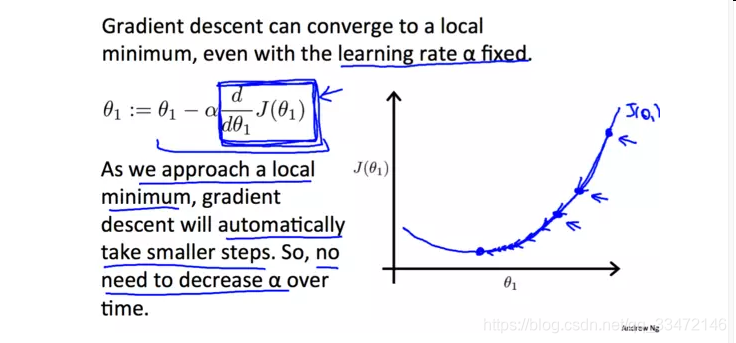

我们来看看梯度下降算法的梯度是如何帮助我们找到最优解的. 为了研究问题的方便我们还是同样地令θ0等于0,假设一开始选取的θ1在最低点的右侧,此时的梯度(斜率)是一个正数。根据上面的算法更新θ1的时候,它的值会减小, 即靠近最低点。

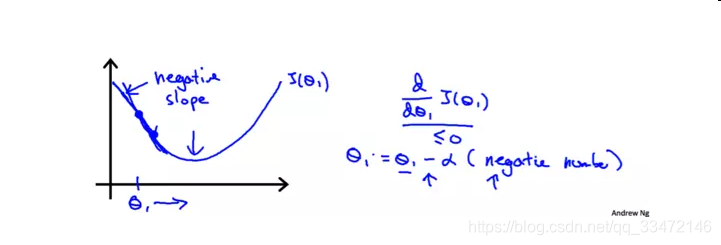

类似地假设一开始选取的θ1在最低点的左侧,此时的梯度是一个负数,根据上面的算法更新θ1的时候,它的值会增大,也会靠近最低点.

如果一开始选取的θ1恰好在最适位置,那么更新θ1时,它的值不会发生变化。

学习率α会影响梯度下降的幅度。如果α太小, θ的值每次会变化的很小,那么梯度下降就会非常慢;相反地,如果α过大,θ的值每次会变化会很大,有可能直接越过最低点,可能导致永远没法到达最低点。

由于随着越来越接近最低点, 相应的梯度(绝对值)也会逐渐减小,所以每次下降程度就会越来越小, 我们并不需要减小α的值来减小下降程度。

事实上,用于线性回归的代价函数总是一个凸函数(Convex Function)。这样的函数没有局部最优解,只有一个全局最优解。所以我们在使用梯度下降的时候,总会得到一个全局最优解。

有另一种不需要像梯度下降一样多次迭代也能求出最优解的方法,那就是正规方程(Normal Equation)。但是在数据量很大的情况下,梯度下降比较适用。