吴恩达ML课程课后总结,以供复习、总结、温故知新,也欢迎诸位评论讨论分享,一起探讨一起进步:

下一篇:机器学习(2)--多元线性回归算法https://blog.csdn.net/qq_36187544/article/details/87879423

linear regression线性回归算法:

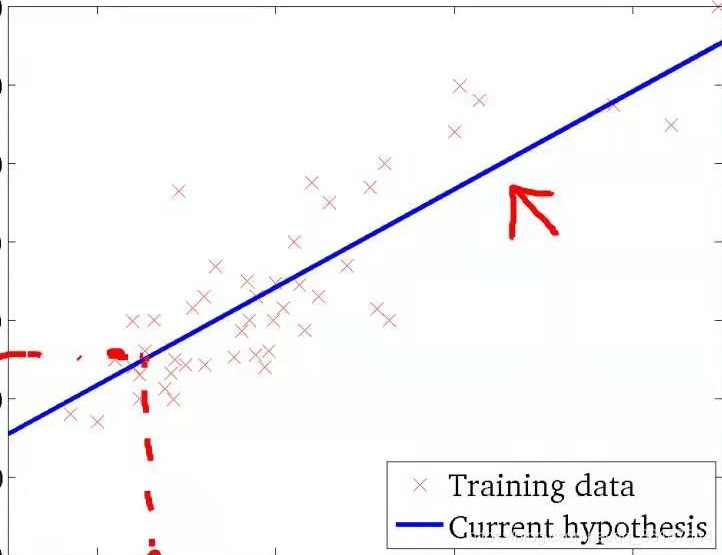

问题描述,对若干个离散点进行线性回归

得到回归线性方程

![]()

首先引入平方误差函数,或者叫代价函数:

![]()

意义是取点与回归直线距离平方的均值的二分之一,进行拟合时就是找代价函数值最小的对应的θ0和θ1

不同θ对应下代价函数如下图,现在目标就是找到该凸函数的最低点

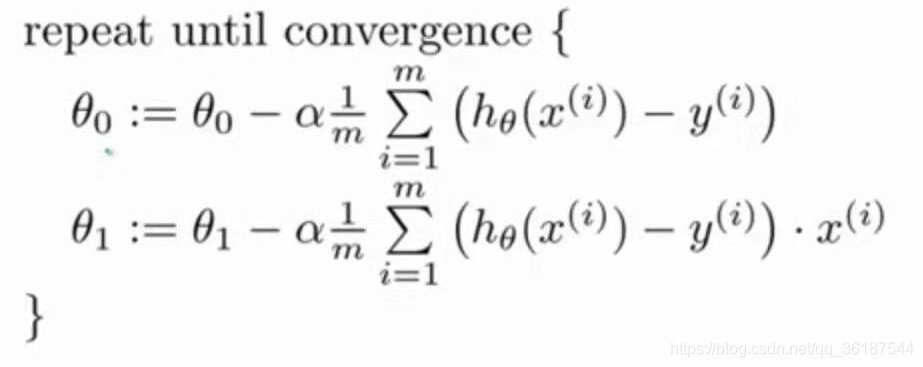

采用微积分中梯度下降的方法,算法如下:

每次进行θ0和θ1的更新(注:必须同时更新),α是学习效率,控制多大幅度更新θ,过大会无法收敛或者发散。

当达到最低时,偏导为0,认为这是局部最优解,这个下降幅度![]() 随着偏导的减小而减小,最终达到局部最优解。

随着偏导的减小而减小,最终达到局部最优解。

由于线性方程的代价函数是一个凸函数,所以只有一个全局最优。

最后经过求偏导得到如下算法,又称为Batch梯度下降法: