本文参考自: 原文地址

一、概述

基本的线性模型简单且易于建模,而一些功能更为强大的非线性模型可以在现行模型的基础上通过引入层级结构或者高维映射得到,机器学习实战中首先讲解了一种基本形式。

二、原理

对于:

$$f(x) = w^{T}x + b$$

问题,当w和b学习得到后,模型就得到了确定。

于是:

$$\hat{w^{*}}=argmin_{w}(y-X\hat{w})^T(y-X\hat{w})$$

对w求导:

$$\frac{\partial E_{\hat{w}}}{\partial \hat{w}}=2X^T(X\hat{w}-y)$$

另其为0得到:

$$\hat{w}^*=(W^TX)^{-1}X^Ty$$

得到了最基本的模型

三、实战

from numpy import *

import matplotlib.pyplot as plt

def loadDataSet(fileName): #general function to parse tab -delimited floats

numFeat = len(open(fileName).readline().split('\t')) - 1 #get number of fields

dataMat = []; labelMat = []

fr = open(fileName)

for line in fr.readlines():

lineArr =[]

curLine = line.strip().split('\t')

for i in range(numFeat):

lineArr.append(float(curLine[i]))

dataMat.append(lineArr)

labelMat.append(float(curLine[-1]))

return dataMat,labelMat

def standRegres(xArr,yArr):

xMat = mat(xArr); yMat = mat(yArr).T

xTx = xMat.T*xMat

if linalg.det(xTx) == 0.0:

print ("This matrix is singular, cannot do inverse")

return

ws = xTx.I * (xMat.T*yMat)

return ws

def main1():

xArr,yArr=loadDataSet('ex0.txt')

xMat = mat(xArr)

yMat = mat(yArr)

ws = standRegres(xArr,yArr)

fig = plt.figure()

ax = fig.add_subplot(111)

ax.scatter(xMat[:,1].flatten().A[0], yMat.T[:,0].flatten().A[0],c='r')

xCopy=xMat.copy()

xCopy.sort(0)

yHat=xCopy*ws

ax.plot(xCopy[:,1],yHat)

plt.savefig('firstplot.png')

plt.show()

if __name__ == '__main__':

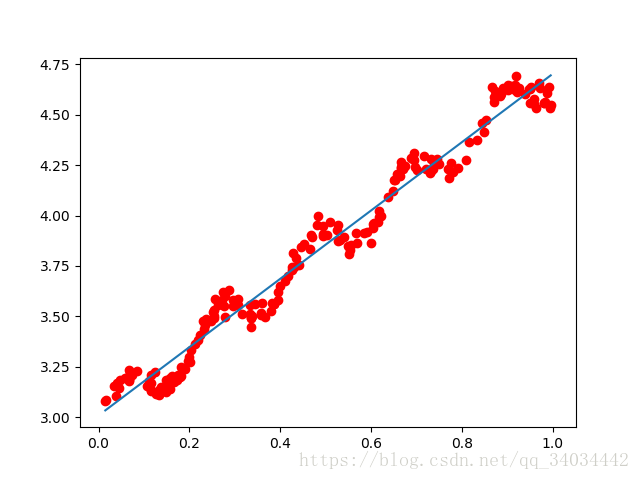

main1()结果: