信息熵在信息论中代表的是随机变量的不确定度的度量

1、熵越大,数据的不确定性越高,无规则运动越剧烈

2、熵越小,数据的不确定性越低

信息熵公式:

式子表示这个样本中有k类,pi表示第i类数据在总体中的占比。

负号是因为pi属于0到1之间,那么log(pi)就小于零,所以加一个负号。

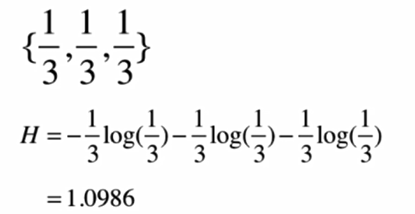

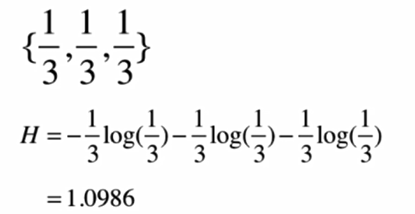

举个栗子:

可以看到后一个的熵要小,后一个数据比前一个数据更加确定。

划分的目的:

使得划分后信息熵降低

对所有的划分可能性进行搜索,找到最优划分方式,生成决策树

信息熵在信息论中代表的是随机变量的不确定度的度量

1、熵越大,数据的不确定性越高,无规则运动越剧烈

2、熵越小,数据的不确定性越低

信息熵公式:

式子表示这个样本中有k类,pi表示第i类数据在总体中的占比。

负号是因为pi属于0到1之间,那么log(pi)就小于零,所以加一个负号。

举个栗子:

可以看到后一个的熵要小,后一个数据比前一个数据更加确定。

划分的目的:

使得划分后信息熵降低

对所有的划分可能性进行搜索,找到最优划分方式,生成决策树