文章目录

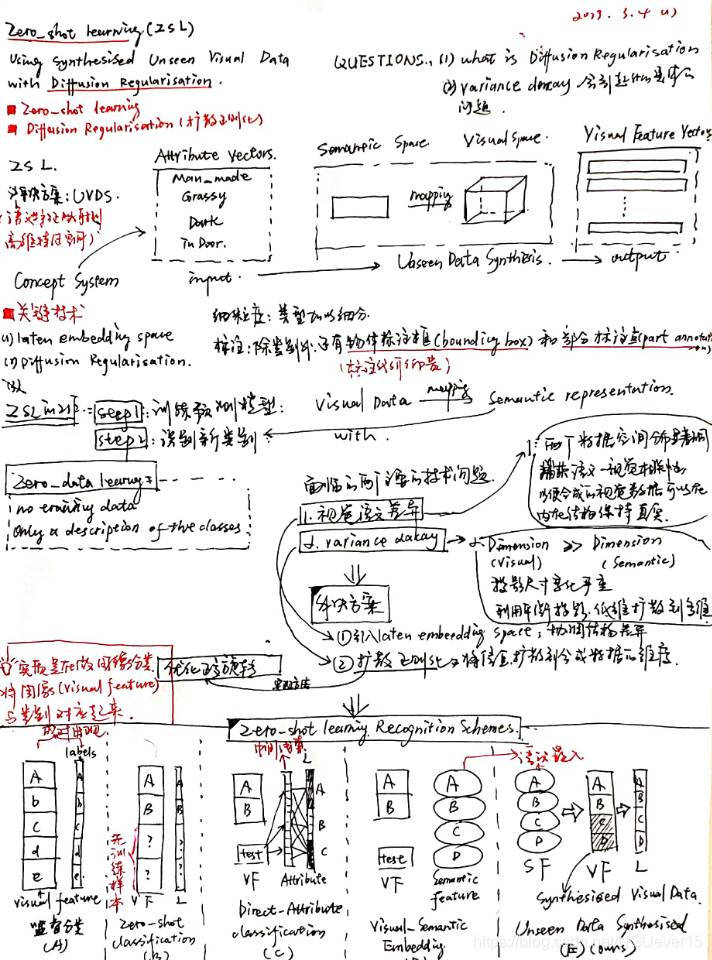

Zero-shot Learning Using Synthesised Unseen Visual Data with Diffusion Regularisation

Introduction and Ralation works

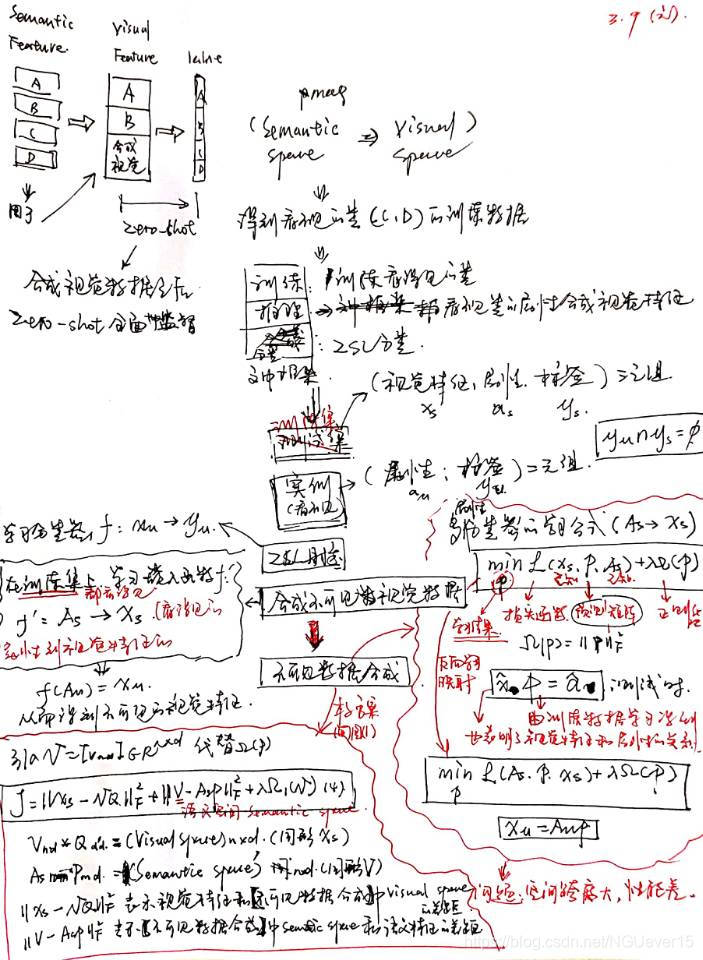

Zero-shot Recognition Schemes

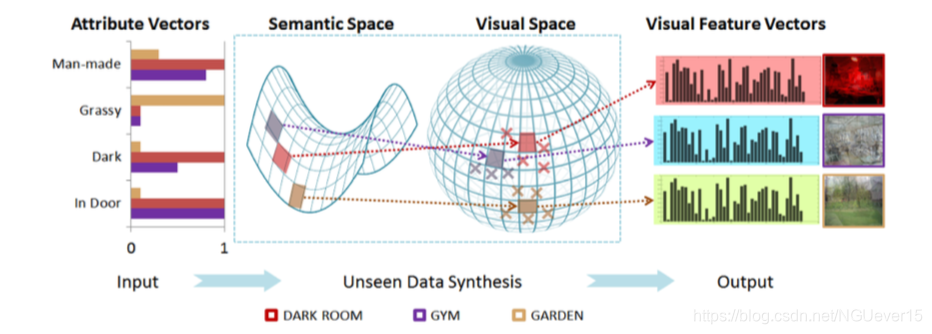

Semantic Side Information

ZSL任务需要利用辅助信息作为中间线索。 这样的框架不仅拓宽了分类设置,还使各种信息能够帮助视觉系统。

Structure-Preserving Projection

插入一个潜在的嵌入空间来协调视觉和语义空间之间的数据结构差异。

然后构造双图以找到两个空间之间的平衡结构。

看不见的类由语义属性表示为输入。

我们训练一个模型,将语义空间映射到可视数据空间,以合成这些看不见的类的训练数据。

文中方案:

- ZSL任务受到全面监督。

- 目标是合成视觉特征,而不是寻找原始特征的最佳子空间。

- 证明了即使与实际数据相比,合成数据也可以实现更平衡的维数。

APPROACH

ZSL任务通常涉及三个步骤:

- 训练

- 推理

- 测试

文中框架中:

- 训练只需要看到类的数据

- 推理阶段需要看不见的类的属性来合成视觉特征

- 最后使用合成的特征进行ZSL分类

Preliminaries

训练集是视觉特征,属性和标签的三元组(x,a,ys)

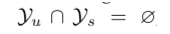

看不见的实例是属性和标签的二元组(a,yu),且看不见的实例和测试集的类别不想交,即:

zero-shot learning的目标是学习一个分类器:

其中xu中的样本在训练过程中完全不可用。

Unseen Visual Data Synthesis:

我们的目标是通过给定的语义属性来合成看不见的类别的视觉特征。

在训练集上学习一个嵌入函数f’ :

Zero-shot Recognition

使用合成视觉特征,可以直接估计不可见类别的分布。

Unseen Visual Data Synthesis

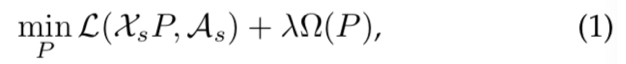

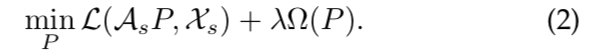

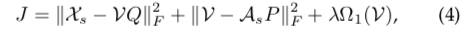

一个典型的多属性分类器可通过下面的公式学习得到

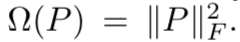

其中P是预测矩阵,L是损失函数,gama是带超参数lamda的正则化项。

通常情况下:

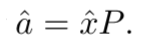

通过下面的公式,在测试时,一个不可见的实例可以被之间映射到属性空间:

P是仅适用训练数据学习得到的

我们建议通过反向学习从语义空间到视觉特征空间的映射函数来合成视觉特征。

通过学习一个从语义空间到视觉特征空间的如下映射函数来合成视觉特征(与式(1)反向):

通过式(3)得到不可见类的视觉特征

Visual-Semantic Structure Preservation:

上面框架的问题:

1、视觉和语义空间的跨度很大,对于zsl目标,合成数据可能是不够判别的。

2、这样一个基于回归的框架(regression-based framework)不能发现本质拓扑结构,结果,合成数据得到了和原始视觉特征完全不同的特征分布。

所以,直接从语义空间映射到视觉空间会导致很差的性能。

解决方案

我们建议引入一个辅助潜在嵌入空间V来协调语义空间和视觉特征空间,其中:

这样的话,我们用v而不是 Ω(P ),来保护视觉和语义空间的本质数据结构信息。具体如下:

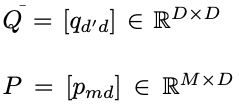

其中:

P和Q是两个预测矩阵,Ω1 是对偶图。

X和A都是nXn的。

视觉空间的图Ws(N*N) 有N个顶点{g1,……,gN},分别对应训练集上N个数据点{x1,……,xN},语义图WA有相同的顶点数。

对于实例级的属性,我们为视觉和语义构建k-nn图,也就是说,为每个数据点xn和它邻近的k个点连接边。

在权重矩阵中,wij=1当且仅当gi和gj相连,否则wij=0

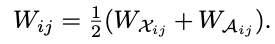

对于别类级的属性,wij = k/nc, c是类别名称,nc是类别C的大小。

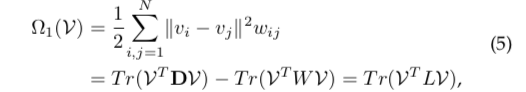

最后的正则化项计算如下:

其中:

D是矩阵W的度

L是已知的拉普拉斯矩阵 L = D-W

tr(.)是计算矩阵的秩