未完。。。

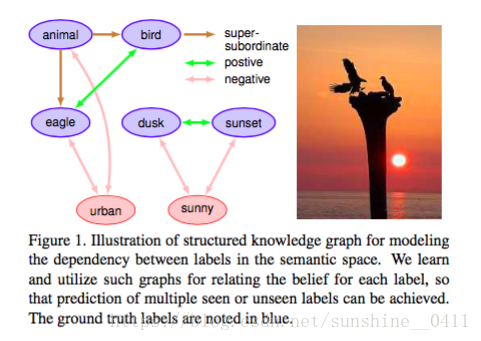

本文提出了一种用于多标签零样本学习(ML-ZSL)的深度学习架构,它能够为每个输入实例预测未知的类标签。受人类利用对象之间语义知识方式的启发,我们提出了一个框架,包含用于描述多个标签之间关系的知识图谱。我们的模型从语义标签空间学习信息传播机制,该机制可用于建模已知和未知类标签间的相互依存关系。 通过对视觉推理的结构化知识图谱的研究,我们证明了我们的模型可用于解决多标签分类和ML-ZSL任务。与目前性能最好的方法相比,我们的模型可以实现类似或更优的性能。

Introduction:

我们不仅仅希望将图片与多个标签相关联,还希望利用标签之间的相关性。一般来说,二元相关性是解决多标签分类问题的最简单方法,它把原始任务转化为多个不相交的二元分类问题。然而,它缺乏建模标签共同出现的能力,因此不是优选的。还可以通过假设标签先验获得交叉标签相关性,如[38,7]。而基于标签嵌入的方法[3,43,6,5,4]将输入图像及其标签投影到潜在空间以利用标签相关性。还提出了利用深度神经网络的方法。BPMLL[50]首先提出了用于对标签间的依赖关系进行建模的损失函数,其他最近的工作也提出了不同的损失函数[18,34]或体系结构[46,45,49]以进一步提高性能。

多标签零样本学习(ML-ZSL)是零样本学习(ZSL)的一个分支,它从多标签分类扩展而来,要求对训练过程中未定义的未知标签进行预测。传统的多标签方法,如二元相关性或基于标签先验的方法显然不能直接应用于ML-ZSL,因为这些方法缺乏推广到未知的类标签的能力。相比之下,在语义空间中利用标签表示的方法,例如标签嵌入方法,可以更容易地适应ML-ZSL,给定未知类的标签表示。通常,标签表示是从人注释的属性向量中获得的,该属性向量描述特定领域中感兴趣的标签,或者通过从语言资源学习的分布式词嵌入。????

尽管最近提出了诸如[31,16,51,17,39]之类的ML-ZSL方法,但是现有方法没有利用结构化知识和推理的优势。我们利用ML-ZSL的现有结构知识,在已知和未知的标签之间获得适当的依赖关系。

知识图谱中,我们可以对共现和非共现概念建模,并将知识扩展到具有外部结构化知识图谱的未知类。已经有工作利用结构化知识解决多标签问题。[10]引入了一种图形表示,它加强了标签概念之间的某些关系。[21]采用RNN[20,41]对不同概念层之间的正负相关关系进行建模。最近,[30]扩展了图形的神经网络[40,27],通过在知识图谱中传播信息,有效地学习了一种模型,可以推断不同类标签之间的关系。

现有的工作都没有提出ML-ZSL的结构化知识推理。本文提出了一种新的ML-ZSL方法来观察和整合相关的结构化知识。标签用语义向量表示,信息传播机制是从语义空间中观察到的标签关系中学习的。然后,使用这种标签关系的传播机制来修改每个类标签的初始值。一旦传播过程完成,就可以相应地执行多标签分类(或ML-ZSL)。我们的模型将从WordNet观察到的结构化知识图谱整合到端到端的学习框架中,同时学习标签表示和在语义空间中传播的信息。通过这个框架,我们通过将未知的标签嵌入向量分配到学习模型中来实现ZSL。我们将展示我们的模型在提高结构化知识推理方面的有效性,这将有利于ML-ZSL的任务。

本文主要贡献:

- 最先将结构化知识和知识图谱用于ML-ZSL的模型之一。

- 提出了语义空间的信息传播机制,使得学习模型能够推理未知类别的标签。

- 在标准多标签分类任务上具有相似的性能,优于最新的ML-ZSL。

Related work:

近期工作:多标签分类利用标签共现和标签之间的关系。

多标签分类的方法:

- Binary relevance using neural networks

- Label embedding methods: 标签嵌入方法是将标签转换成嵌入的标签向量,从而利用标签之间的相关性。

- Deep neural networks

- Exploring explicit semantic relations between the labels

- Hierarchy and Exclusion (HEX) graph 捕捉任意两个标签之间的语义关系:互斥、重叠、包含,通过标签关系改进分类

- Structured Inference Neural Network (SINN):想法来自RNN,positive correlation and negative correlation between labels are derived for bidirectionally propagating information between concept layers, which further improves the classification performance.

- GGNN

- GSNN

零样本学习通常通过将属性、词向量等语义信息和视觉内容关联起来来解决视觉问题。