本文发表于CVPR 2018上

文献地址:https://arxiv.org/abs/1712.06087

作者项目地址:http://www.wisdom.weizmann.ac.il/~vision/zssr/

一、疑问:

1、 Zero-Shot 指什么?联系one-shot,few-shot

- 本文只用一张图像训练,没有其他额外信息或图像

- first unsupervised CNN-based SR method.

- does not require pretraining

2、 Zero-Shot 超分训练流程是怎样的?

论文第3页左下角:

- 训练LR 和其下采样的图像学习到二者关系

- 将这种关系用于 LR 以产生 HR输出。

在测试时训练?

3、 和 Blind SR的区别和联系?

4、 标题中Deep Internal Learning 指什么?

一张图像内的重复信息

5、 self-supervision 指什么?

We train a CNN to infer complex image-specific HR-LR relations from the LR image and its downscaled versions (self-supervision).

二、解决问题:

简单地说,就是LR-HR图像对训练过于理想,实际的 LR图像更复杂。

详细论述:

监督SR方法仅限于特定的训练数据,预先确定了从高分辨率(HR)对象获取低分辨率(LR)图像(例如,双三次缩放),而没有任何分散注意力的伪影(例如,传感器噪声,图像压缩,非理想的PSF等)。但是,真实的LR图像很少遵守这些限制,从而导致SotA(最新技术)方法的SR结果不佳。

三、怎么做:

提出“ Zero-Shot” SR

- 不依赖于先前的训练。

- 利用单一图像内部信息的内部重复性,并在测试时针对仅从输入图像本身提取的示例训练小型图像特定的CNN。

Image-Specific CNN – “Zero-Shot” SR.

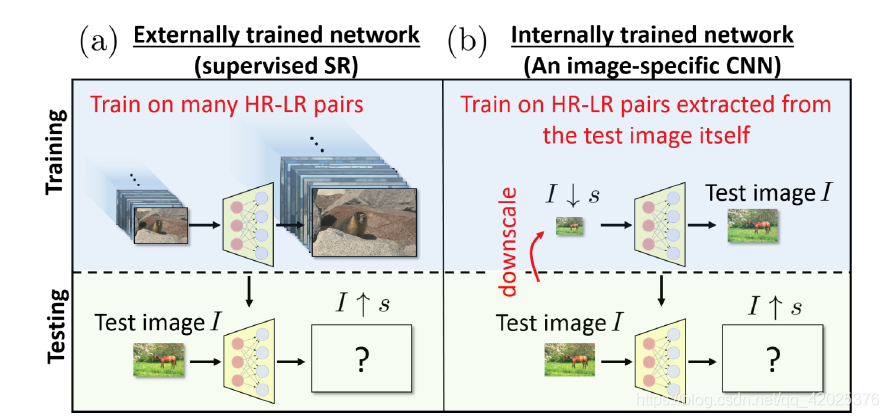

(b) Our proposed method (ZSSR):

a small image-specific CNN is trained on examples extracted internally, from the test image itself.

It learns how to recover the test image I from its coarser resolutions. The resulting self-supervised network is then applied to the LR image I to produce its HR output.

四、原理:

理论分析:

The recurrence of small pieces of information (e.g., small image patches) across scales of a single image, was shown to be a very strong property of natural images.

理论依据:

- Fundamental to our approach is the fact that natural images

have strong internal data repetition. - internal entropy of patches inside a single image is much smaller than the external entropy of patches in a general collection of natural images.

- 参考文献23

总结:

一、创新点:

二、借鉴之处: