版权声明:本文为博主原创文章,未经博主允许不得转载。 https://blog.csdn.net/qq_16949707/article/details/53495576

不同于回归问题,分类问题是指预测值y只有几个离散的值,这里只讲binary classification 二分类问题,即y只取0,1。

Logistic regression

1 why logistic fuction?为什么选择sigmoid函数?

(1) 如何将标签映射到0,1?

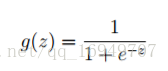

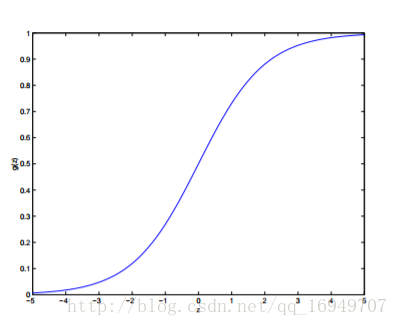

sigmoid函数及图如下:

函数:

图:

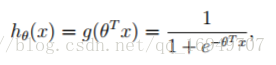

(2) 所以要将标签映射到0,1。我们的假设函数可以设为:

这样就可以将标签映射到0,1了。

2 这里损失函数怎么求,以及怎么更新模型的参数θ?

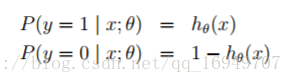

1 参数为θ时,输入为x时,模型的输出是多少?

假设:

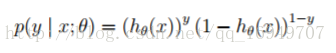

那么上面模型的输出可以统一写作:

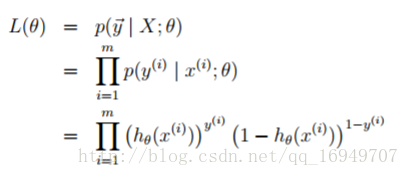

2 参数为θ,样本数据为(X,Y)时,关于θ的最大似然函数可以记作:

3 怎样使似然函数最大呢?

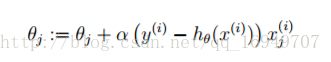

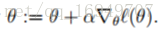

同样的,利用梯度下降算法,利用log(似然函数)对模型参数θ的梯度来更新θ,即:

这里是加号了。

另外还可以用牛顿法来更新,待研究。

4 怎么求log(似然函数)及其对模型参数θ的梯度?

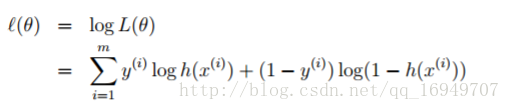

log(似然函数):

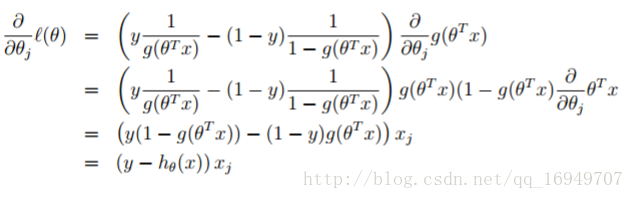

求导: