版权声明:本文为博主原创文章,未经博主允许不得转载。 https://blog.csdn.net/zw__chen/article/details/82802083

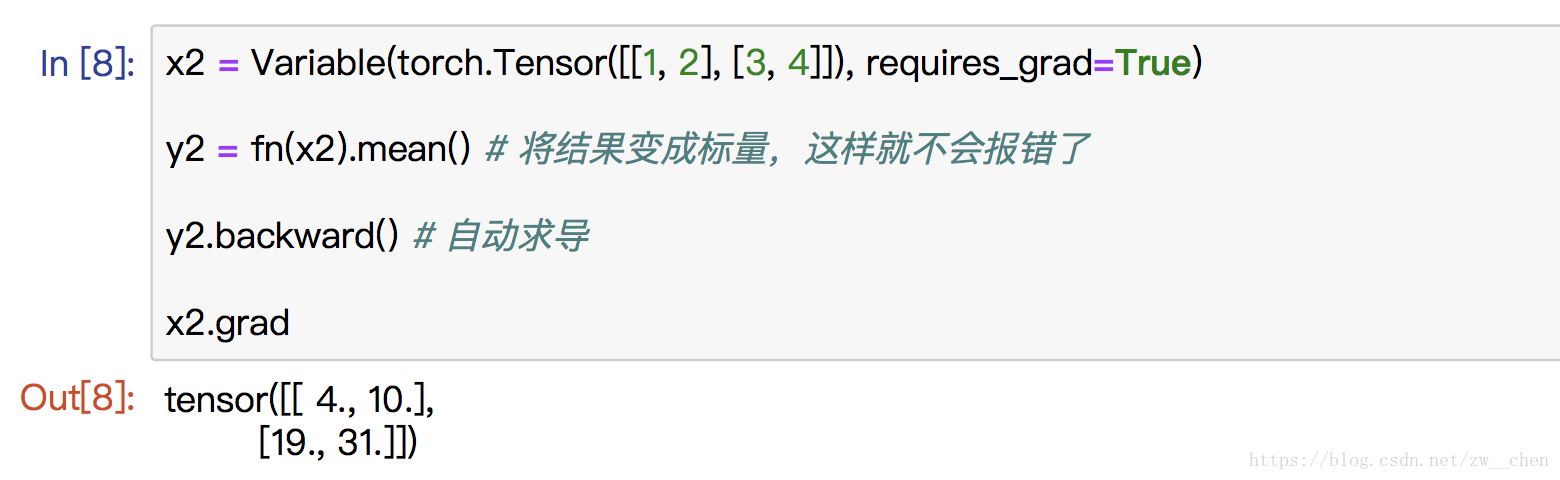

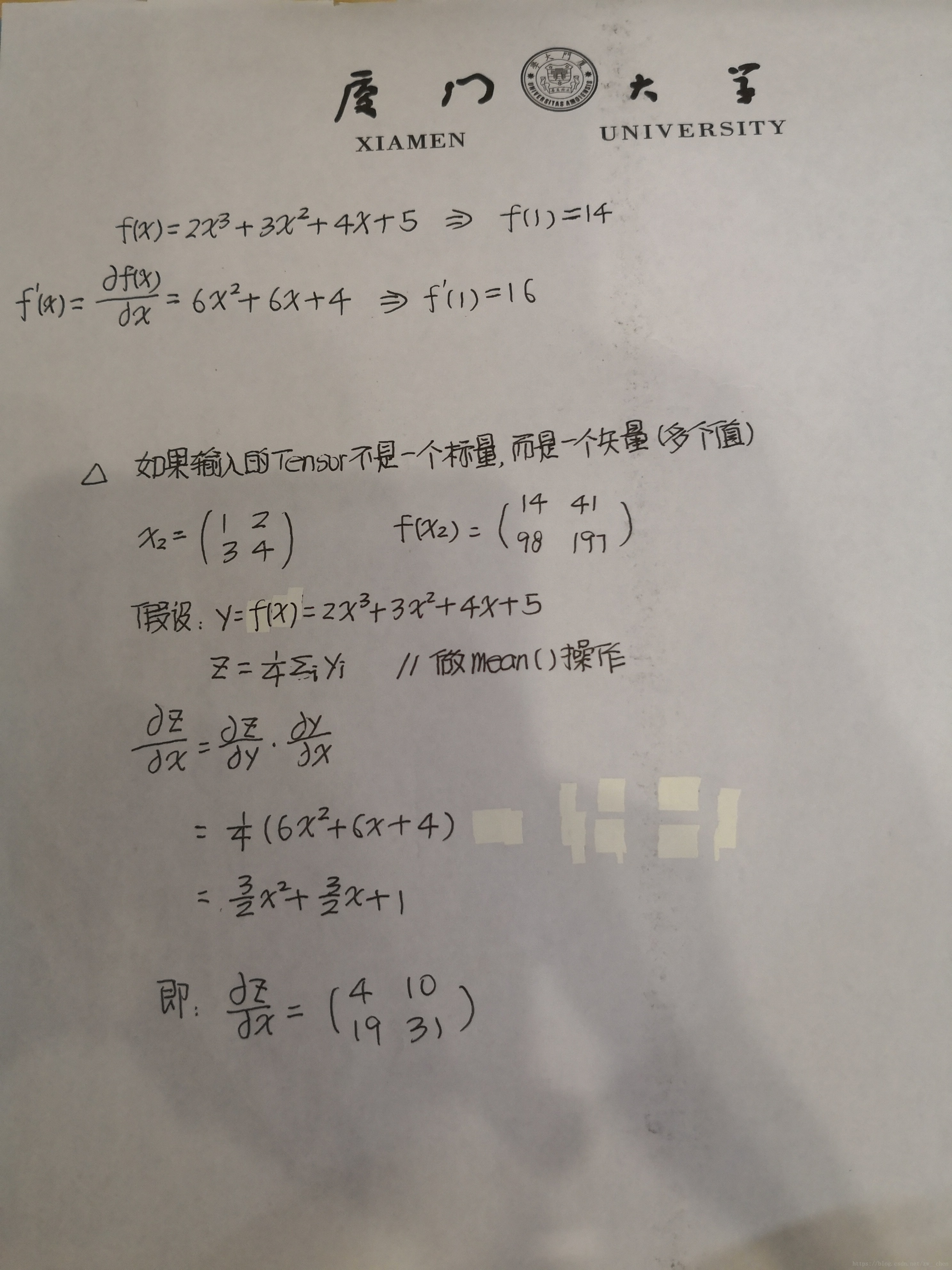

通过调用 backward() 函数,我们自动求出了在 x = 1 的时候的导数 需要注意的一点是:如果我们输入的 Tensor 不是一个标量,而是矢量(多个值)。 那么,我们在调用backward()之前,需要让结果变成标量 才能求出导数。 也就是说如果不将 Y 的值变成标量,就会报错。(可以尝试把mean()给取消,看看是不是报错了)

具体相关的细节见下图: