ACL finding 2021

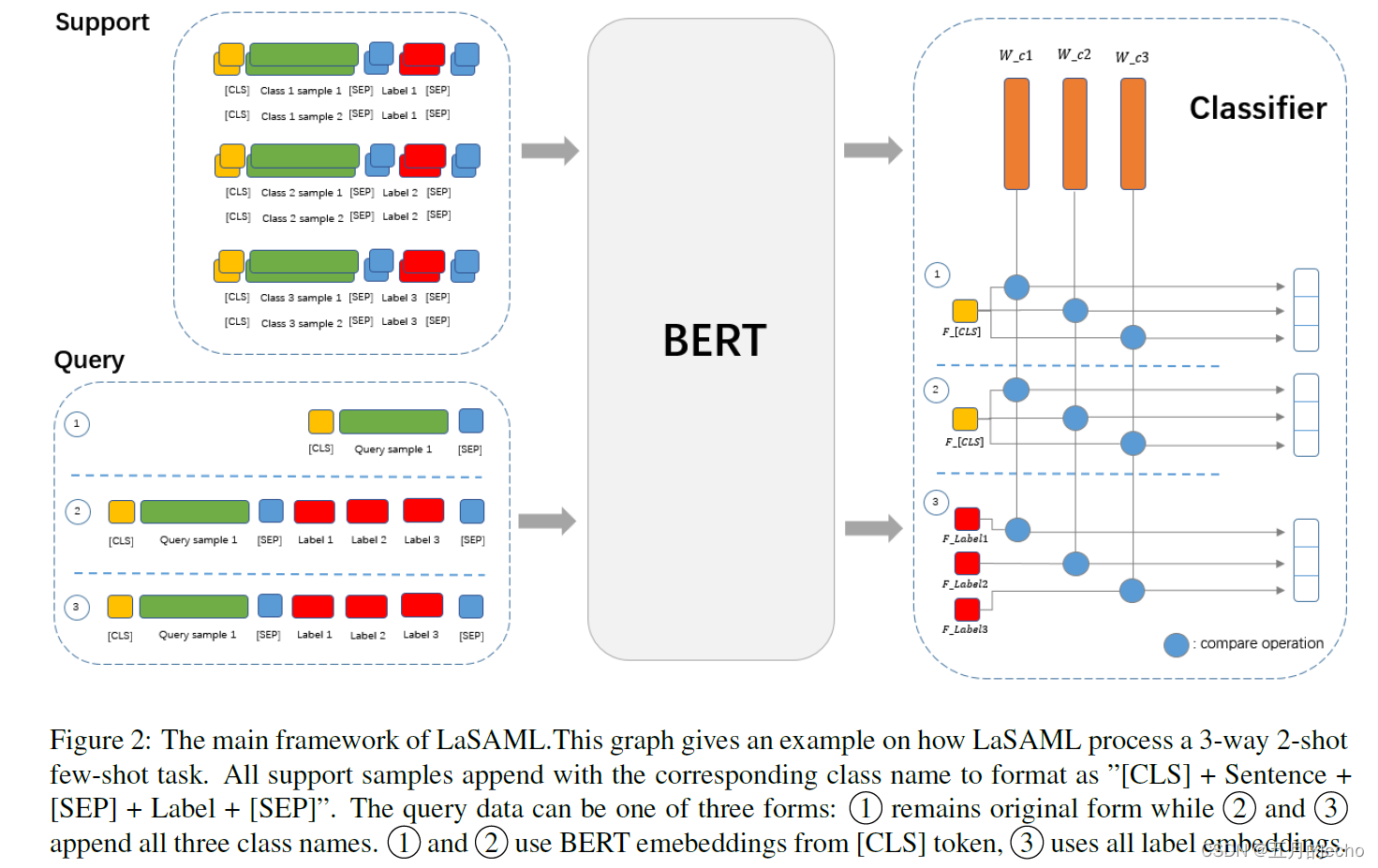

本文证明了分类标签信息可以用来从一个预训练语言模型(如BERT)中提取输入文本的更有区别的特征表示,并且可以在样本稀缺的情况下实现性能提升。在这一发现的基础上,提出了一个名为标签语义增强元学习者(LaSAML)的框架来充分利用标签语义。我们系统地研究了该框架中的各种因素,并表明它可以插入现有的小样本文本分类系统中。

模型总体框架如图所示:

Method

首先,Bert的输入被修改为:“[CLS] sentence [SEP] class name [SEP]”,这已经是NLP中的常见操作了。预测标签对应的class name被转化为Bert特有的预测下一句话的操作。标签的名称所带来的效果已经在许多任务中被探究过,尤其是在低资源的前提下。

形式上来说,在小样本的任务中,目标是学习一个支持集上的