吴恩达机器学习笔记(7)——PCA降维

机器学习个人笔记,学习中水平有限,内容如有缺漏欢迎指正。

序言

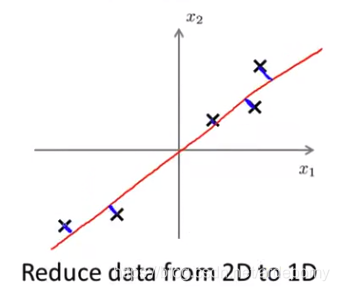

降维的目的是减少数据的维度(将数据投影到低维的空间),或者说减少数据中信息量少的部分,从而加速训练过程,属于无监督学习

代码

代码很简单

import numpy as np

from sklearn.decomposition import pca

origin=np.random.random([10,2])#生成二维随机数据点

pca=pca.PCA(n_components=1)

pca.fit(origin)

x_pca=pca.transform(origin)#执行降维,2维到1维

print(origin)

print(x_pca)

运行结果

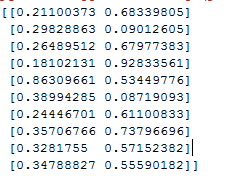

降维前

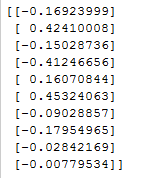

降维后

公式部分(?)

视频并没有讲解PCA的实现公式,但是告诉了我们是通过最小化每个数据点与低维空间的距离和来实现PCA

图片来自学习视频

学习视频

其他笔记

- 机器学习入门

- 目录