本文结合activate learning和bootstrap。

网络结构如图:

操作过程如下:首先使用少量的标注的数据进行训练网络,然后输入未标记的数据,根据提取的有用信息记录需要标记的数据,然后进行标记。下一个阶段使用现在可利用的标记好的所有数据进行训练,一直循环。挑战就是如何将进行信息提取的FCNs和deep active learning framework(分割网络)结合。

来自FCNs的挑战:1,FCNs需要快速训练,使得标注stages之间的时间是可以接受的;2,FCNs需要具有通用性,当训练数据极少时能够产生合理的结果。网络结构如图:

来自active learning的挑战:当决定下一个batch所需要的训练数据时,active learning需要很好的利用FCNs得到的信息。为了这个目的,我们首先证明如何基于bootstrapping估计FCNs的不确定性,和使用FCNs的编码部分的最后一层来估计图像之间的相似性。根据这些信息,我们能够给下一个训练stage决定使用的训练数据。

本文的方法主要由3部分组成:1,新的FCN;2,对FCNs的不确定性和相似性的估计;3,选择最有效训练数据的建议算法。

1. A new fully convolutional network

网络框架如图2。网络有两个输出,一个是用来分割,一个是用来做图像描述器。

2. Uncertainty estimation and similarity estimation

只使用不确定性会导致重复选择需要标注区域,所以还需要选择具有高度表达性的样本(这些样本和许多其它的样本很相似)。Bootstrapping[4]是一种标准的方法用来评估学习模型的不确定性。基本思想就是使用训练集的子集(通过重置抽样得到,重置抽样就是又放回抽样)来训练一系列模型,然后计算这些模型的差异(variance,disagreement)。我们根据这个方法计算FCNs的不确定性。

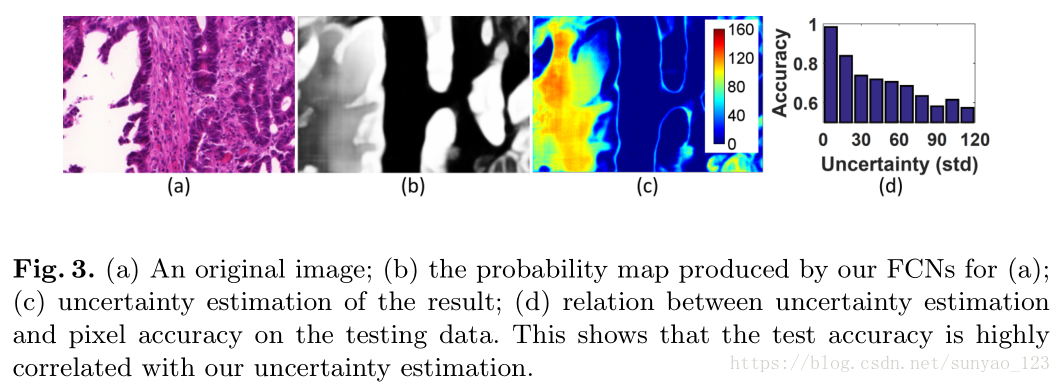

如图3(d),显示了每个像素的不确定性和测试误差具有极强的相关性。最后计算每个训练样本整体的不确定性作为它像素的平均不确定性。

现在能够计算不确定性,接下来计算图片之间的相似性。我们求取FCNs最后一个卷积层的输出的每个通道的平均值作为图片描述器的输出。通过计算这个输出的余弦相似性来计算图片的相似性。为什么这么选择图片描述器呢?是因为1,我们不需要专门训练一个图片描述器;2,因为图片提取图片描述的网络是用来进行分割的,这个输出具有丰富和精确的形状信息。

3. Annotation suggestion

数据的不确定性指,这个数据很难分割;

数据具有表达性是指,数据具有尽可能多的非标注数据的characteristics或者features。

我们选出的数据需要具有这两个性质。因为不确定性相对于重要,我们首先选取K个最大的具有不确定性的子集,然后从这K个样本中选取k个最具表达性的样本(k