一个色子,当对其一无所知时,我们会假设色子每个面出现的概率为1/6;如果已知一个面的概率为1/3,则我们会假设其他面概率为2/15。当我们对一个随机事件的概率进行预测时,我们的预测应当满足所有的已知条件,而对其他未知情况不要做任何主观假设,在这种情况下,概率分布均匀,预测的风险最小,这时的概率分布的信息熵最大。因此叫做最大熵模型。这就是我们通常所说的不要把鸡蛋放在一个篮子里。朴素的理解是当我们遇到不确定性时,我们就要保留各种不确定性,而不是主观臆测出一个偏好。

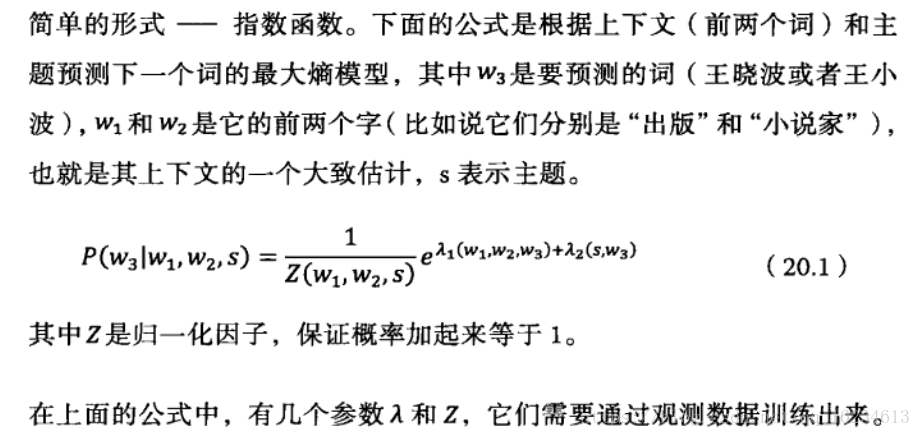

以拼音转汉字为例,对于wang-xiao-bo,可以有王小波和王晓波两种可能结果。至于要确定哪个是唯一结果,即使是利用长的上下文信息也很难做到,但是如果使用文章主题信息则比较方便。如果文章介绍的是文学,则作家王小波可能性较大;如果介绍的是两岸关系,则台湾学者王晓波可能性较大。那么能否同时利用这两种不同信息,建立一个最大熵模型。匈牙利数学家希萨证明了对于不存在自相矛盾的一组信息,最大熵模型不仅存在而且有唯一的指数形式:

最大熵模型简单完美,但计算量大。一开始部分学者试图近似最大熵模型以降低计算量,但反而使其不完美。后有拉纳帕提不使用近似方法,而是找到适合最大熵模型的task,如词性标注和句法分析。从而验证了最大熵模型的优势。

GIS算法迭代很多次才能收敛,而且效果不够稳定,因此在实际过程中很少使用。

最大熵模型可以将各种信息组合到一个统一的模型中,它形式简单优美;从效果上看,是唯一一个既可以满足各信息源的限制条件,同时又能保持平滑性的模型。因而使用范围广泛,唯一缺点就是计算量巨大。