本文代码实验地址:

https://github.com/guojun007/logistic_regression_learning_rate

cousera 上的作业是 编写一个 logistic regression 分类器,为了看看学习率对优化结果的影响,我又私下做了对比实验,

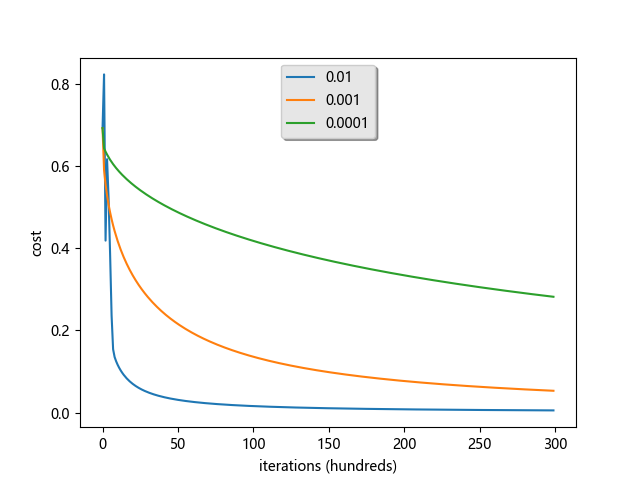

2000次迭代,和30000次迭代,不同实验中分别使用学习率 0.01, 0.001, 0.0001,这个三个学习率。

2000次迭代:

扫描二维码关注公众号,回复:

2138103 查看本文章

30000次迭代

在第一个图中学习率最大的0.01,优化结果先变成最坏的,然后又变成最好的,但是这可能是运行的迭代次数比较少的一个原因,如果运行迭代次数足够大的情况下学习率最小的0.0001会取得更好的优化结果,于是又将运行的迭代次数改为30000,看看能不能验证自己的想法。

在30000次的运行迭代次数中,发现还是最大的学习率0.01取得了最好的优化结果,由此可见学习率小未必能取得最好的优化结果,即使是足够长的运行迭代周期中最小的学习率0.0001也没有取得很好的优化结果。

在30000次迭代和2000次迭代中 学习率0.01 都是最好的设置。