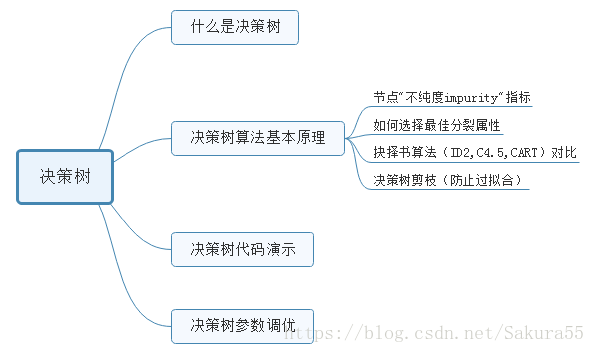

一、提纲

二、什么是决策树

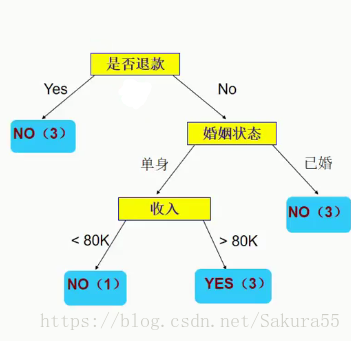

决策树(Decision Tree)是在已知各种情况发生概率的基础上,通过构成决策树来求取净现值的期望值大于等于零的概率,评价项目风险,判断其可行性的决策分析方法,是直观运用概率分析的一种图解法。由于这种决策分支画成图形很像一棵树的枝干,故称决策树。在机器学习中,决策树是一个预测模型,他代表的是对象属性与对象值之间的一种映射关系。

三、属性的分裂

属性的字段类型:

Nominal(类别型)

Ordinal(有序型)

Continuous(连续型)

分裂的数量

二分叉

多分叉

四、怎么判断一个分裂的最好

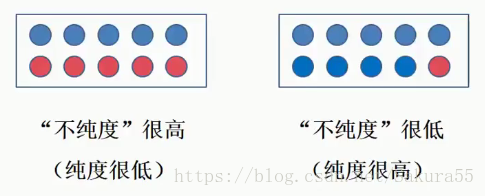

节点的不纯度impurity

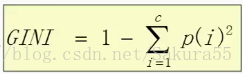

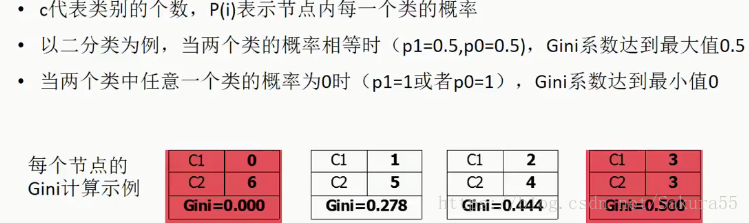

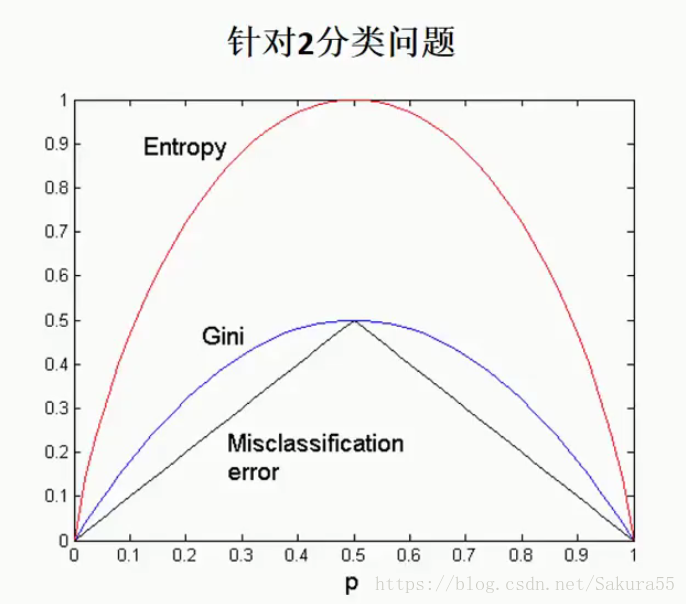

Gini系数

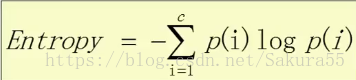

Entropy(熵)

两种判断方法的比较

最后一种叫分类误差

五、最佳分裂

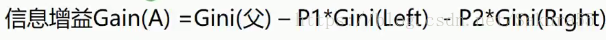

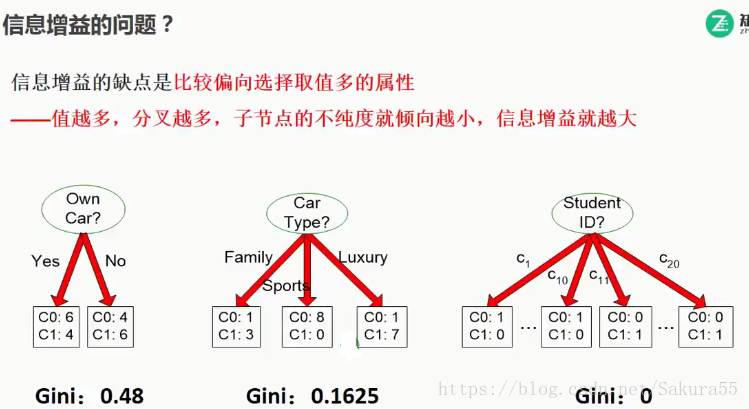

信息增益Gain

Gain最大,分裂xiao过最好,也就是GINI系数最小的时候就最好的时候

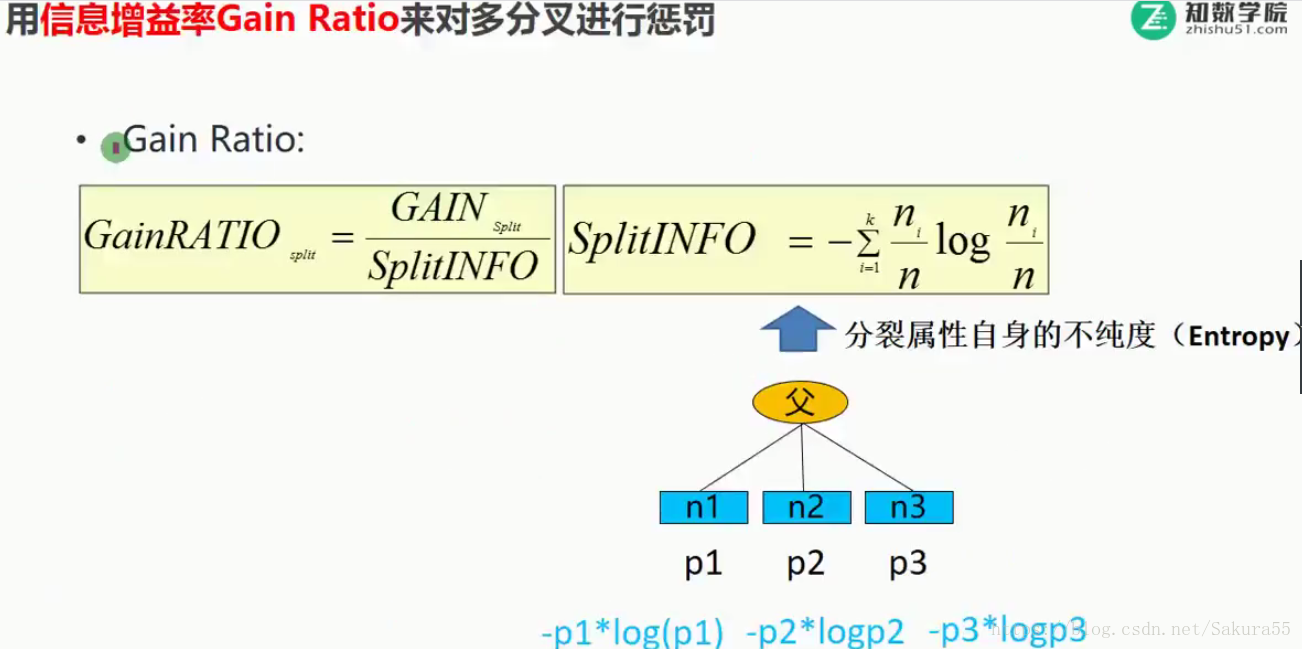

Gain Ratio信息增益率

为了完善分类的信息增益,导入Gain Ratio,即信息增益率

六、决策树算法对比

ID3 处理分类型的变量

C4.5 处理连续型变量,可以处理缺失值

CART 既能做分类,也能做回归,但是只能做二分类树

三者比较

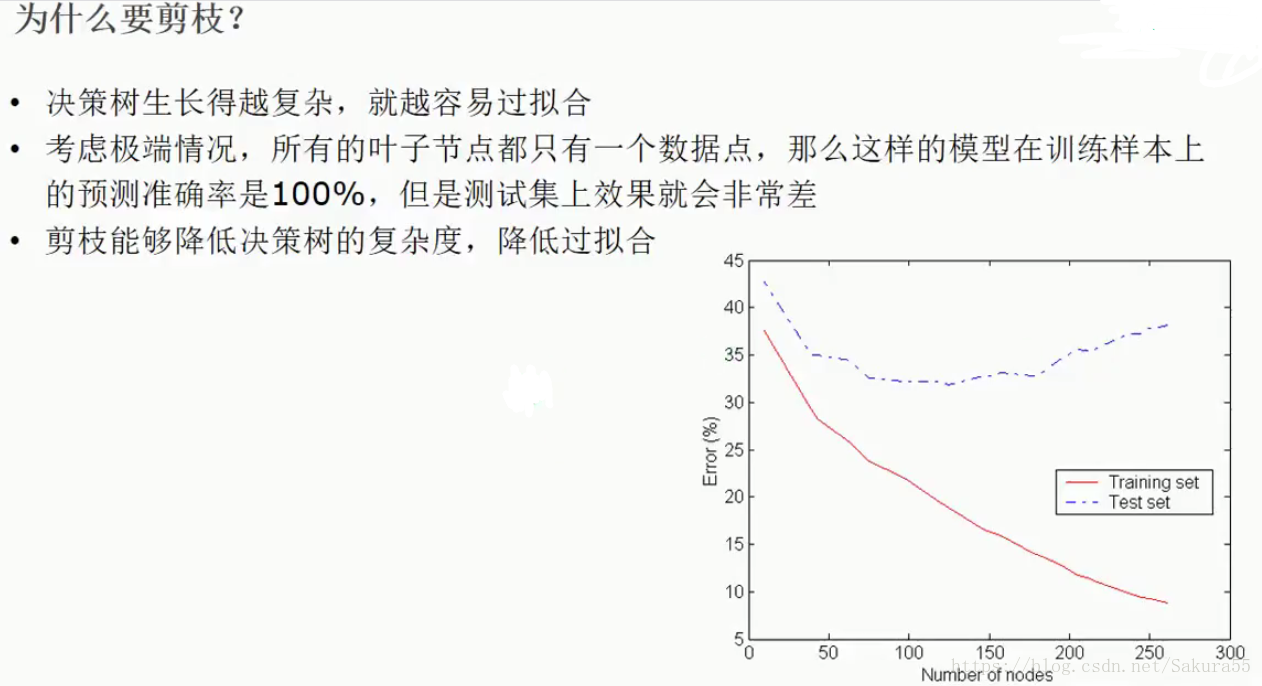

七、剪枝

为什要剪枝

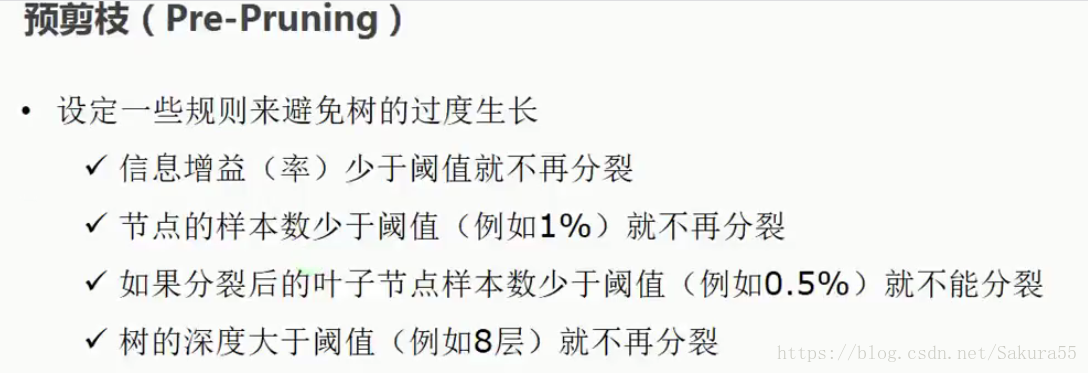

预剪枝

将一颗子树的节点全部删除

后剪枝

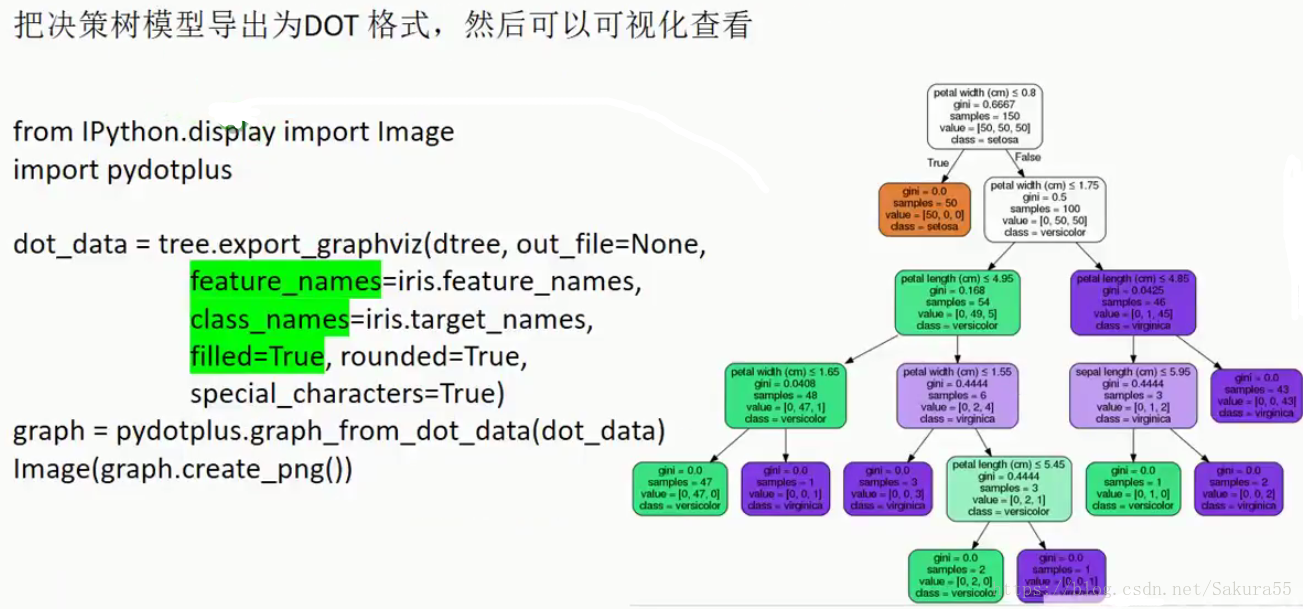

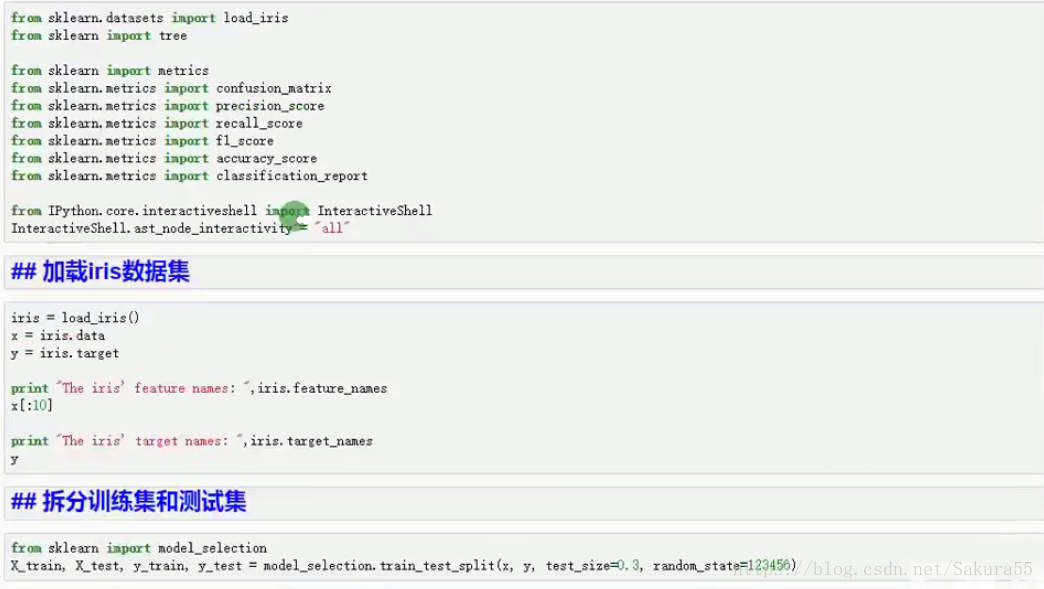

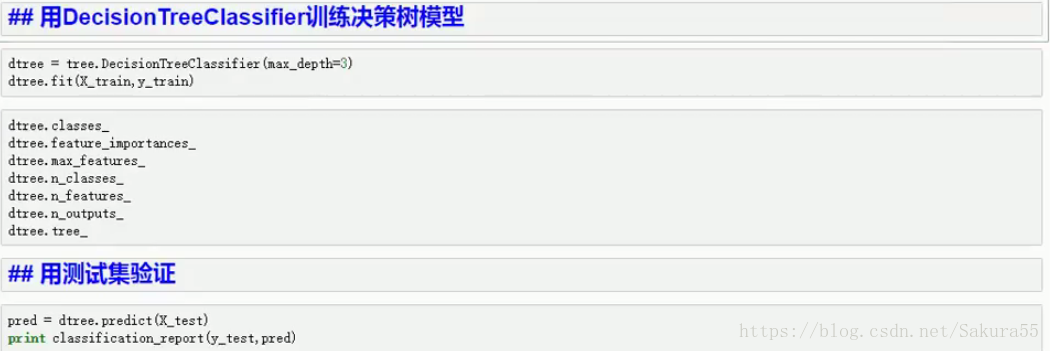

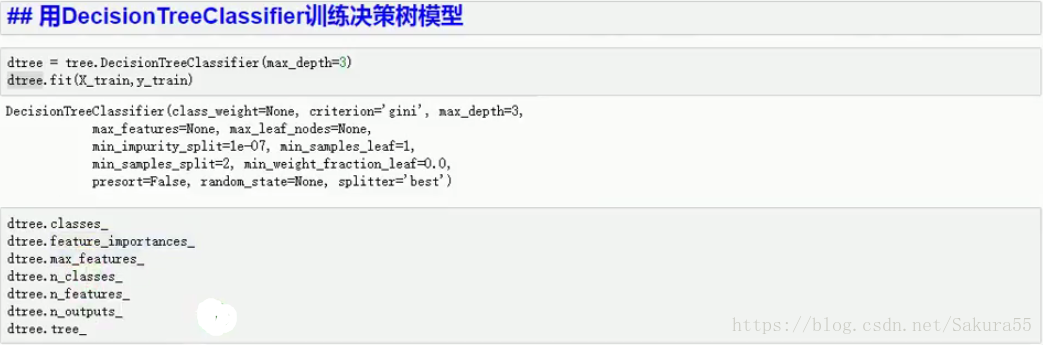

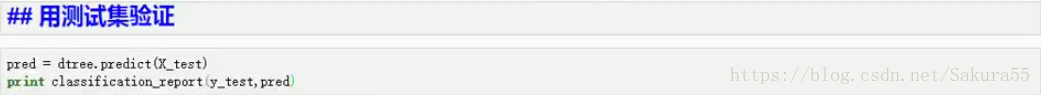

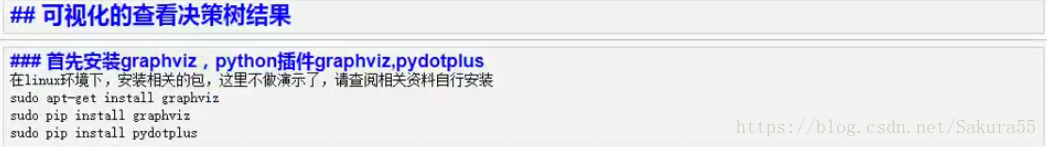

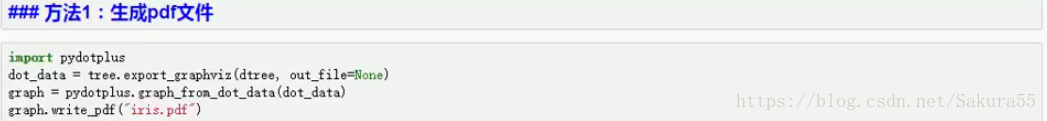

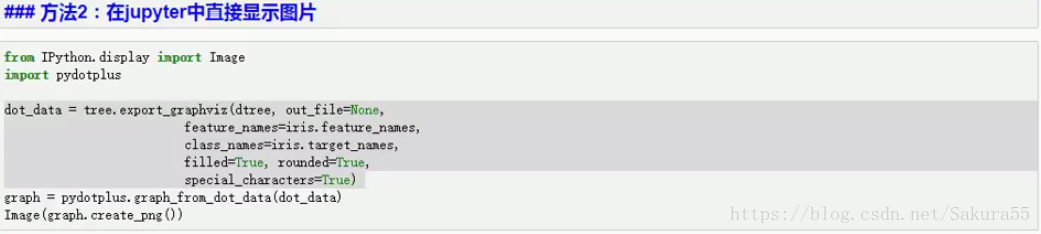

七、代码部分

后期会写项目的时候写完整的解析

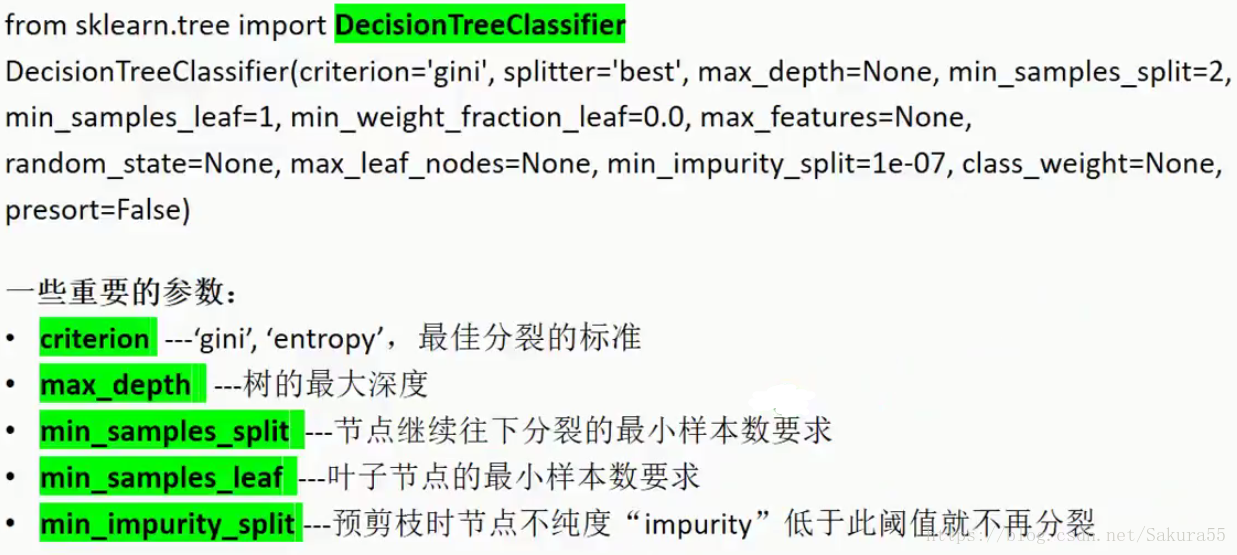

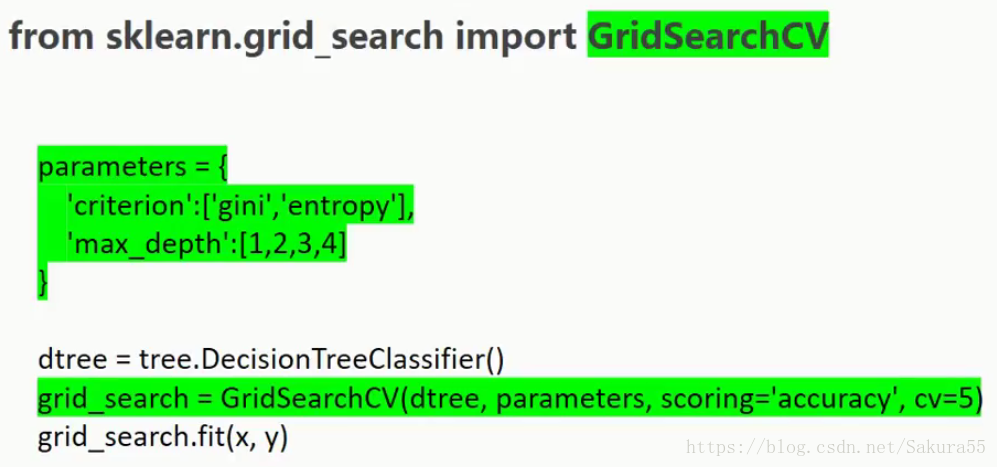

八、参数调优

调节部分如下: