一、算法思路

逻辑回归本质就是基于多元线性回归,多元线性回归就是y=w0 + w1*x1 + w2*x2 + ... + wn*xn

多元函数的值域是(-∞,+∞),逻辑回归就是将值域映射到(0,1)之间,因为这样就可以变成一个概率值。常用的方法是将多元函数求解得到的值,带入sigmoid的函数中即可得到一个(0,1)区间的值;然后控制阈值,就可以进行二分类评定了。当然多分类任务只需要对数据集进行相应的处理,变成多个二分类任务即可。

因为之前写过相关博文,故这里就不再赘述,详情可参考博文:六、逻辑回归

二、官网API

class sklearn.linear_model.LogisticRegression(penalty='l2', *, dual=False, tol=0.0001, C=1.0, fit_intercept=True, intercept_scaling=1, class_weight=None, random_state=None, solver='lbfgs', max_iter=100, multi_class='auto', verbose=0, warm_start=False, n_jobs=None, l1_ratio=None)

这里的参数还是比较多的,具体的参数使用,可以根据官网给的demo进行学习,多动手尝试;这里就以一些常用的参数进行说明。

导包:from sklearn.linear_model import LogisticRegression

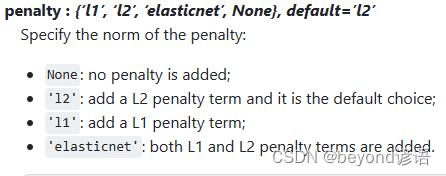

①惩罚项penalty

惩罚项的选择,默认采用L2正则化;正则化说白了就是对损失函数的一种约束限制

在线性回归中,L1正则化也称为Lasso回归,可以产生稀疏模型

在线性回归中,L2正则化也称为Ridge回归,可以获得很小的参数,防止过拟合

‘None’:不添加惩罚项

‘l1’:添加L1正则化

‘l2’:添加L2正则化,默认

‘elasticnet’:L1和L2正则化都加

具体官网详情如下:

使用方式

LogisticRegression(penalty='l2')

这里的惩罚项并不是随便都可以选的,需要受到参数优化算法选择参数solver的约束,默认情况下solver采用lbfgs

②优化算法solver

优化算法选择参数solver,也就是逻辑回归的损失函数优化方法

‘lbfgs’:默认选择;可以选择l2正则化或None不使用惩罚项

‘liblinear’:可以选择l1正则化或l2正则化;小数据集优先考虑、支持多项式损失函数

‘newton-cg’:可以选择l2正则化或None不使用惩罚项;支持多项式损失函数

‘newton-cholesky’:可以选择l2正则化或None不使用惩罚项;训练样本数量远多于特征参数数量时使用

‘sag’:可以选择l2正则化或None不使用惩罚项;数据集较多时使用,训练较快

‘saga’:可以选择l1正则化或l2正则化或None不使用惩罚项;数据集较多时使用,训练较快

具体官网详情如下:

使用方式

LogisticRegression(penalty='l1',solver='liblinear')

LogisticRegression(penalty='l2',solver='newton-cg')

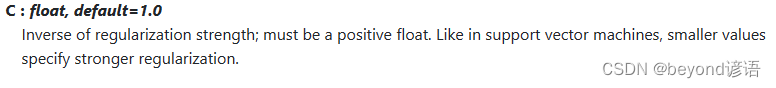

③正则化强度的倒数C

C:正则化强度的倒数;必须是正浮点数;数值越小,正则化强度越强;默认为1.0;

具体官网详情如下:

使用方式

LogisticRegression(C = 1.2)

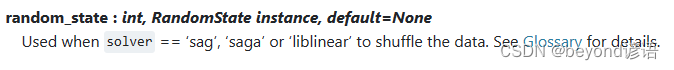

④随机种子random_state

如果要是为了对比,需要控制变量的话,这里的随机种子最好设置为同一个整型数

具体官网详情如下:

使用方式

LogisticRegression(random_state = 42)

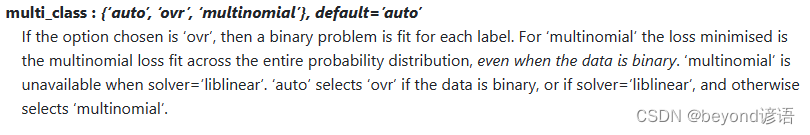

⑤二分类还是多分类任务multi_class

‘auto’:根据任务的具体情况自动设置,默认

‘ovr’:二分类任务;二分类任务或者solver选择了’liblinear’

‘multinomial’:多分类任务;其余情况使用

一般情况不填就行,使用默认的即可

具体官网详情如下:

⑥最终构建模型

LogisticRegression(penalty=‘l2’,solver=‘newton-cholesky’,C=0.8,random_state=42)

三、代码实现

①导包

这里需要评估、训练、保存和加载模型,以下是一些必要的包,若导入过程报错,pip安装即可

import numpy as np

import pandas as pd

import matplotlib.pyplot as plt

import joblib

%matplotlib inline

import seaborn as sns

from sklearn.preprocessing import LabelEncoder

from sklearn.model_selection import train_test_split

from sklearn.linear_model import LogisticRegression

from sklearn.metrics import confusion_matrix, classification_report, accuracy_score

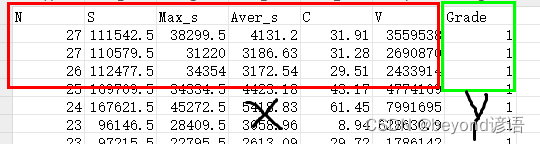

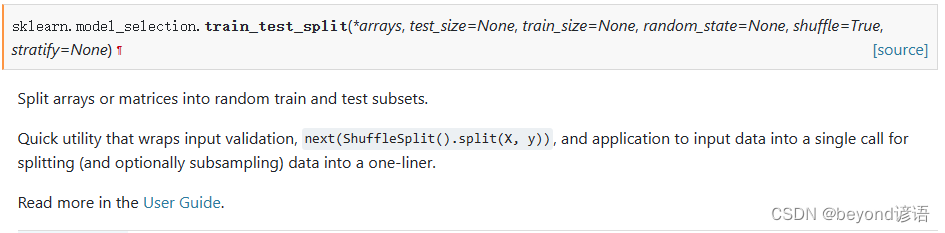

②加载数据集

数据集可以自己简单整个,csv格式即可,我这里使用的是6个自变量X和1个因变量Y

fiber = pd.read_csv("./fiber.csv")

fiber.head(5) #展示下头5条数据信息

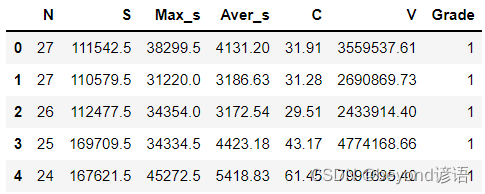

③划分数据集

前六列是自变量X,最后一列是因变量Y

常用的划分数据集函数官网API:train_test_split

test_size:测试集数据所占比例

train_size:训练集数据所占比例

random_state:随机种子

shuffle:是否将数据进行打乱

因为我这里的数据集共48个,训练集0.75,测试集0.25,即训练集36个,测试集12个

X = fiber.drop(['Grade'], axis=1)

Y = fiber['Grade']

X_train, X_test, y_train, y_test = train_test_split(X,Y,train_size=0.75,test_size=0.25,random_state=42,shuffle=True)

print(X_train.shape) #(36,6)

print(y_train.shape) #(36,)

print(X_test.shape) #(12,6)

print(y_test.shape) #(12,)

④构建LR模型

参数可以自己去尝试设置调整

lr = LogisticRegression(penalty='l2',solver='newton-cholesky',C=0.8,random_state=42)

⑤模型训练

就这么简单,一个fit函数就可以实现模型训练

lr.fit(X_train,y_train)

⑥模型评估

把测试集扔进去,得到预测的测试结果

y_pred = lr.predict(X_test)

看看预测结果和实际测试集结果是否一致,一致为1否则为0,取个平均值就是准确率

accuracy = np.mean(y_pred==y_test)

print(accuracy) # 0.8333333333333333

也可以通过score得分进行评估,计算的结果和思路都是一样的,都是看所有的数据集中模型猜对的概率,只不过这个score函数已经封装好了,当然传入的参数也不一样,需要导入accuracy_score才行,from sklearn.metrics import accuracy_score

score = lr.score(X_test,y_test)#得分

print(score)

⑦模型测试

拿到一条数据,使用训练好的模型进行评估

这里是六个自变量,我这里随机整个test = np.array([[16,18312.5,6614.5,2842.31,25.23,1147430.19]])

扔到模型里面得到预测结果,prediction = lr.predict(test)

看下预测结果是多少,是否和正确结果相同,print(prediction)

test = np.array([[16,18312.5,6614.5,2842.31,25.23,1147430.19]])

prediction = lr.predict(test)

print(prediction) #[2]

⑧保存模型

lr是模型名称,需要对应一致

后面的参数是保存模型的路径

joblib.dump(lr, './lr.model')#保存模型

⑨加载和使用模型

lr_yy = joblib.load('./lr.model')

test = np.array([[11,99498,5369,9045.27,28.47,3827588.56]])#随便找的一条数据

prediction = lr_yy.predict(test)#带入数据,预测一下

print(prediction) #[4]

完整代码

模型训练和评估,不包含⑧⑨。

import numpy as np

import pandas as pd

import matplotlib.pyplot as plt

%matplotlib inline

import seaborn as sns

from sklearn.preprocessing import LabelEncoder

from sklearn.model_selection import train_test_split

from sklearn.linear_model import LogisticRegression

from sklearn.metrics import confusion_matrix, classification_report, accuracy_score

import joblib

fiber = pd.read_csv("./fiber.csv")

# 划分自变量和因变量

X = fiber.drop(['Grade'], axis=1)

Y = fiber['Grade']

#划分数据集

X_train, X_test, y_train, y_test = train_test_split(X, Y, random_state=0)

lr = LogisticRegression(penalty='l2',solver='liblinear',C=0.8,random_state=42)

lr.fit(X_train,y_train)#模型拟合

y_pred = lr.predict(X_test)#模型预测结果

accuracy = np.mean(y_pred==y_test)#准确度

print(accuracy)

score = lr.score(X_test,y_test)#得分

print(score)