算法说明:逻辑回归假设数据模型为努伯利分布,利用极大似然估计构建逻辑回归模型

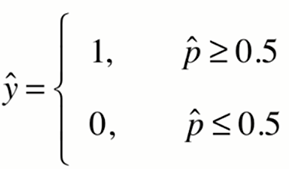

算法目的:处理分类问题,将连续数据输出离散二进制(0或1)(是否问题)

算法过程:利用sigmiod函数将任意实值映射为[0,1]范围内的值----------->

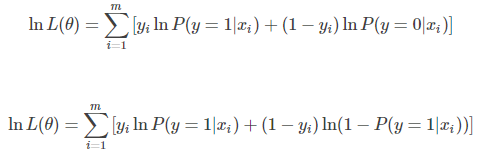

参考极大似然估计的方法得到损失函数(代价函数),得到高阶可导的凸函数------------------>

利用梯度下降的方法最终求得 值,最终得到逻辑回归模型

sigmoid函数:![]()

努伯利分布:

极大似然估计的对数似然函数:

参考对数似然函数得到损失函数:

单个损失估计:![]()

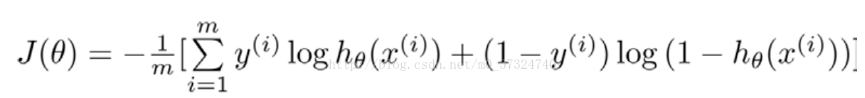

整个样本损失:

对于一般逻辑回归,令x=x 或者 (x=

),则推导得逻辑回归损失函数为:

其中,y(i)表示运算出的lable(标签),其值为0或1;

等于输入的第 i 个数据;

采用梯度下降法求得

最终求得逻辑回归模型: