1. Logistic Regression 模型

1.1 logistic 分布

定义:设

X 是连续随机变量,

X 服从 logistic 分布是指

X 具有下列分布函数和密度函数:

F(x)=P(X≤x)=1+e−(x−μ)/γ1

f(x)=F′(x)=γ(1+e−(x−μ)/γ)2e−(x−μ)/γ

式中

μ 为位置参数,

γ>0 为形状参数

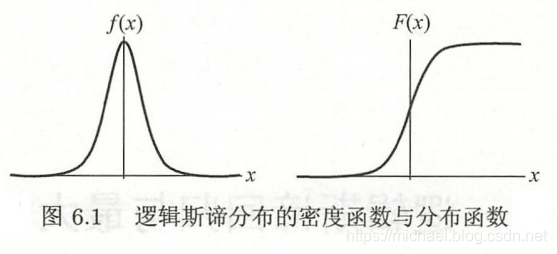

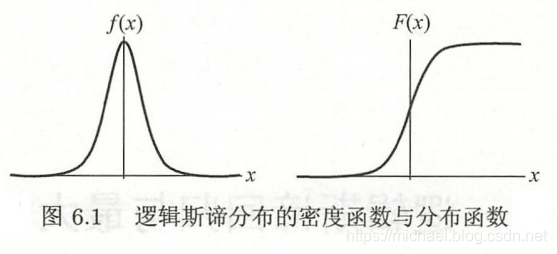

分布函数

F(x) 是一条S形曲线 sigmoid curve,曲线以点

(μ,21) 为中心对称,即满足:

F(−x+μ)−21=−F(x+μ)+21

形状参数

γ 的值越小,曲线在中心附近增长越快

1.2 二项逻辑斯谛回归模型

binomial logistic regression model 是一种分类模型,由条件概率分布

P(Y∣X) 表示, 形式为参数化的逻辑斯谛分布。这里,随机变量

X 的取值为实数,随机变量

Y 取值为 1 或者 0。用监督学习的方法来估计模型参数。

二项逻辑斯谛回归模型具有下面条件概率分布:

P(Y=1∣x)=1+exp(wx+b)exp(wx+b)

P(Y=0∣x)=1+exp(wx+b)1

w 是权值向量,

b 是偏置,

w⋅x 为

w 和

x 的内积(内积,对应位置相乘,再加总)

按照上面式子,可以求得

P(Y=1∣x) 和

P(Y=0∣x),LR模型将实例

x 分到概率较大的那一类。

事件的几率(odds)是指该事件发生的概率

p 比上 不发生的概率

1−p,该事件的对数几率即

logit(p)=log1−pp

对于LR来讲,

log1−P(Y=1∣x)P(Y=1∣x)=w⋅x,就是说,

Y=1 的对数几率是输入

x 的线性函数

1.3 模型参数估计

LR模型学习时,对于给定的训练数据集

T={(x1,y1),(x2,y2),...,(xN,yN)}, 其中,

xi∈Rn,yi∈{0,1}, 应用极大似然估计,得到 LR 模型

假设:

P(Y=1∣x)=π(x),P(Y=0∣x)=1−π(x)

似然函数为:

∏i=1N[π(xi)]yi[1−π(xi)]1−yi

对数似然函数:

L(w)=i=1∑N[yilogπ(xi)+(1−yi)log(1−π(xi))]=i=1∑N[yilog1−π(xi)π(xi)+log(1−π(xi))]=i=1∑N[yi(w•xi)−log(1+exp(w•xi))]

对

L(w) 求极大值,得到

w 的估计值。

1.4 多项逻辑斯谛回归

上面介绍的是两类分类LR模型,可以推广到多类分类。

假设离散随机变量

Y 的取值集合是

{1,2,...,K}, 那么多项LR模型是:

P(Y=k∣x)=1+∑k=1K−1exp(wk•x)exp(wk•x),k=1,2,...,K−1

P(Y=K∣x)=1+∑k=1K−1exp(wk•x)1

这里,

x∈Rn+1,wk∈Rn+1 (把

w•x+b 合并写做

w•x,所以

n 维变成

n+1 维)