个人不太懂的点

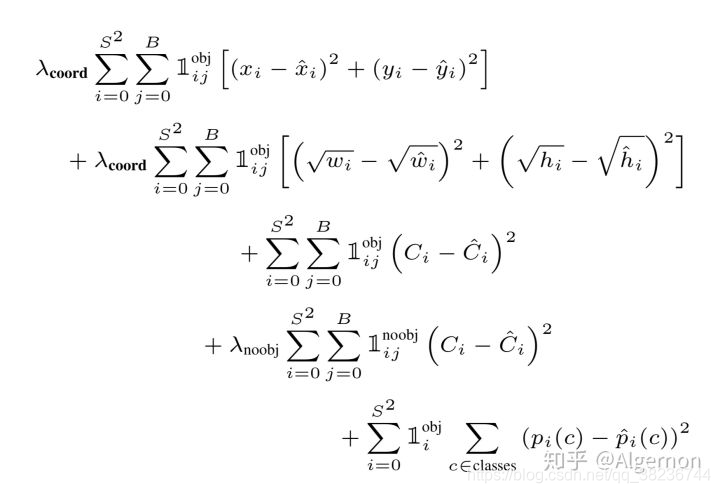

1.损失函数的4与5项

https://www.youtube.com/watch?v=NkFENlEb4kM&t=672s

训练阶段:

C_i 预测值:由网络输出出来7*7*30中第一个bbox和第二个bbox的置信度confidence

C_i^hat 标签值:论文中定义为Pr(Object)*IOU(预测框与真实框的IOU)

ps:

1.1.C_i^hat 在yolov1定义为两者iou,但是之后v1作者用的iou,v3就变成1了。1确实收敛更稳定

1.2.代码实现中也有相当一部分直接采用1作为标签值

个人理解部分:

由1和2项让bbox检测框逐渐学习到真实框的位置,位置上逼近。由3项让检测框与真实框加速逼近

1和2项,让xy,wh更拟合。

而3中极端情况两者之间无交集iou等于0,1和2项会非常大,损失函数非常大

3中最理想情况,两者重合iou等于1,于是让C_i预测值逼近1,意义上来说也就是100%有物体。1和2接近于直接没了,12加起来损失部分很小

(纯猜想)折衷情况,两者有交集但是交集部分不多,作者想让这时候的预测框bbox置信度学习逼近为IOU的值,因为预测框bbox在xywh上虽然与真实框有差距可以用数字来表示,但是不够直观,作者决定用预测框bbox与真实框的IOU作为此时预测框bbox该有百分之多少可以值得信赖,也就是置信度。也就是C_i逐渐逼近两者的iou,换句话来说要以iou作为值得信赖的榜样。 但实际情况上面说了,还不如用1稳定,后面估计作者也放弃了,折衷情况用iou模拟不好,不如直接逼近1,也就是两者直接重合的情况。

2.inception modules

3.1*1 reduction 1*1卷积层 常用于令大小不变 但是变更通道数,分散特征

reduction这个词由来:在深度学习中,1x1卷积通常用于减少特征图的维度,这个过程被称为“1x1卷积的降维”或“1x1卷积的减少(reduction)”

4.神经网络计算过程