- 分类模型

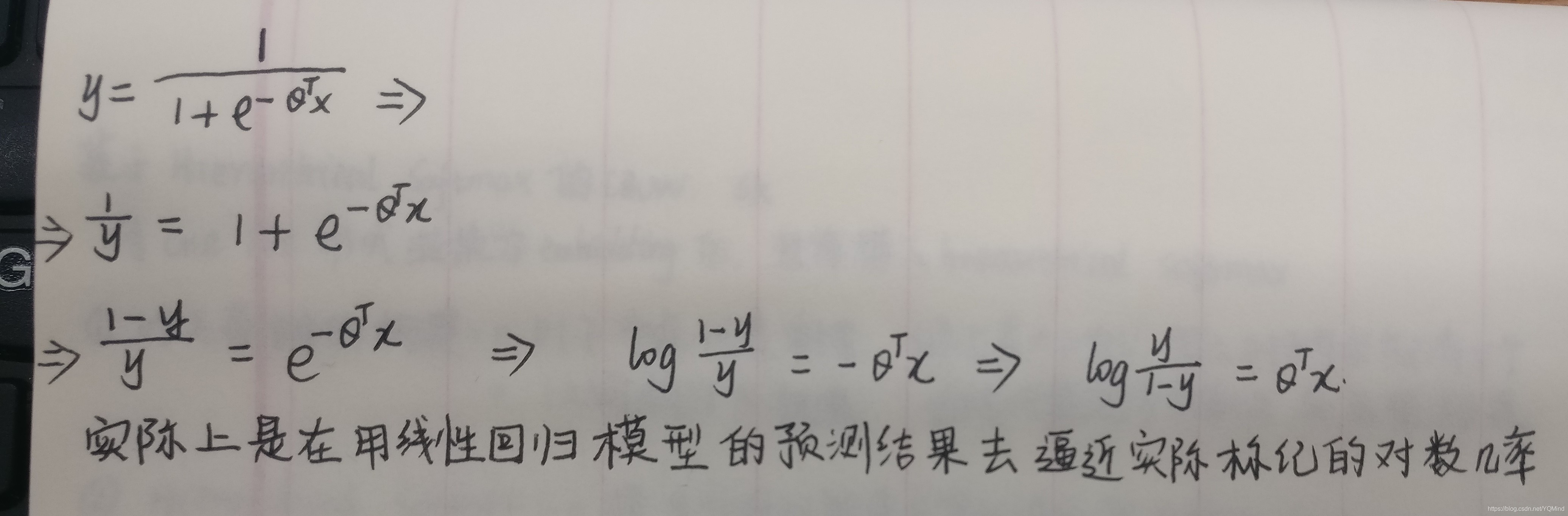

- 本质上是线性回归模型

- 优化目标

,最小化

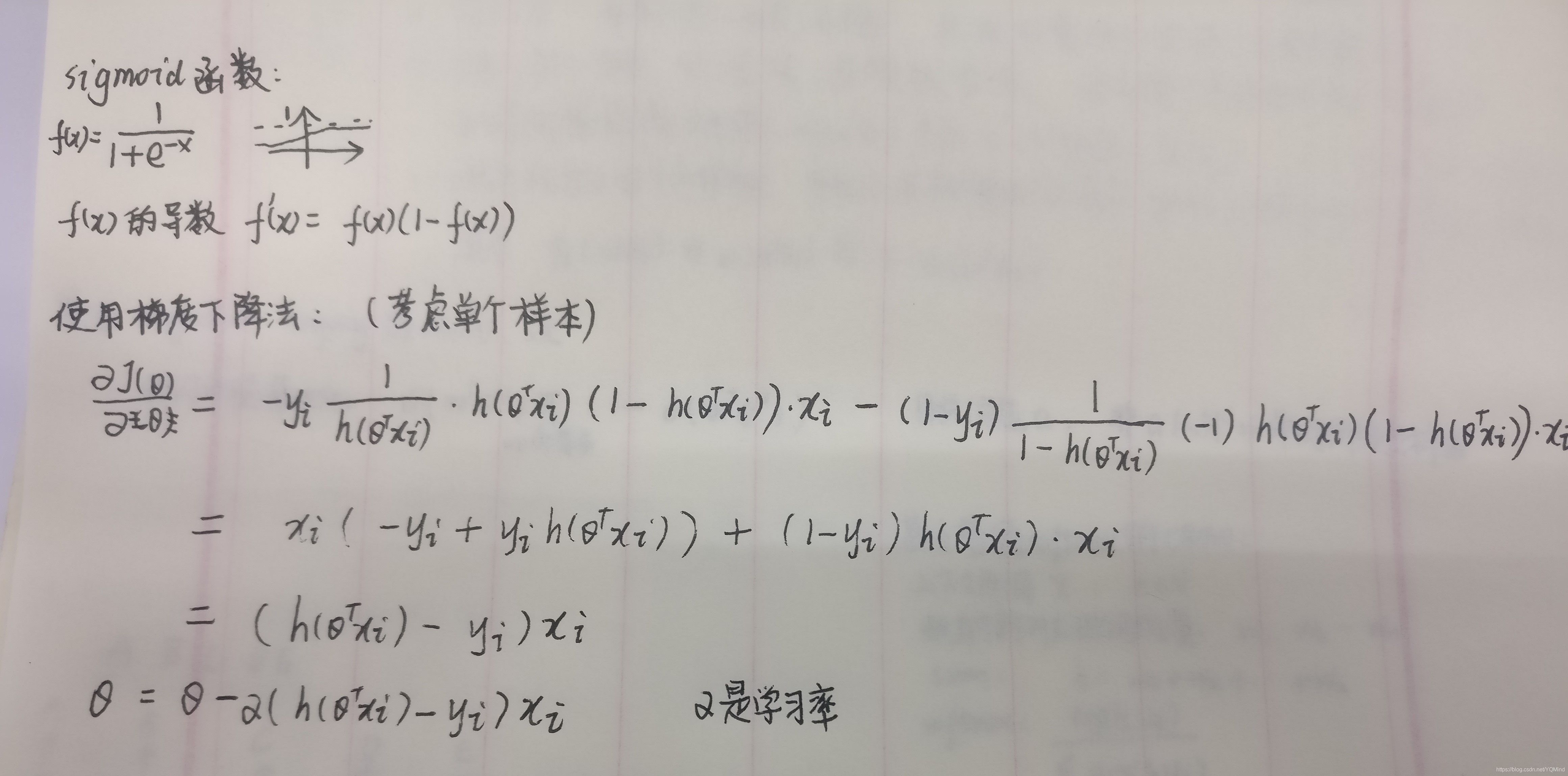

其中 ,是sigmoid函数

linear regression和logistic regression都属于广义线性模型,linear regression是将高斯分布放在广义线性模型下推导得到的,logistic regression是将伯努利分布放在广义线性模型下推导得到的,softmax regression是将多项式分布放在广义线性模型下推导得到的。

推导请见:

https://www.zhihu.com/question/35322351/answer/67117244

LR和linear SVM的异同

同:

- 都是线性分类器,模型求解的是超平面

- 都是监督学习算法

- 都是判别模型

异:

-

本质上loss function不同,LR采用logistic loss,SVM采用hinge loss

-

SVM只考虑支持向量,而LR考虑所有数据,因此如果数据strongly unbalanced,一般需要对数据做balance

-

LR基于概率理论,SVM基于几何间隔最大化原理。因此LR的输出具有概率意义,SVM的输出没有概率意义。

-

在解决非线性问题时,SVM采用核函数的机制,LR通常不采用核函数的方法(每个样本点都要参与核计算,计算量太大)

-

SVM依赖数据表达的距离测度,所以需要对数据进行标准化。不带正则项的LR不受影响,但是使用梯度下降法求解时,为了更好的收敛,最好进行正则化。

-

SVM自带正则,LR需要添加上正则项

-

根据经验来看,对于小规模数据集,SVM的效果要好于LR,但是大数据中,SVM的计算复杂度受到限制,而LR因为训练简单,可以在线训练,所以经常会被大量采用

[1] https://www.cnblogs.com/zhizhan/p/5038747.html

[2] https://www.zhihu.com/question/26768865/answer/34048357

[3]https://blog.csdn.net/haolexiao/article/details/70191667