当前方法的问题

全卷积网络解决了像素标记问题,出现了几种用于显着物体检测的端到端深度架构。 输出显着性图的基本单位从图像区域开始变成每个像素。 一方面,由于每个像素都有其显着性值,结果突出显示了细节。 但是,它忽略了对SOD重要的结构信息。随着网络感受野的增加,显著性物体的位置越来越准确,但是空间连贯性仍然被忽略了。显著边缘信息和显著物体信息的互补性也没有被注意到。

怎么解决这个问题

利用显著边缘特征帮助显著物体特征更准确的定位物体(尤其是边界)。

动机:良好的显着边缘检测结果可以在分割和定位方面帮助显着对象检测任务,反之亦然

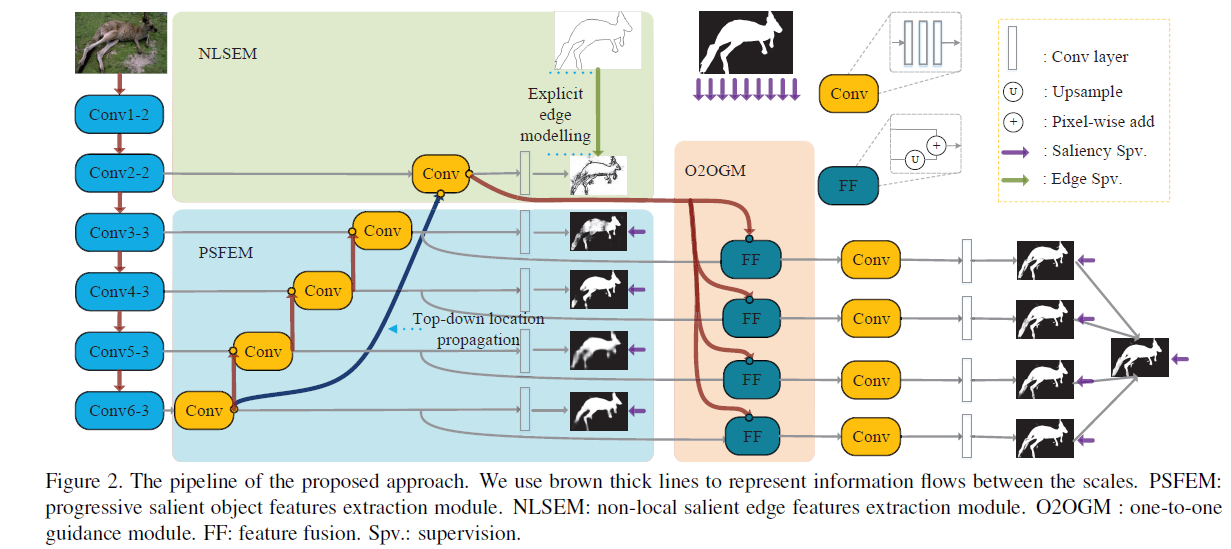

网络结构

使用VGG16的去全连接层的部分,由于第一个卷积块离输入近且感受野小,扔掉不用,在第五个卷积块后增加第六个卷积块。

1.渐进显著性物体特征提取:

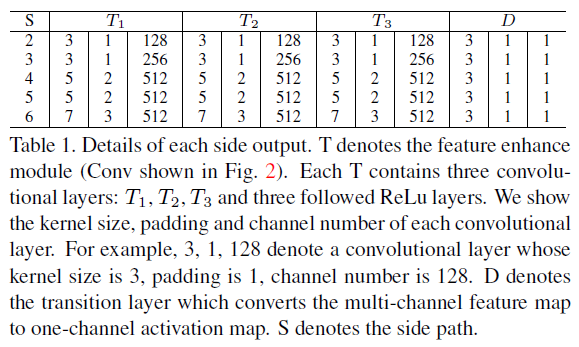

PSFEM模块。为了获取鲁棒性更好的显著物体特征,在每条支路后面增加三个卷积层,每个卷积层后有一个RELU层,再通过一个卷积层将将特征图转换成单通道的预测图。具体参数见表1。

2.非局部显著边缘特征提取

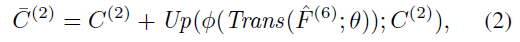

通过conv2-2提取局部边缘信息。自顶向下将顶层的位置信息传播到第二层。融合的第二层特征如下

![]() 表示为了改变特征通道数的卷积层,

表示为了改变特征通道数的卷积层,![]() 表示ReLU激活函数,

表示ReLU激活函数,![]() 是将输入上采样到C(2)大小的双线性插值操作。为了简便,用

是将输入上采样到C(2)大小的双线性插值操作。为了简便,用![]() 来表示

来表示![]() ,

,![]() 表示第六层经过增强之后的特征,第六层的增强操作可以表示为

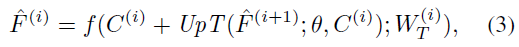

表示第六层经过增强之后的特征,第六层的增强操作可以表示为![]() ,第三、四、五层的增强特征可以这样计算,

,第三、四、五层的增强特征可以这样计算,

![]() 表示

表示![]() 卷积中的参数,

卷积中的参数,![]() 表示一系列的卷积操作。在得到

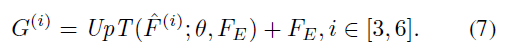

表示一系列的卷积操作。在得到![]() 后,同样进行一系列卷积处理得到最终显著边缘特征,可以这样表示

后,同样进行一系列卷积处理得到最终显著边缘特征,可以这样表示![]() 记做

记做![]() 。

。

3.一对一引导模块

利用显著边缘特征引导显著物体特征在分割和定位上表现的更好。直接融合显著边缘特征和多分辨率显著物体特征时,边缘特征会被淡化,于是采用一对一引导。在每一层将显著边缘特征融合到增强的显著物体特征中去,使高层特征的定位更加准确,对每层的增强后的显著物体特征上采样后与显著边缘特征相融合,得到显著边缘引导特征s-feature,具体操作如下。

与PSFEM类似,对每一层的融合特征进行一系列的卷积操作,然后转换成单通道预测图,通过公式3,得到增强后的s-feature![]() 。

。

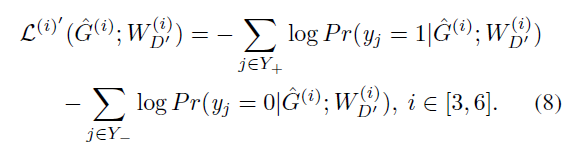

损失函数

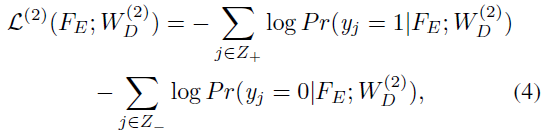

显著边缘特征部分的损失函数,![]() 分别表示显著边缘像素集合和背景像素集合,

分别表示显著边缘像素集合和背景像素集合,![]() 表示???。。。暂时还没看懂

表示???。。。暂时还没看懂

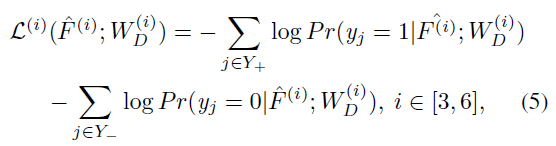

显著物体检测的损失函数,![]() 分别表示显著区域像素集合和非显著区域像素集合,

分别表示显著区域像素集合和非显著区域像素集合,![]()

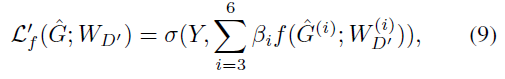

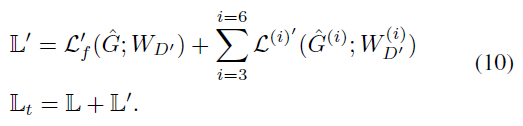

特征提取部分的总损失函数:

对每层得到的输出预测图计算损失,

然后融合多尺度的预测图得到一张融合图,这一步的损失为:

其中![]() 表示预测图和GT的交叉熵损失,与公式5结构一样。最后一对一引导模块的损失和该方法的总损失函数如下。

表示预测图和GT的交叉熵损失,与公式5结构一样。最后一对一引导模块的损失和该方法的总损失函数如下。

实验

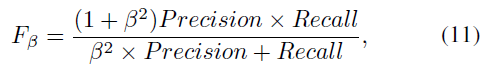

评价指标:F-measure:

MAE:

S-measure:

![]()

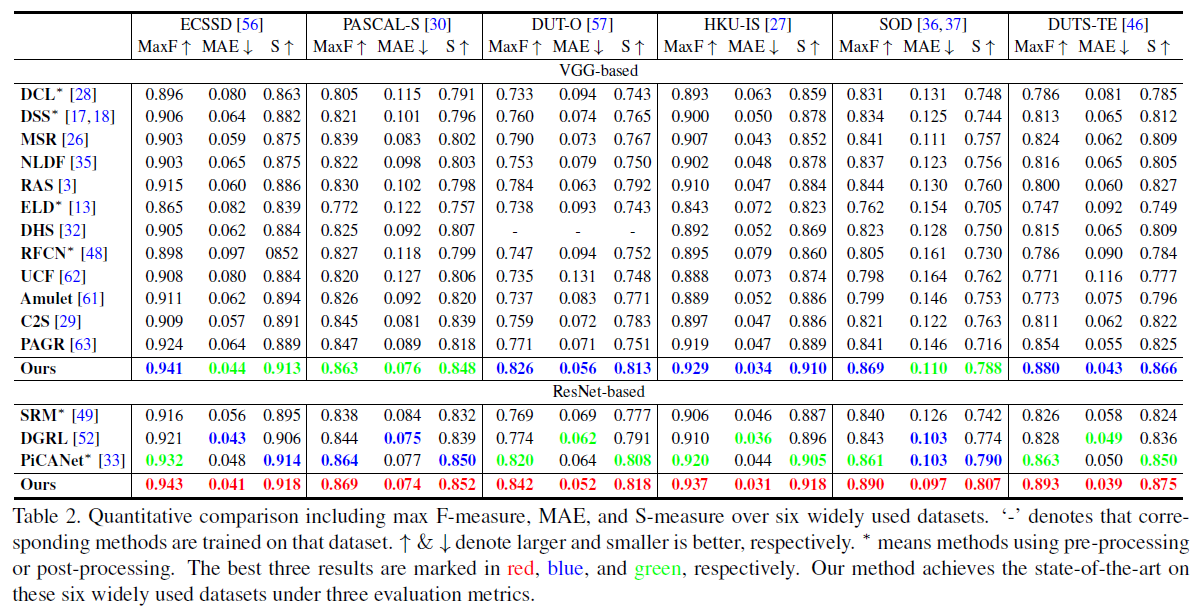

对比结果: