Cross View Link Prediction by Learning Noise-resilient Representation Consensus

目标

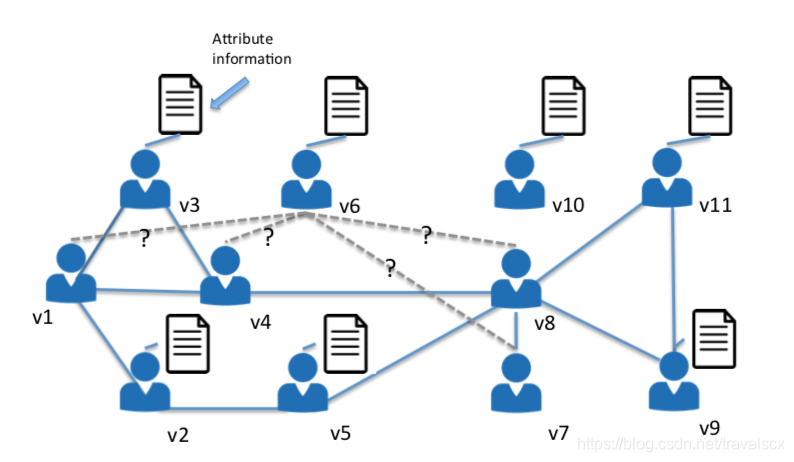

在一个网络中(社交网络/生物网络/计算机网络。。),有的节点有属性信息,有的节点会和其他人相连,有的节点既有属性信息又和其他节点相连。

论文提出一种问题叫Cross View Link Prediction,也就是我们要预测一个网络中的连接,但与以往不同的是,这个预测可以给只有连接的顶点连接只有属性的节点,或者给只有属性的节点推荐只有连接的节点。

方法

方法分成两部分

- 顶点的embedding

- REPRESENTATION CONSENSUS LEARNING

顶点的embedding

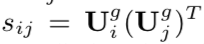

给出一个triple(i,j,k),其中i 和j是邻居,而i和k不是邻居,在嵌入后,我们要将i和j在嵌入空间中比i和k更相似。公式表达为:

sij是顶点i和j的相似度,使用内积来表示。

sijk是表示顶点i和j的相似度和i和k的相似度的差,我们要让差最大,也就是i和j比和k更相似。

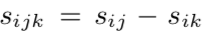

同时,我们要限制顶点的向量表达不能太夸张,也就是要有正则项来约束:

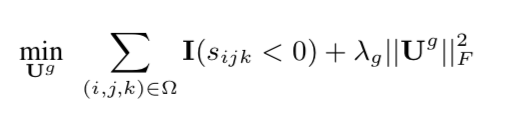

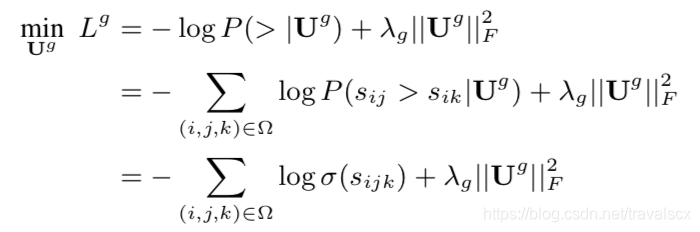

因此,我们的embedding的目标函数可以为:

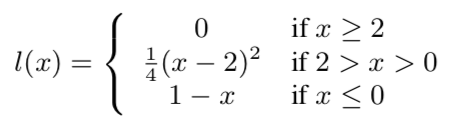

I就是sijk小于0的个数,个数越少表示邻居相似的越多,越好。

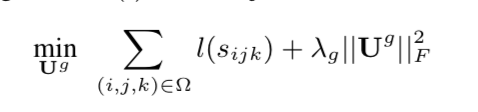

由于I是0/1loss,不平滑,因此可以用更加平滑的loss来表示:

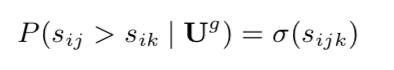

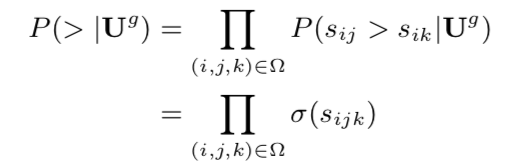

可以有:

- PRL:Probabilistic Representation Learning

也就是概率min

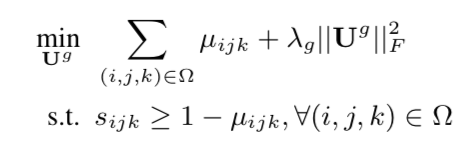

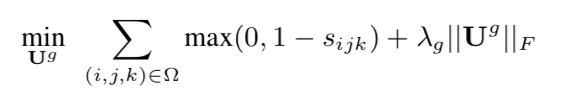

- Max Margin Representation Learning (MMRL)

就是SVM的loss

将有连接的顶点和属性的节点align在一起

在这里,我们要学习到如何使用特征来表达向量

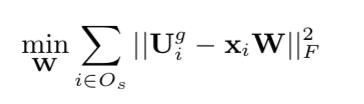

对顶点上面已经学习到的向量Ui来说,要将这个顶点的feature表示它的向量在有权重的时候更相似:

也就是Ui是使用link来学习到的向量,xi是feature表示顶点的向量,xi在权重w下和Ui十分相似。

这个xi是使用特征来表示的,我们的目的是为了找到w,这样可以把他们align在一起。

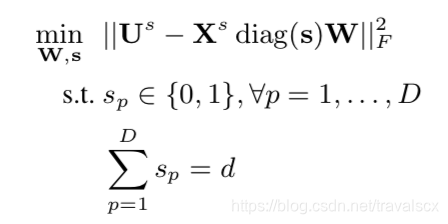

由于一个顶点的特征有很多,我们要选择其中top-d个特征,下面公式的s是一个对角矩阵,1表示选择这个特征。

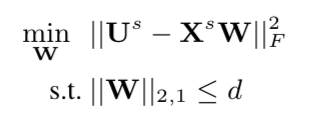

将s和w写在一起:

综合目标函数

Lg是embedding的目标函数,La是对feature 和顶点vector align的目标函数。学习目标函数以后,我们就有了含有link的节点的表达,同时也有了将feature align成顶点表达的w权重。

对于一个只有feature的顶点,给他推荐其他的顶点,我们就可以将它的feature经过W变换后,找和它有相似的vector的顶点。

optimization

优化就是如何将参数优化,论文给出了之前提出的两种目标函数分别的优化方法。