1.代价函数

神经网络层数L,表示L层(最后一层)神经元个数,

表示每层的输出神经元数

二类分类:=1 输出层有一个神经元,输出的y是一个实数 y = 0 or 1 表示类别

多类别分类:一共有K类,则=K,输出层有K个神经元, (K>=3)输出是一个K维向量

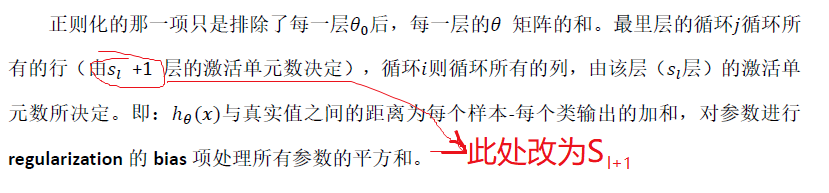

代价函数:

![]()

每一行特征都会给出K个预测,可以利用循环对每一行特征都预测K个不同的结果,然后在利用循环在K 个预测中选择可能最高的一个,将其与y中的实际数据进行比较

2.反向传播

前向传播:第一层为样本输入,第二层开始每一层的Z都是上一层的 θ*a

:可以理解为第l(这是小写的L)层的第i个预测(

)在它的下一层的第j个预测(

)中占的比重

反向传播:

从最后一层的误差开始计算,误差是激活单元的预测()与实际值(

)之间的误差,

![]()

注:下面的等价于之前的

3.使用神经网络时的简要步骤