朴素贝叶斯概要

不确定性知识表示与推理

- 贝叶斯定理

- 朴素贝叶斯算法

- 算法基本流程

- 朴素贝叶斯算法的优缺点

- 朴素贝叶斯算法性能

- 算法小结

贝叶斯定理

贝叶斯定理的核心思想:选择具有最高概率的决策。贝叶斯概率引入先验知识和逻辑推理来处理不确定命题。

条件概率:

表示事件B已经发生的前提下,事件A发生的概率,叫做事件B发生下事件A的条件概率,条件概率公式为

。

一般我们可以很容易直接得出P(A|B),P(B|A)则很难直接得出,但我们更关心P(B|A),贝叶斯定理就为我们打通从P(A|B)获得P(B|A)的道路。可以使用贝叶斯准则来交换概率中条件与结果。具体地,应用贝叶斯准则得到:

P(B|A),即后验概率:在得到信息重新修正之后得到的概率。

P(B),即先验概率:由以往的数据分析得到的概率

P(A|B),即似然函数:已知某种因素的情况下事件发生的概率

朴素贝叶斯算法

贝叶斯分类算法是统计学的一种分类方法,其分类原理就是利用贝叶斯公式根据某对象的先验概率计算出其后验概率,然后选择具有最大后验概率的类作为该对象所属的类。之所以称之为”朴素”,是因为贝叶斯分类只做最原始、最简单的假设:所有的特征之间是统计独立的(假设某样本x有a1,…,aM个属性,那么有P(x)=P(a1,…,aM) = P(a1)*…*P(aM);)

当在准备数据时有两种模型:

- 词集模型:对于给定文档,只统计某个侮辱性词汇(准确说是词条)是否在本文档出现

- 词袋模型:对于给定文档,统计某个侮辱性词汇在本文当中出现的频率,除此之外,往往还需要剔除重要性极低的高频词和停用词。因此,词袋模型更精炼,也更有效。

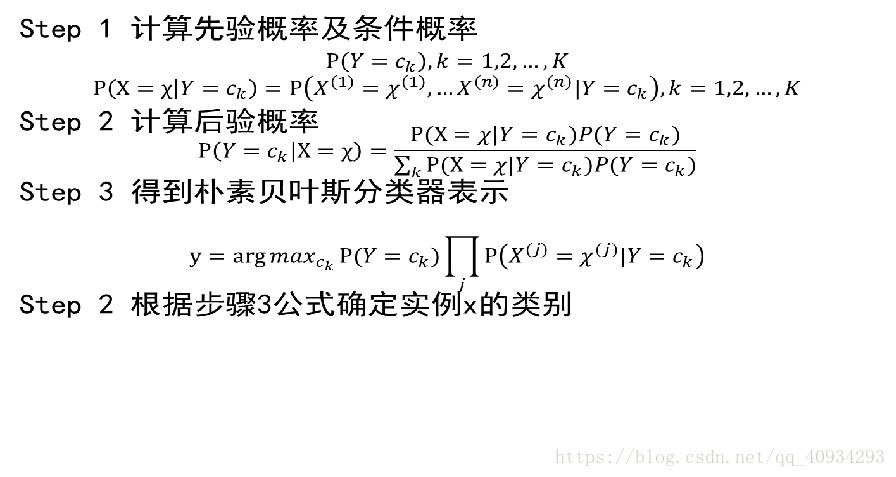

算法基本流程

上述的流程中前三步是在建立模型,最后一步是使用分类器。

其实该算法总共可以分为三个阶段:

第一个阶段:准备工作阶段,这个阶段的任务是为朴素贝叶斯分类做必要的准备,主要工作是根据具体情况确定特征属性,并对每个特征属性进行适当划分,然后由人工对一部分待分类项进行分类,形成训练样本集合。这一阶段的输入是所有待分类数据,输出是特征属性和训练样本。

第二个阶段:分类器训练阶段,这个阶段的任务就是生成分类器,主要工作是计算每个类别在训练样本中的出现频率及每个特征属性划分对每个类别的条件概率估计,并将结果记录。其输入是特征属性和训练样本,输出是分类器。

第三个阶段:应用阶段。这个阶段的任务是使用分类器对待分类项进行分类,其输入是分类器和待分类项,输出是待分类项与类别的映射关系。

朴素贝叶斯算法的优缺点

- 优点 : 条件独立假设让模型包含的条件概率的数量大为减少(参数个数C*D+C),朴素贝叶斯法的学习与预测变得简单、高效

- 缺点 :有时会牺牲一定的分类准确率;某些属性值未出现在样本中时,无法预测分类结果(样本中特征属性值出现概率为1时)

适用数据类型:标称型数据

朴素贝叶斯算法性能

该分类法与决策树和神经网络分类法的各种比较试验表明,在某些领域,贝叶斯分类法足以与它们像媲美。理论上讲,与其他所有分类算法相比,贝叶斯分类具有最小的错误率,然而,实践中并非总是如此。这是因为对其使用的假定(如类条件独立性)的不正确性,以及缺乏可用的概率数据造成的。

贝叶斯分类法还可以用来为不直接使用贝叶斯定理的其他分类算法提供理论判定。例如,在某些假定下,可以证明:与朴素贝叶斯分类法一样,许多神经网络和曲线拟合算法输出的最大的后验假定。

算法小结

- 贝叶斯概率及贝叶斯准则提供了一种利用已知值来估计未知概率的有效方法。

- 独立性假设是指一个词的出现概率并不依赖于文档中的其他词。

- 下溢出可以通过对概率取对数来解决。

- 词袋模型在解决文档分类问题上比词集模型有所提高。