# 回归问题的本质:找到一条直线或者曲线,最大程度的拟合数据点;

# 怎么定义拟合,是不同回归算法的关键差异;

# 线性回归定义拟合方式:让所有数据点到直线的 MSE 的值最小;

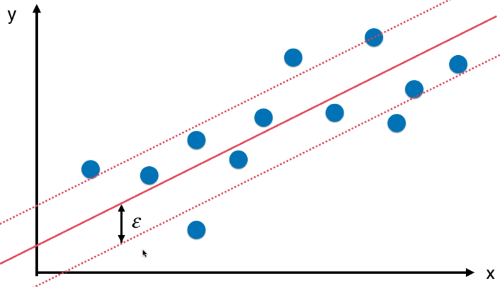

# SVM 算法定义拟合的方式:在距离 Margin 的区域内,尽量多的包含样本点;

# SVM 解决回归问题的思路与解决分类问题的思路相反,解决分类问题时,希望 Margin 区域内没有样本点或者样本点尽可能的少;

# SVM 的思路解决回归问题:

# 1)在 Margin 区域内的样本点越多,则 Margin 区域越能够较好的表达样本数据点,此时,取 Margin 区域内中间的那条直线作为最终的模型;用该模型预测相应的样本点的 y 值;

# 2)在具体训练 SVM 算法模型解决回归问题时,提前指定 Margin 的大小,算法引入的超参数:ε,表示 Margin 区域的两条直线到区域中间的直线的距离,如图:

# LinearSVC、SVC、LinearSVR、SVR :

# LinearSVC:使用线性 SVM 的思路解决分类问题;

# SVC:使用非线性 SVM 的思路解决分类问题;(多项式核、高斯核)

# LinearSVR:使用线性 SVM 的思路解决回归问题;

# SVR:使用非线性 SVM 的思路解决回归问题;(使用不同的核函数)