逻辑斯蒂回归(logistic regression),是一种对数线性模型,常用于分类。是判别模型,由条件概率分布P(Y|X)来确定。

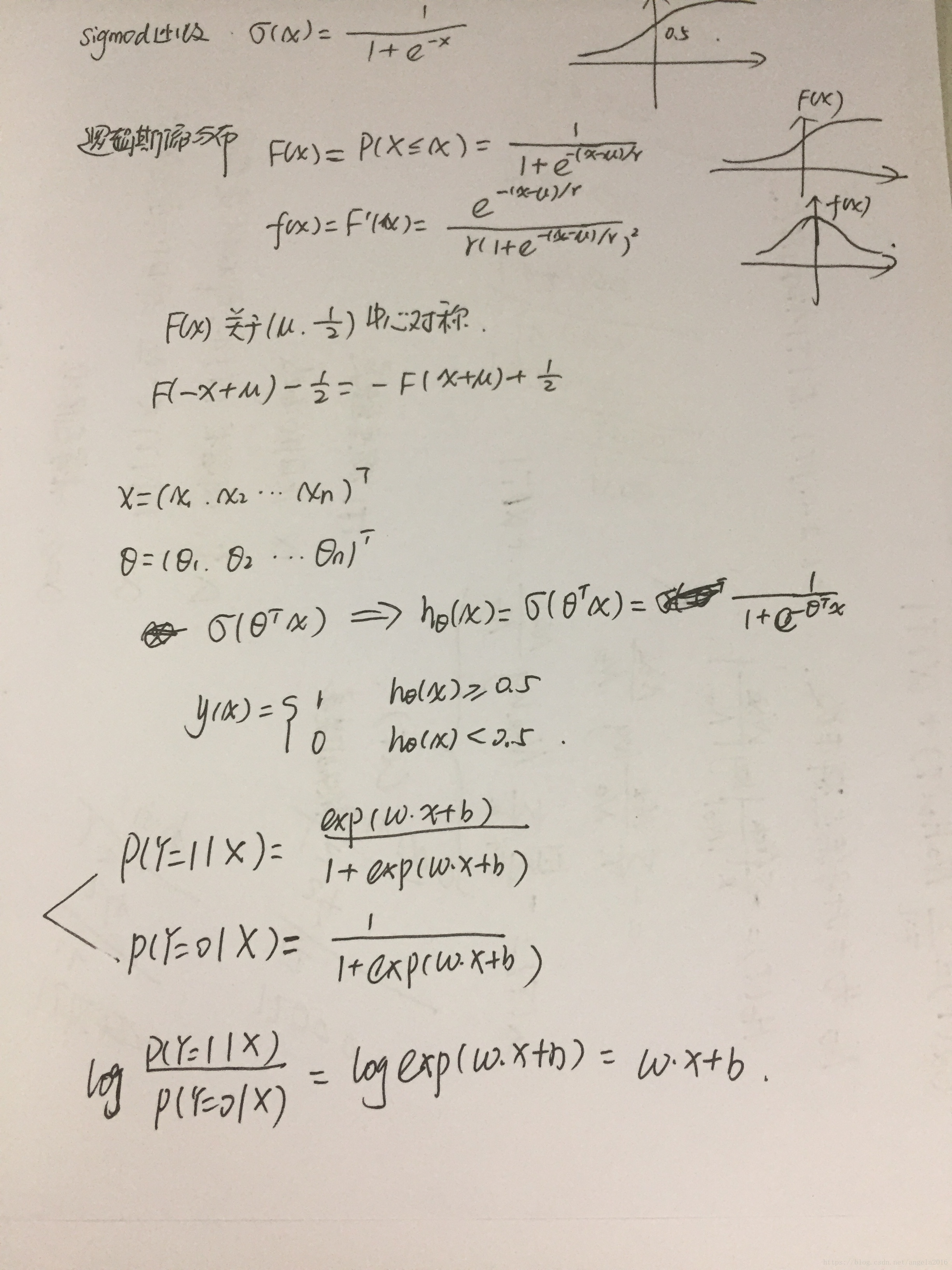

逻辑斯蒂回归的数学基础是逻辑斯蒂分布(logistic distribution),逻辑斯蒂分布与sigmod函数紧紧联系在一起。

对于二元的逻辑斯蒂回归(binomial logistic regression model),主要是依托于sigmod函数,然后将对于变量(训练数据)的线性模型输入到sigmod函数中,然后将其映射为0-1的值,对于大于等于0.5的,分类为1,对于小于0.5的,分类为0。而对数线性的来源在于判断1,0分类时,将其比值取对数的时候时线性。

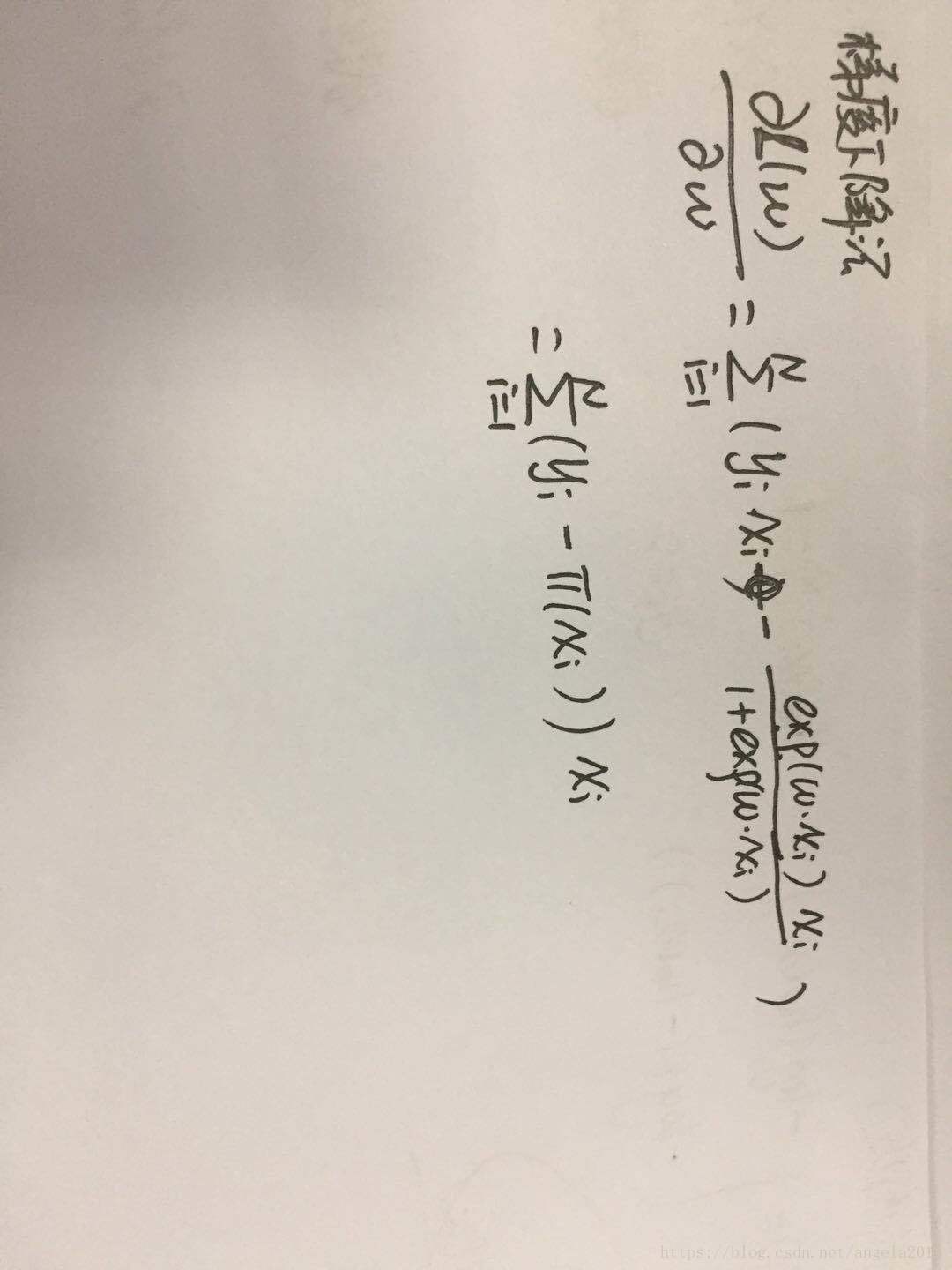

对于二元逻辑斯蒂回归中,我们需要利用训练数据来估计模型的参数,然后得到最优的模型。优化目标是极小化对数似然函数,优化手段是梯度下降法或拟牛顿法来进行求解。

多项逻辑斯蒂回归模型(multi-norminal logistic regression model),用于多类分类。从概率的角度,与二项逻辑斯蒂回归模型类似,也是在分子的方面有所不同。