GoogLeNet:Going deeper with convolutions

GoogleNet 是 2014 年 ImageNet Challenge 图像识别比赛的冠军(亚军为VGG);

Inception架构的基础;

google团队完成;

发表时间:Submitted on 17 Sep 2014;

发表期刊/会议:Computer Vision and Pattern Recognition;

论文地址:https://arxiv.org/abs/1409.4842

Inception发展演变:

- GoogLeNet/Inception V1)2014年9月 《Going deeper with convolutions》;

- BN-Inception 2015年2月 《Batch Normalization: Accelerating Deep Network Training by Reducing Internal Covariate Shift》;

- Inception V2/V3 2015年12月《Rethinking the Inception Architecture for Computer Vision》;

- Inception V4、Inception-ResNet 2016年2月 《Inception-v4, Inception-ResNet and the Impact of Residual Connections on Learning》;

- Xception 2016年10月 《Xception: Deep Learning with Depthwise Separable Convolutions》;

0 摘要

本文提出一种叫Inception的深度卷积神经网络架构,该架构在2014年ImageNet大规模视觉识别挑战赛(ILSVRC14)分类和检测任务中刷新了指标。这种体系结构的主要特点是提高了网络内计算资源的利用率。

通过精心设计的架构来增加网络的深度和宽度,同时减少参数和计算量(保持计算预算);

本文受两个理念的启发:

- Hebbian principle:赫布理论,把识别到的不同特征进行融合;

- multi-scale processing:多尺度处理,不同尺度卷积核并行处理;

在ILSVRC14比赛中,提交Inception的一个实例:GoogLeNet;

1 简介

深度学习的发展和进步离不开:更庞大的数据、更快的算力、更好的模型;

随着移动和嵌入式计算的不断发展,算法的效率,尤其是它们的功耗和内存使用,变得越来越重要;

本文提出一种叫Inceotion的架构,名字来源于《盗梦空间》。

“深度”一词(标题中)在本文中有两种含义:

- 更好的挖掘模型架构/模块->Inception;

- 网络层次更深;

2 相关工作

LeNet-5奠定CNN基础结构:卷积-归一化-最大池化-FC;

CNN在图像分类任务,MNIST、CIFAR、ImageNet的结果;

AlexNet-2012;

ZFNet-2013;

NiN(Network In Network):1×1卷积;

目标检测:R-CNN;

3 动机(哲学层面)

提高深度神经网络性能最直接的方法是增加它们的大小。这包括增加网络的深度(层数)和宽度(每层的单元数)。

更大的规模-更大的参数数量-容易过拟合(数据标注成本非常高);

更大的规模-计算效率降低、复杂度变高;

解决这个问题的根本方法是用稀疏连接取代密集连接;

但是现在的计算基础(CPU/GPU)在处理稀疏连接时都是比较低效的,对于密集的矩阵运算比较高效;

基于以上,提出问题:能否在仍旧利用现有硬件进行密集矩阵运算的前提下,改进模型结构,哪怕只是在卷积层改进从而能够利用稀疏连接带来的好处;

提出Inception模块,用一系列密集运算实现了一个稀疏模型(Inception模块内部,每一个操作都是密集运算,但是整体连接是稀疏的,只有4个分支);

4 架构细节

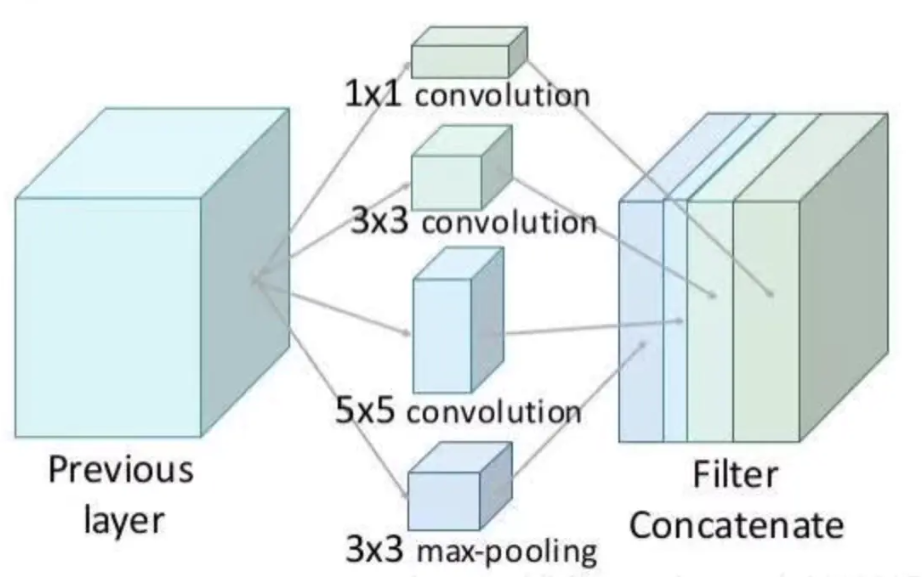

Inception模块架构示意图如图2所示,左(a)为原始版本,右(b)为更新后加入降维的版本;

原始的Inception模块(左图):

用多个不同类型的卷积核(1 × 1,3 × 3,5 × 5,3 × 3 max pooling,这就是摘要里提到的多尺度信息)组合在一起代替一个3 × 3卷积,这样做的好处在于提取出的特征具有多样化,最后把得到的特征concatenate在一起输入下一层,如图3所示,但这样会造成维度越来越高,计算量越来越大的问题;

改进:

在原始的Inception模块上加入1 × 1卷积进行降维(思想受Network In Network启发),这样可以降低计算量,并且保持架构不变;

Inception模块Pytorch实现:

#inception结构

class Inception(nn.Module):

def __init__(self, in_channels, ch1x1, ch3x3red, ch3x3, ch5x5red, ch5x5, pool_proj):

super(Inception, self).__init__()

self.branch1 = BasicConv2d(in_channels, ch1x1, kernel_size=1)

self.branch2 = nn.Sequential(

BasicConv2d(in_channels, ch3x3red, kernel_size=1),

BasicConv2d(ch3x3red, ch3x3, kernel_size=3, padding=1) # 保证输出大小等于输入大小

)

self.branch3 = nn.Sequential(

BasicConv2d(in_channels, ch5x5red, kernel_size=1),

BasicConv2d(ch5x5red, ch5x5, kernel_size=5, padding=2) # 保证输出大小等于输入大小

)

self.branch4 = nn.Sequential(

nn.MaxPool2d(kernel_size=3, stride=1, padding=1),

BasicConv2d(in_channels, pool_proj, kernel_size=1)

)

def forward(self, x):

branch1 = self.branch1(x)

branch2 = self.branch2(x)

branch3 = self.branch3(x)

branch4 = self.branch4(x)

outputs = [branch1, branch2, branch3, branch4]

return torch.cat(outputs, 1)

5 GoogLeNet

GoogLeNet的名字包含对LeNet的致敬;

GoogLeNet架构详情见表1,包含了9个Inception模块,共22层(有权重的层,包括池化层共27层);

所有卷积均使用ReLU激活函数;

输入:224 * 224 RGB图像;

GoogLeNet实现(PyTorch):

import torch.nn as nn

import torch

import torch.nn.functional as F

class GoogLeNet(nn.Module):

def __init__(self, num_classes=1000, aux_logits=True, init_weights=False):

super(GoogLeNet, self).__init__()

self.aux_logits = aux_logits

self.conv1 = BasicConv2d(3, 64, kernel_size=7, stride=2, padding=3)

self.maxpool1 = nn.MaxPool2d(3, stride=2, ceil_mode=True)

self.conv2 = BasicConv2d(64, 64, kernel_size=1)

self.conv3 = BasicConv2d(64, 192, kernel_size=3, padding=1)

self.maxpool2 = nn.MaxPool2d(3, stride=2, ceil_mode=True)

self.inception3a = Inception(192, 64, 96, 128, 16, 32, 32)

self.inception3b = Inception(256, 128, 128, 192, 32, 96, 64)

self.maxpool3 = nn.MaxPool2d(3, stride=2, ceil_mode=True)

self.inception4a = Inception(480, 192, 96, 208, 16, 48, 64)

self.inception4b = Inception(512, 160, 112, 224, 24, 64, 64)

self.inception4c = Inception(512, 128, 128, 256, 24, 64, 64)

self.inception4d = Inception(512, 112, 144, 288, 32, 64, 64)

self.inception4e = Inception(528, 256, 160, 320, 32, 128, 128)

self.maxpool4 = nn.MaxPool2d(3, stride=2, ceil_mode=True)

self.inception5a = Inception(832, 256, 160, 320, 32, 128, 128)

self.inception5b = Inception(832, 384, 192, 384, 48, 128, 128)

if self.aux_logits:

self.aux1 = InceptionAux(512, num_classes)

self.aux2 = InceptionAux(528, num_classes)

self.avgpool = nn.AdaptiveAvgPool2d((1, 1))

self.dropout = nn.Dropout(0.4)

self.fc = nn.Linear(1024, num_classes)

if init_weights:

self._initialize_weights()

def forward(self, x):

# N x 3 x 224 x 224

x = self.conv1(x)

# N x 64 x 112 x 112

x = self.maxpool1(x)

# N x 64 x 56 x 56

x = self.conv2(x)

# N x 64 x 56 x 56

x = self.conv3(x)

# N x 192 x 56 x 56

x = self.maxpool2(x)

# N x 192 x 28 x 28

x = self.inception3a(x)

# N x 256 x 28 x 28

x = self.inception3b(x)

# N x 480 x 28 x 28

x = self.maxpool3(x)

# N x 480 x 14 x 14

x = self.inception4a(x)

# N x 512 x 14 x 14

if self.training and self.aux_logits: # eval model lose this layer

aux1 = self.aux1(x)

x = self.inception4b(x)

# N x 512 x 14 x 14

x = self.inception4c(x)

# N x 512 x 14 x 14

x = self.inception4d(x)

# N x 528 x 14 x 14

if self.training and self.aux_logits: # eval model lose this layer

aux2 = self.aux2(x)

x = self.inception4e(x)

# N x 832 x 14 x 14

x = self.maxpool4(x)

# N x 832 x 7 x 7

x = self.inception5a(x)

# N x 832 x 7 x 7

x = self.inception5b(x)

# N x 1024 x 7 x 7

x = self.avgpool(x)

# N x 1024 x 1 x 1

x = torch.flatten(x, 1)

# N x 1024

x = self.dropout(x)

x = self.fc(x)

# N x 1000 (num_classes)

if self.training and self.aux_logits: # eval model lose this layer

return x, aux2, aux1

return x

def _initialize_weights(self):

for m in self.modules():

if isinstance(m, nn.Conv2d):

nn.init.kaiming_normal_(m.weight, mode='fan_out', nonlinearity='relu')

if m.bias is not None:

nn.init.constant_(m.bias, 0)

elif isinstance(m, nn.Linear):

nn.init.normal_(m.weight, 0, 0.01)

nn.init.constant_(m.bias, 0)

#辅助分类器

class InceptionAux(nn.Module):

def __init__(self, in_channels, num_classes):

super(InceptionAux, self).__init__()

self.averagePool = nn.AvgPool2d(kernel_size=5, stride=3)

self.conv = BasicConv2d(in_channels, 128, kernel_size=1) # output[batch, 128, 4, 4]

self.fc1 = nn.Linear(2048, 1024)

self.fc2 = nn.Linear(1024, num_classes)

def forward(self, x):

# aux1: N x 512 x 14 x 14, aux2: N x 528 x 14 x 14

x = self.averagePool(x)

# aux1: N x 512 x 4 x 4, aux2: N x 528 x 4 x 4

x = self.conv(x)

# N x 128 x 4 x 4

x = torch.flatten(x, 1)

x = F.dropout(x, 0.5, training=self.training)

# N x 2048

x = F.relu(self.fc1(x), inplace=True)

x = F.dropout(x, 0.5, training=self.training)

# N x 1024

x = self.fc2(x)

# N x num_classes

return x

class BasicConv2d(nn.Module):

def __init__(self, in_channels, out_channels, **kwargs):

super(BasicConv2d, self).__init__()

self.conv = nn.Conv2d(in_channels, out_channels, **kwargs)

self.relu = nn.ReLU(inplace=True)

def forward(self, x):

x = self.conv(x)

x = self.relu(x)

return x

辅助分类器:

梯度传播非常重要,一个有趣的见解是,相对较浅的网络在这项任务中的强大性能表明,网络中间层产生的特征应该是非常有区别的。

在中间层(4a和4d模块)引入辅助分类器,期望鼓励分类器中较低阶段的区分,增加传播回来的梯度信号,并提供额外的正则化。

在训练过程中,它们的损失被添加到具有折扣权重的网络的总损失中(loss = loss主 + 0.3loss辅1 + 0.3loss辅2)。在推断时,去掉辅助分类器。

6 训练细节

网络使用DistBelief分布式机器学习系统进行训练,该系统使用适度的模型和数据并行性;

GoogLeNet可以在一周内收敛;

带动量的SGD;

固定学习率计划(每8个时期将学习率降低4%);

调参;

数据增强;

7 实验 分类

8 实验 检测