Motivation

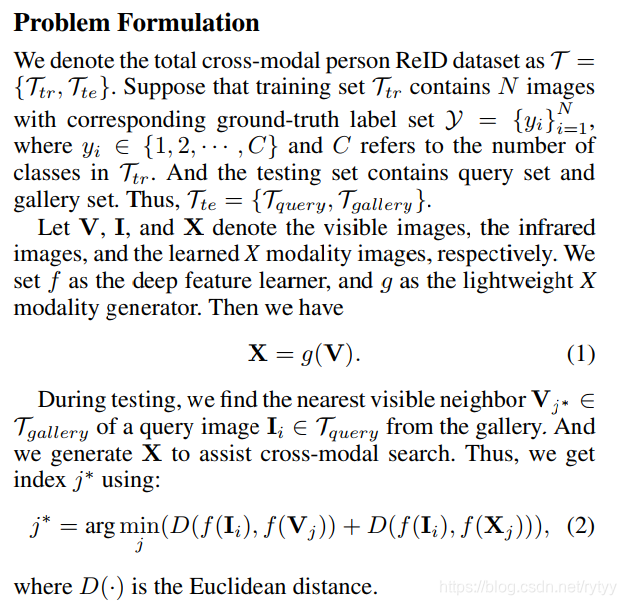

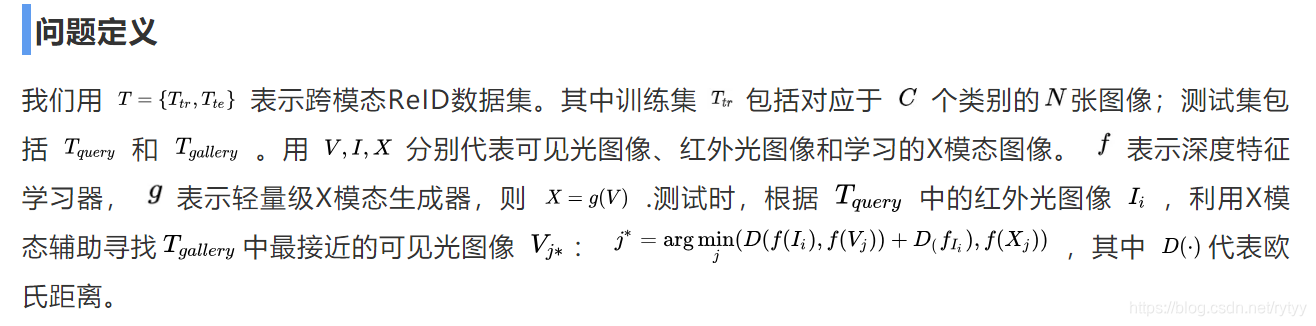

该文所关注的是红外光-可见光的跨模态行人重识别任务。也就是将红外图像作为输入,然后去检索可见光图像。由于红外图像和可见光图像之间的模态差异,IV-ReID变得充满挑战。为了减小模态差异,本文介绍了一种辅助的中间模态X,将两模态问题转化为了三模态问题。X模态是RGB模态的重新表述,可以此轻松解决跨模态学习问题。

本文所提及的跨模态ReID框架,包含两个主要部分:

- 首先, 通过自监督学习生成X模态的轻量型X模态生成器 X模态由一个基于自监督学习的轻量级网络生成,X模态图像是从V(VIsible)模态中学习所得。

- 其次,权重共享的XIV跨模态特征学习器 在XIV框架下,跨模态学习接受来自三个模态的信息,受模态差异约束所指导。

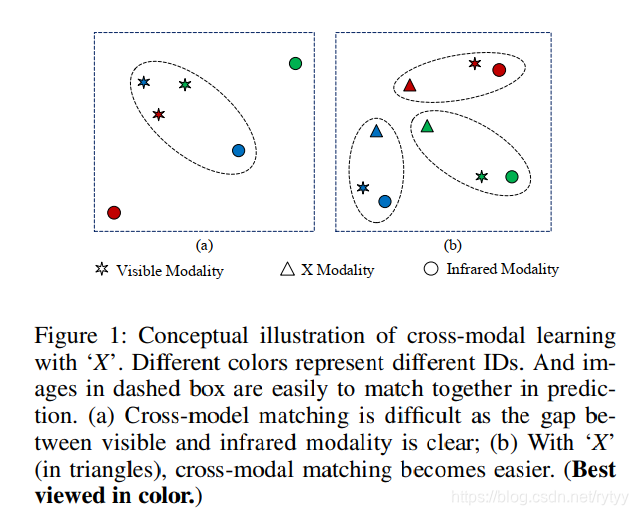

在X模态的辅助下将可见光与红外光图像连接起来,使跨模态的图像更容易匹配,得到更好的效果,见图1。

相关工作及State Of The Art

自监督学习

作为全监督学习的替代品,自监督学习在跨模态任务中得到了可观的效果。例如图像和上下文的跨模态学习(Doersch,Gupta, and Efros 2015; Gomez et al. 2017),指令和轨迹的跨模态学习(Wang et al. 2019b)等等。跨模态自监督学习算法试图利用一种模态的结构为共现模态提供训练监督(Patel et al. 2019)。考虑到单模态的自监督行人重识别问题,(Sun et al. 2019, Perceive where to focus: Learning visibilityaware part-level features for partial person re-identification. In CVPR)提出了一种部分可见感知模型,利用自监督学习的方式感知区域。特别是,他们水平随机裁剪一张行人图像,然后自动生成相应标签。

跨模态ReID

对于IV-ReID问题,大家的方法都在尝试学习模态间的关联特征。 Wu et al. (Wu et al. 2017,提出SU数据集的那个)提出了wo-stream deep zero-padding network 在一个公共空间学习跨模态特征。Ye et al. (Ye et

al. 2018a。叶芒,Hierarchical discriminative learning for visible thermal person reidentification. In AAAI.) 提出一个介绍一种结合特征学习和度量学习的两步框架。他们还(2018b. Visible thermal person re-identification via dual-constrained topranking)提出了一种跨模态的对偶约束来缩小可见特征与红外特征之间的距离。Hao(Hao, Y.; Wang, N.; Li, J.; and Gao, X. 2019. Hsme: Hypersphere manifold embedding for visible thermal person reidentification. In AAAI, )提出了一种提出了一种端到端的双流超球面流形嵌入模型来约束模内和模间的变化。(Feng, Lai, And Xie 2019)提出的框架利用与模态相关的信息,通过为每个模态构建单独的网络来提取特定于模态的表征。

和本文最相关的是三种基于GAN的方法:cmGAN (Dai et al. 2018), D2RL (Wang et al. 2019c) and AlignGAN (Wang et al. 2019a). cmGAN用生成对抗网络从不同模态中学习判别性特征。D2RL采用了GANs,分别减少了模态差异和外观差异。同样的 ,AlignGAN在一个统一的GAN框架内实现了像素和特征的对齐。然而,与本文之间的差异是显而易见的。

- 首先,与使用权值共享网络直接处理原两种模式的cmGAN相比,本文采用了一种辅助的X模态,利用设计的模态差距约束来缩小原两种模式之间的模态差距,并仅使用轻量级网络和少量开销来缓解学习困难。

- 其次,在D2RL中,GANs被用来翻译可见光(或红外线)图像到它的红外线(或可见光)对应物。然后将可见光(或红外)图像与可见光(或红外)图像进行叠加,形成四通道多光谱图像,并将其作为输入输入到backbone中。相比之下,我们生成一个单独的X模态,并使用三个三通道模态进行有效的跨模态学习。我们新的XIV跨模态学习策略应该是更可取的,因为它避免了D2RL中不确定的红外图到可见光的生成,而且不需过分改造即可直接使用现在的流行的backbone。

- 再者,第三,在AlignGAN中,GANs 将可见光图像映射为伪红外图像,要求生成的伪红外图像能够映射回原来的可见光图像。首先,因为与可见光图像相比,红外图像包含较少的信息,特别是通过GAN中的空间变换,(假的)红外生成的可见光图像的错误转化依然存在。与直接将RGB转化为IR不同,本文打算学习一种介于可见光和红外图像之间的中间介质。

- 通常,GAN方式都会比较难以训练,而本文所提出的方法会容易一些。

Contribution

- 基于引入一个中间辅助的X模态,提出了一种新的跨模态ReID方法

- 提出了一个基于自监督学习的X模态图像生成器

- 设计了一种模态差异约束来指导跨模态信息的交流

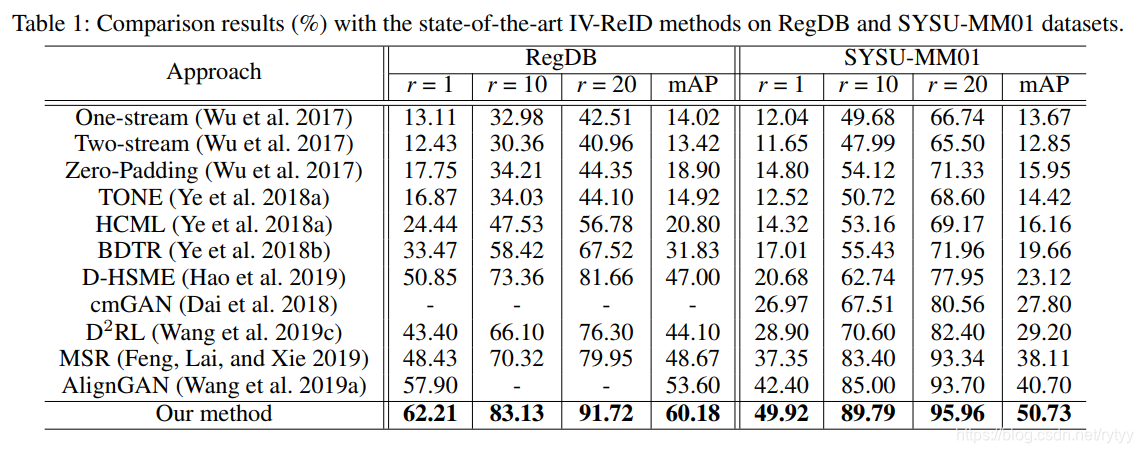

- 在SYSU-MM01数据集上达到了超SOTA 7%的效果

Method and Detials

具体实现:

X模态图像生成器

由于可见光图像基于深度模型,行人的外观和服装这些通常被应用于高水平的语义信息。与之相反,红外图像只包含不可见光的单通道,主要的语义信息只有图像的结构和形状。相对地,我们学习了一个伴随的、辅助的、以自监督为辅助的模态来调和红外线模态和可见光模态。

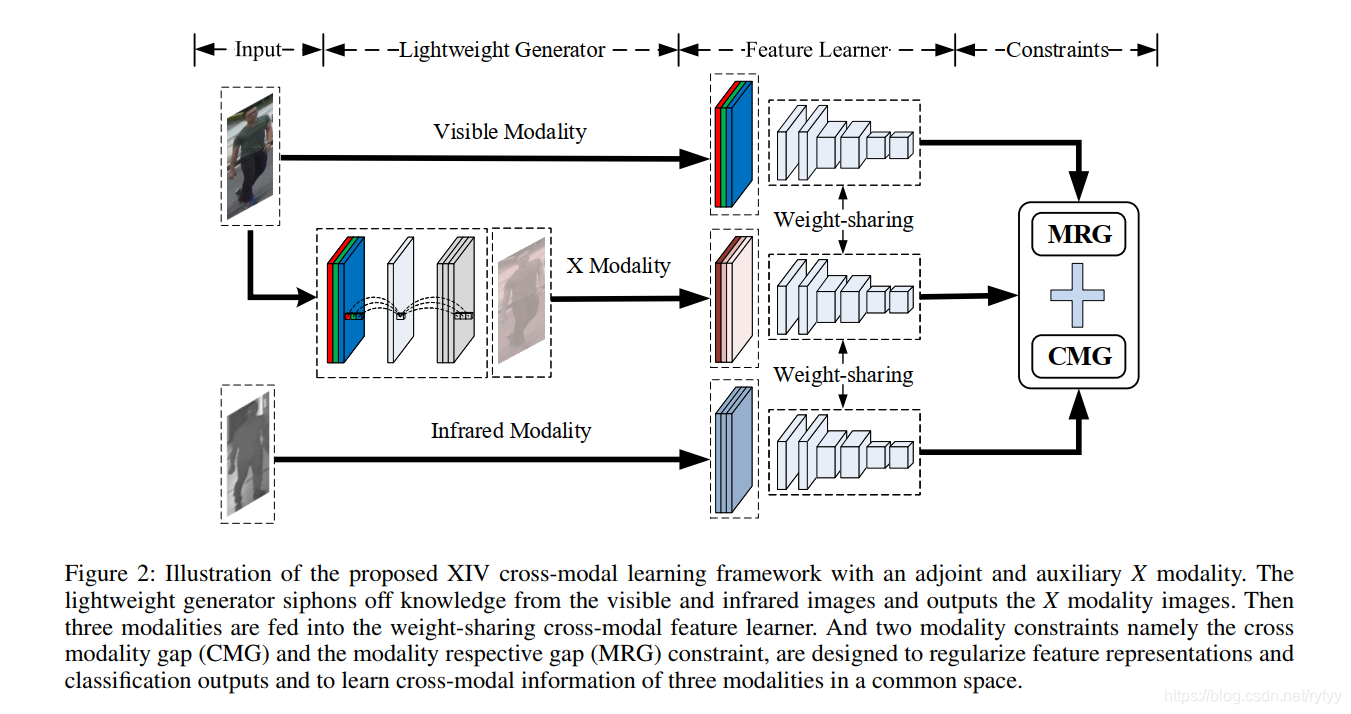

如图二所示,该轻量级X模态生成器将可见光图像作为输入,吸收可见光和红外模态的信息。这个非线性轻量级网络包含两个1*1卷积层和一个ReLU激活层 ,三通道的图像首先通过第一个11卷积层,转化为一个单通道图像(如同IR图像),然后经过ReLU做非线性处理,再经过另一个11卷积,还原成三通道图像(即X模态图像)。

从可见图像中自动生成标签的X图像提供了额外的自监督信息。和别的辅助性结构相比(例如基于GAN的),本文实现了一个更加轻量级且高效的网络。这个网络比GAN更易优化。此外,IR和RGB主要的模态差异依然保留在通道空间中。这些基于gan的方法不仅在信道维度上重构信息,而且在空间维度上重构信息,破坏原有的空间结构信息。相比之下,我们使用更合理的1×1卷积层来学习X模态,这只是一个从可见模态重建信道信息的过程。

权重共享特征学习器

除了X模态生成器,本文提出了一个XIV跨模态特征学习器,该特征学习器的基础是一个高效baseline(罗浩的strong beaseline)如图二所示,该特征学习器以三个模态的图像作为输入,通过一个共同的特征空间来学习跨模态信息。由于共享权值,该框架显得更加紧凑。在训练过程中,该框架将共同训练这三个模态。X模态作为辅助来缓解学习困难。在测试阶段,我们将红外- X和红外-可见光的相似度作为公式2进行计算,得到了最佳的性能。

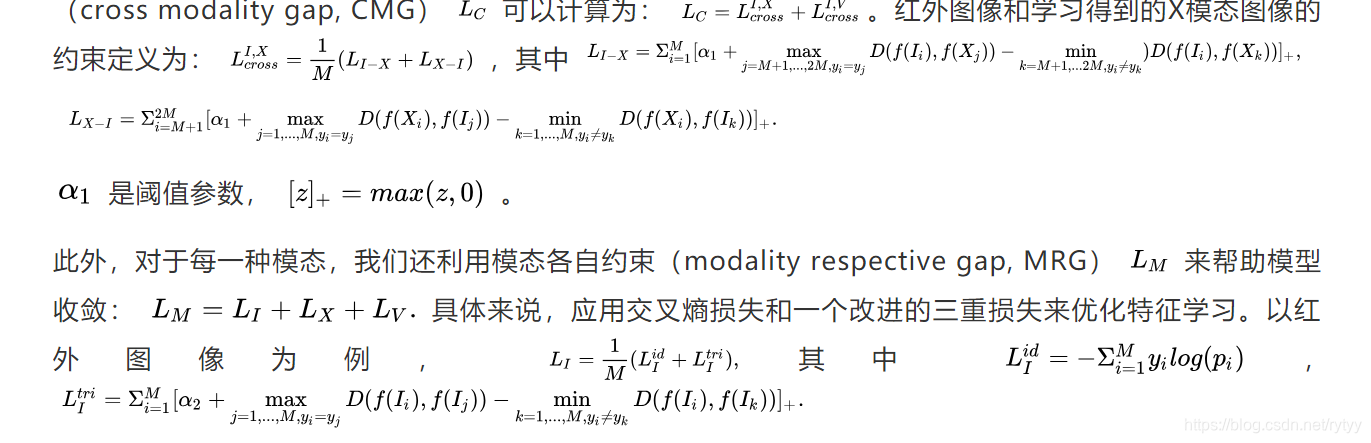

模态约束(CMG和MRG)

以往的方法主要考虑利用正红外-可见对和负红外-可见对增强特征的可分辨性。相比较而言,我们以一种联合的方式用红外线、可见光和X方式形成模态差异约束。

我们形成了大小为3M的排列良好的batch,其中第一个M表示红外模态,第二个M表示X模态,第三个M表示可见模态。这样,我们即可计算一个跨模态约束:

优化

实验设计

数据集 SYSU-MM01和RegDB

实现细节:

和SOTA的对比