文章内容总结自,只作为后续理解的记录,侵删:

【1】作者:阮行止

链接:https://www.zhihu.com/question/23995189/answer/613096905

来源:知乎

【2】作者:王勐

链接:https://www.zhihu.com/question/23995189/answer/35429905

来源:知乎

一. 从一个生活问题谈起

先来看看生活中经常遇到的事吧——假设您是个土豪,身上带了足够的1、5、10、20、50、100元面值的钞票。现在您的目标是凑出某个金额w,需要用到尽量少的钞票。

依据生活经验,我们显然可以采取这样的策略:能用100的就尽量用100的,否则尽量用50的……依次类推。在这种策略下,666=6×100+1×50+1×10+1×5+1×1,共使用了10张钞票。

这种策略称为“贪心”:假设我们面对的局面是“需要凑出w”,贪心策略会尽快让w变得更小。能让w少100就尽量让它少100,这样我们接下来面对的局面就是凑出w-100。长期的生活经验表明,贪心策略是正确的。

但是,如果我们换一组钞票的面值,贪心策略就也许不成立了。如果一个奇葩国家的钞票面额分别是1、5、11,那么我们在凑出15的时候,

贪心策略会出错:

15=1×11+4×1 (贪心策略使用了5张钞票)

15=3×5 (正确的策略,只用3张钞票)

为什么会这样呢?贪心策略错在了哪里?

鼠目寸光。

刚刚已经说过,贪心策略的纲领是:“尽量使接下来面对的w更小”。这样,贪心策略在w=15的局面时,会优先使用11来把w降到4;但是在这个问题中,凑出4的代价是很高的,必须使用4×1。如果使用了5,w会降为10,虽然没有4那么小,但是凑出10只需要两张5元。

在这里我们发现,贪心是一种只考虑眼前情况的策略。

那么,现在我们怎样才能避免鼠目寸光呢?

如果直接暴力枚举凑出w的方案,明显复杂度过高。太多种方法可以凑出w了,枚举它们的时间是不可承受的。我们现在来尝试找一下性质。

重新分析刚刚的例子。w=15时,我们如果取11,接下来就面对w=4的情况;如果取5,则接下来面对w=10的情况。我们发现这些问题都有相同的形式:“给定w,凑出w所用的最少钞票是多少张?”接下来,我们用f(n)来表示“凑出n所需的最少钞票数量”。

那么,如果我们取了11,最后的代价(用掉的钞票总数)是多少呢?

它的意义是:利用11来凑出15,付出的代价等于f(4)加上自己这一张钞票。现在我们暂时不管f(4)怎么求出来。

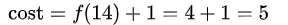

依次类推,马上可以知道:如果我们用5来凑出15,cost就是 :

。

。

那么,现在w=15的时候,我们该取那种钞票呢?当然是各种方案中,cost值最低的那一个!

取11:

取5:

取1:

显而易见,cost值最低的是取5的方案。我们通过上面三个式子,做出了正确的决策!

这给了我们一个至关重要的启示——

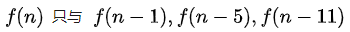

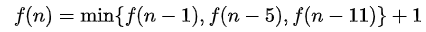

相关;更确切地说:

这个式子是非常激动人心的。我们要求出f(n),只需要求出几个更小的f值;

我们以 O(n)的复杂度解决了这个问题。

现在回过头来,我们看看它的原理:

1. f(n)只与的f(n-1),f(n-5),f(n-11)的值相关。

2. 我们只关心 f(w)的值,不关心是怎么凑出w的。

这两个事实,保证了我们做法的正确性。它比起贪心策略,会分别算出取1、5、11的代价,从而做出一个正确决策,这样就避免掉了“鼠目寸光”!

它与暴力的区别在哪里?我们的暴力枚举了“使用的硬币”,然而这属于冗余信息。我们要的是答案,根本不关心这个答案是怎么凑出来的。譬如,要求出f(15),只需要知道f(14),f(10),f(4)的值。其他信息并不需要。我们舍弃了冗余信息。我们只记录了对解决问题有帮助的信息——f(n).

我们能这样干,取决于问题的性质:求出f(n),只需要知道几个更小的f( c )。我们将求解f( c )称作求解f(n)的“子问题”。

这就是DP(动态规划,dynamic programming).

将一个问题拆成几个子问题,分别求解这些子问题,即可推断出大问题的解。

二. 几个简单的概念

1.【无后效性】

一旦f(n)确定,“我们如何凑出f(n)”就再也用不着了。

要求出f(15),只需要知道f(14),f(10),f(4)的值,而f(14),f(10),f(4)是如何算出来的,对之后的问题没有影响。

“未来与过去无关”,这就是无后效性。

(严格定义:如果给定某一阶段的状态,则在这一阶段以后过程的发展不受这阶段以前各段状态的影响。)

2.【最优子结构】

回顾我们对f(n)的定义:我们记“凑出n所需的最少钞票数量”为f(n).

f(n)的定义就已经蕴含了“最优”。利用w=14,10,4的最优解,我们即可算出w=15的最优解。

大问题的最优解可以由小问题的最优解推出,这个性质叫做“最优子结构性质”。

引入这两个概念之后,我们如何判断一个问题能否使用DP解决呢?

能将大问题拆成几个小问题,且满足无后效性、最优子结构性质。

3.【子问题的重叠性】

动态规划将原来具有指数级时间复杂度的搜索算法改进成了具有多项式时间复杂度的算法。其中的关键在于解决冗余,这是动态规划算法的根本目的。动态规划实质上是一种以空间换时间的技术,它在实现的过程中,不得不存储产生过程中的各种状态,所以它的空间复杂度要大于其它的算法。

三、对DP原理的一点讨论

【DP的核心思想】DP为什么会快?

无论是DP还是暴力,我们的算法都是在可能解空间内,寻找最优解。

来看钞票问题。暴力做法是枚举所有的可能解,这是最大的可能解空间。

DP是枚举有希望成为答案的解。这个空间比暴力的小得多。

也就是说:DP自带剪枝。

DP舍弃了一大堆不可能成为最优解的答案。

譬如: 15 = 5+5+5 被考虑了。

15 = 5+5+1+1+1+1+1 从来没有考虑过,因为这不可能成为最优解。

从而我们可以得到DP的核心思想:尽量缩小可能解空间。

在暴力算法中,可能解空间往往是指数级的大小;如果我们采用DP,那么有可能把解空间的大小降到多项式级。

一般来说,解空间越小,寻找解就越快。这样就完成了优化。

【DP的操作过程】一言以蔽之:大事化小,小事化了。

将一个大问题转化成几个小问题;

求解小问题;

推出大问题的解。

【如何设计DP算法】

动规解题的一般思路

将原问题分解为子问题

(注意:1,子问题与原问题形式相同或类似,只是问题规模变小了,从而变简单了; 2,子问题一旦求出就要保存下来,保证每个子问题只求解一遍)

确定状态,整个问题的时间复杂度就是状态数目乘以每个状态所需要的时间

确定状态转移方程 (由已知推未知)

适合使用动规求解的问题:

1,问题具有最优子结构

2,无后效性

四、递推、贪心、搜索、还是动态规划?

一个问题是该用递推、贪心、搜索还是动态规划,完全是由这个问题本身阶段间状态的转移方式决定的!

每个阶段只有一个状态->递推;

每个阶段的最优状态都是由上一个阶段的最优状态得到的->贪心;

每个阶段的最优状态是由之前所有阶段的状态的组合得到的->搜索;

每个阶段的最优状态可以从之前某个阶段的某个或某些状态直接得到而不管之前这个状态是如何得到的->动态规划。