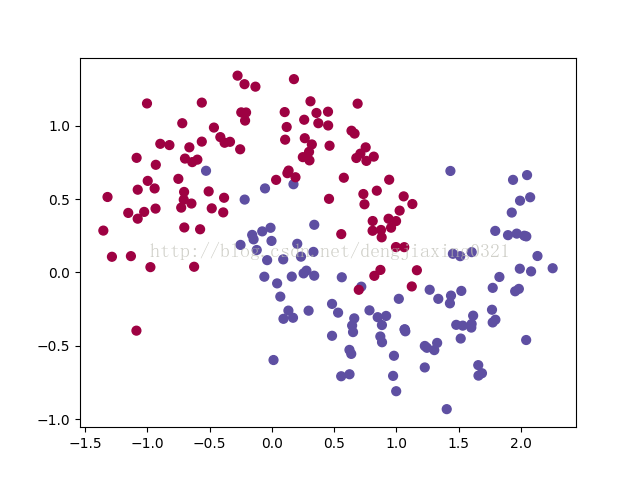

1 import numpy as np 2 from sklearn.datasets import make_moons 3 import matplotlib.pyplot as plt 4 # 手动生成一个随机的平面点分布,并画出来 5 np.random.seed(0) 6 X, y = make_moons(200, noise=0.20) 7 plt.scatter(X[:,0], X[:,1], s=40, c=y, cmap=plt.cm.Spectral) 8 plt.show()

定义一个边界决策函数

1 # 咱们先顶一个一个函数来画决策边界 2 def plot_decision_boundary(pred_func): 3 4 # 设定最大最小值,附加一点点边缘填充 5 x_min, x_max = X[:, 0].min() - .5, X[:, 0].max() + .5 6 y_min, y_max = X[:, 1].min() - .5, X[:, 1].max() + .5 7 h = 0.01 8 9 xx, yy = np.meshgrid(np.arange(x_min, x_max, h), np.arange(y_min, y_max, h)) 10 11 # 用预测函数预测一下 12 Z = pred_func(np.c_[xx.ravel(), yy.ravel()]) 13 Z = Z.reshape(xx.shape) 14 15 # 然后画出图 16 plt.contourf(xx, yy, Z, cmap=plt.cm.Spectral) 17 plt.scatter(X[:, 0], X[:, 1], c=y, cmap=plt.cm.Spectral)

然后使用它

1 from sklearn.linear_model import LogisticRegressionCV 2 #咱们先来瞄一眼逻辑斯特回归对于它的分类效果 3 clf = LogisticRegressionCV() 4 clf.fit(X, y) 5 6 # 画一下决策边界 7 plot_decision_boundary(lambda x: clf.predict(x)) 8 plt.title("Logistic Regression") 9 plt.show()

clf.fit(X, y):用训练数据来拟合模型

clf.predict(x) 用训练好的分类器去预测x数据的标签[1](返回的值是一个概率)