一、生物神经元简介

1.1生物神经元的结构

其中,树突类似于神经元的“输入端”,轴突相当于神经元的“输出端”,突触相当于神经元之间的输入

输出的接口

1.2人工神经元模型

图1-2 人工神经元结构模型

具体参数介绍请见参考资料

总体思路:

1:由xi与wij得到输入信号的线性组合ui

2:用阈值修正ui,得到经偏差调整后的vi,vi也称为神经元的局部感应区

3:用激励函数f(x)作用于vi,得到神经元i的输出yi

二、激励函数f(x)的表达式

2.1Sigmoid函数

常见的Sigmoid函数有两种——单极性Sigmoid函数和双极性Sigmoid函数。

单极性Sigmoid函数

或

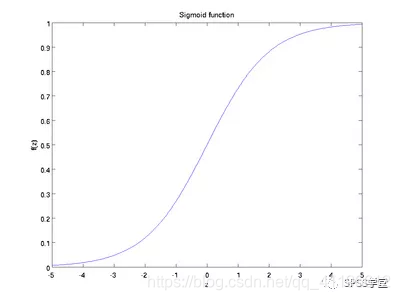

其图像如下:

图2-1 单极性Sigmoid函数

双极性Sigmoid函数

或

把第一个式子分子分母同时除以ez,令x=-2z就得到第二个式子了,换汤不换药。

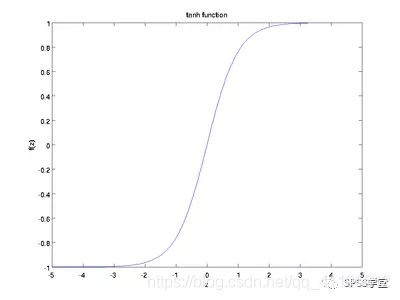

其图像如下:

图2-2 双极性Sigmoid函数

从它们两个的值域来看,两者名称里的极性应该指的是正负号,单极性取值为正,双极性正负皆取,且关于原点对称。

从导数来看,它们的导数都非常便于计算,当斜率参数a接近无穷大时,此函数转化为简单的阈值函数,但阈值函数仅取值0或1,而Sigmoid函数的值域是0到1的连续区间,还要注意到Sigmoid函数是可微分的,而阈值函数不是。

2.2阈值函数

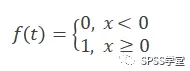

阶跃函数

如图2-3(a),如果激励函数采用阶跃函数,则图1-2所示神经元模型即MP模型,此时神经元的输出取1或0,反应神经元的兴奋或抑制

符号函数

通常符号函数也作为神经元的激励函数,如图2-3(b)所示

图2-3 阶跃函数与符号函数图

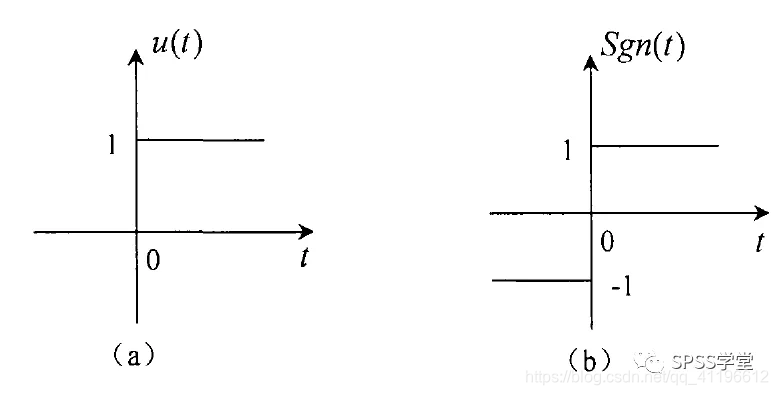

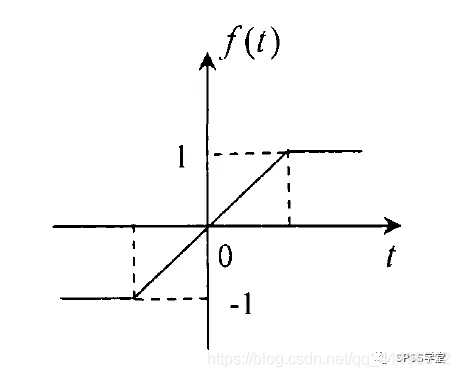

2.3分段线性函数

该函数在[-1,1]线性区内的放入系数是一致的,如图6所示,这种形式的激励函数可看作是线性放入器的近似。

三、神经网络模型

参考资料:

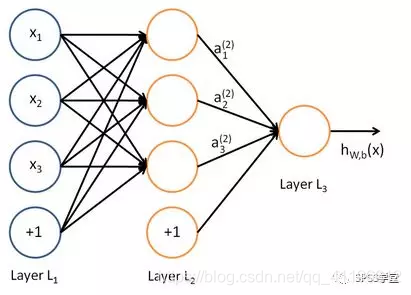

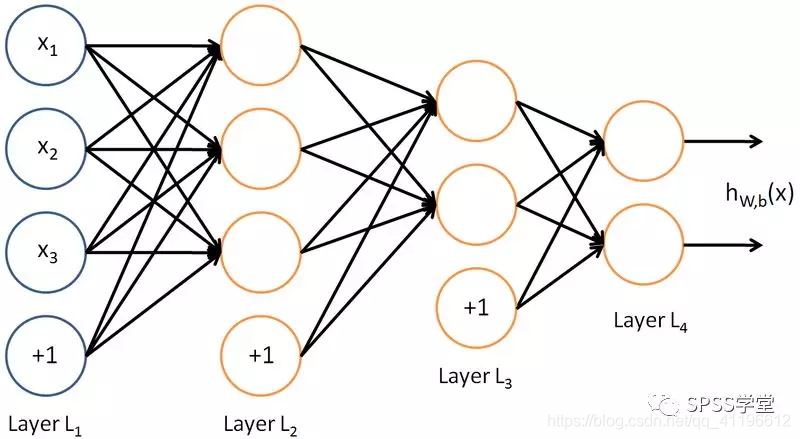

总的来说,神经网络就是多个神经元的级联,上一级神经元的输出是下一级神经元的输入,而且信号在两级的两个神经元之间传播的时候需要乘上这两个神经元对应的权值。

图3-1 神经网络模型

标注+1的那个节点是偏置节点,偏置节点不接受输入,输出总是+1,其他参数详见本节参考资料

3.1前向传播

核心思想是这一层的输出乘上相应的权值加上偏置量代入激励函数f(x)等于下一层的输入,一句大白话,所谓中文伪码。

具体请见参考资料,在此不再撰述

3.2反向传播

3.2.1BP神经网络

BP神经网络模型是目前应用最为广泛和成功的神经网络之一。BP算法的基本思想是,学习过程由信号的正向传播与误差的反向传播两个过程组成。正向传播时,输入样本从输入层传入,经各隐含层处理后,传向传输层,若输出层的实际输出与期望的输出不一致,则转入误差的反向传播阶段。误差反向传播是将输出误差以某种形式通过隐含层向输入层逐层反向传拐,并将误差分摊给各层的所有单元,从而获得各层单元的误差信号,此误差信号即作为修正各单元的依据。这种信号止向传播与误差反向传播的各层权值调整过程,是周而复始地进行的。权值不断调整的过程,也就是网络的学习训练过程。此过程一直进行到网络输出的误差减少到可接受的程度或进行到预先设定的学习次数为止。

反向传播指的是在训练的时候,根据最终输出的误差来调整倒数第二层、倒数第三层……第一层的参数的过程。

3.2.2误差反向传播学习算法

1)输入模式是由输入层经过隐含层向输出层逐层传播的“模式顺传播”过程

2)网络的期望输出与实际输出之差及误差信号,是由输出层经隐含层向输入层逐层修正连接权值的“误差逆向传播”过程。

3)由“模式顺传播”和“误差逆向传播”过程反复交替进行的网络“记忆训练”过程。

4)网络趋向收敛,即网络全局误差趋向极小值的“学习收敛”过程。

图3-1 BP神经网络结构示意图

符号定义:

:第l层第j个节点的输入。

:第l层第j个节点的输入。

:从第l-1层第i个节点到第l层第j个节点的权值。

:从第l-1层第i个节点到第l层第j个节点的权值。

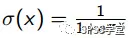

:Sigmoid函数(单极性)。

:Sigmoid函数(单极性)。

:第l层第j个节点的偏置。

:第l层第j个节点的偏置。

:第l层第j个节点的输出。

:第l层第j个节点的输出。

:输出层第j个节点的目标值(Target value)。

:输出层第j个节点的目标值(Target value)。

四、