(四)逻辑回归模型在申请评分卡中的应用

本遍博客主要讲解以下内容:

- 逻辑回归描述

- 变量选择的方法(知识扩展)

- 带权重的逻辑回归模型

逻辑回归描述

伯努利分布说的是每一个客户逾期概率相同的情况,但是现实生活中,往往不同的客户逾期的概率往往不同,与一些特征有关。

假设我们收集到很多特征,可以用线性函数来拟合逾期概率吗?我们看到其缺点,首先概率无解,其次,把现在的P代入对数似然函数很难求解

所以我们在线性基础上变化,用一个函数(逻辑回归函数)将其转换,使其满足要求(p位于[0,1]区间,对数似然函数好求解)

上面我们说不同客户应该有不同概率,而这些概率往往与我们特征数据集有关,所以将概率表达式代回对数似然函数

对逻辑回归的参数进行估计

变量选择的方法(知识扩展)

评分卡中我们常用的变量挑选方法使用IV进行挑选,除了IV方法还有下面三种常见的方法

- LASSO(模型系数的约束)

写有一篇关于LASSO的机器学习算法文章,大家可以去查看,大概的思路就是,引入一个惩罚函数,以至于不让我们模型的系数太大,也就是这些系数,画一个区域,满足这个区域的才取,下面有一个几何图,之后当交点在某一个坐标轴时,有一个坐标轴系数为0,也就是该特征可以舍去了

下面是LASSO的简单介绍

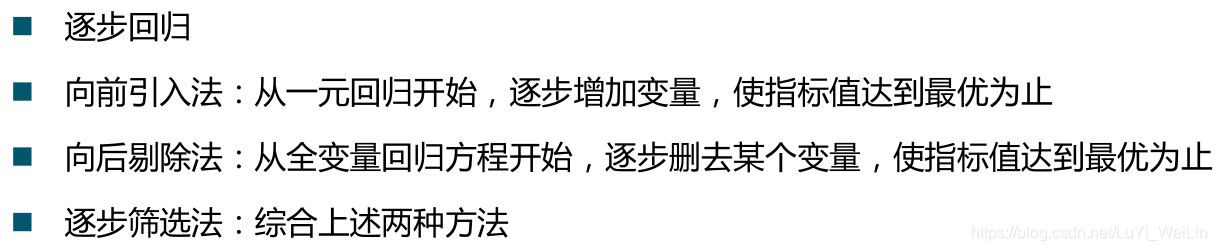

- 逐步回归法

https://blog.csdn.net/LuYi_WeiLin/article/details/85699800我之前博客有提及

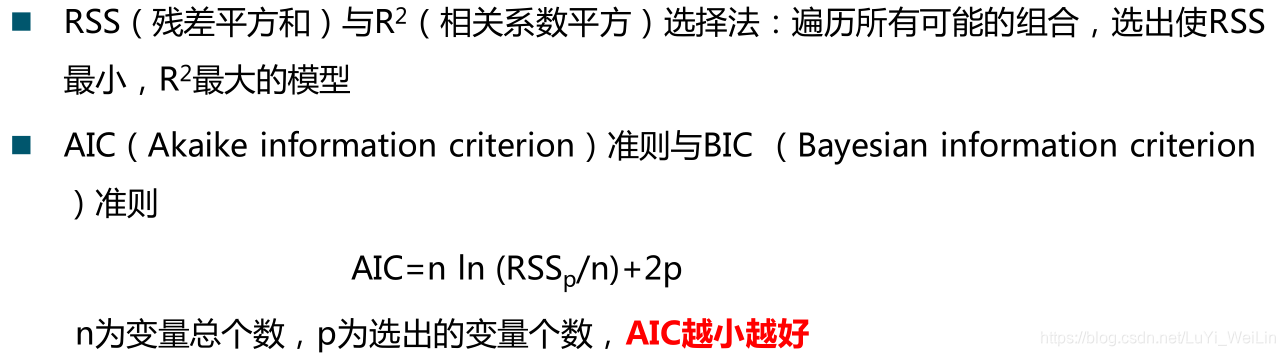

指标指的是

- 随机森林法(变量的重要性)

随机森林采用多个决策树的投票机制来改善决策树,我们假设随机森林使用了m棵决策树,那么就需要产生m个一定数量的样本集来训练每一棵树,如果用全样本去训练m棵决策树显然是不可取的,全样本训练忽视了局部样本的规律,对于模型的泛化能力是有害的

产生n个样本的方法采用Bootstraping法,这是一种有放回的抽样方法,产生n个样本

而最终结果采用Bagging的策略来获得,即多数投票机制

https://blog.csdn.net/Chenyukuai6625/article/details/73692347(什么是bagging和boosting算法,可以参考博客)

带权重的逻辑回归模型