一.爬虫基础

1.1 requests类

1.1.1 request的7个方法

requests.request() 实例化一个对象,拥有以下方法

requests.get(url, *args)

requests.head() 头信息

requests.post()

requests.put()

requests.patch() 修改一部分内容

requests.delete()

url = "http://quanben5.com/n/doupocangqiong/6.html" headers = { "User-Agent":"Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/69.0.3497.81 Safari/537.36"

} r = requests.get(url, headers=headers) data = { "pinyin": "doupocangqiong", "content_id": "4", } r = requests.post(url, data=data, headers=headers)

1.1.2*arg里面的参数

params 字典或者字节序列,作为参数增加到url中

data 字典字节序列文件对象, 放在url里面对应的地方

json 作为requests的内容

headers 字典 模拟服务头

cookies 字典 cookieJar

auth 元组

files 字典类型,传输文件

timeout 设定的超时时间

proxies 字典类型,设定访问代理服务器,可以增加登录认证 pxs={"http":"http://user:[email protected]"}

allow_redirects 默认True 是否允许重定向

stream 默认TRUE 获得数据立刻下载

verity 默认True 认证SSL证书开关

cert 本地SSL证书路径

1.2 BeautifulSoup类

soup = BeautifulSoup("","html.parser")

soup.prettify()

soup.find_all(name, attrs, recursive, string, **kwargs)

name: 标签名称

attrs: 属性

string: 检索字符串

soup.head

soup.head.contents 列表

soup.body.contents[1]

soup.body.children

soup.body.descendants

.parent

.parents

.next_sibling 下一个

.previous_sibling 上一个

.next_siblings 下一个所有 迭代

.previous_siblings 上一个所有

二.实战

首先要找到可以在线看小说的网页

这里我随便百度了一下,首先选择了一个全本5200小说网("https://www.qb5200.tw")

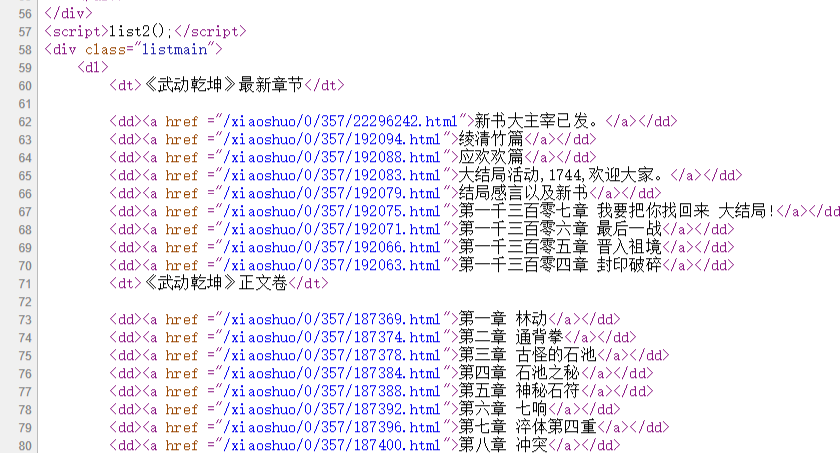

打开某小说章节目录表

https://www.qb5200.tw/xiaoshuo/0/357/

查看源代码

发现正文卷是在class为listmain的div下面的第二个dt标签里

之后的路径标签为a

1 url_text = soup.find_all('div', 'listmain')[0] # 找到第一个class=listmain的div标签 2 main_text = url_text.find_all('dt')[1] # 找到下面的第二个dt标签 3 for tag in main_text.next_siblings: 4 try: 5 url = ''.join(['https://', host, tag.a.attrs['href']]) 6 print('parsering', url) 7 except: 8 continue

在随便打开一章

查看源代码为:

1 def getHTMLText(url, headers={}): 2 """ 3 获取网站源码 4 :param url: 5 :return: class response 6 """ 7 if headers != {}: 8 headers = {"User-Agent":"Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/69.0.3497.81 Safari/537.36"} 9 10 # proxies = get_random_ip() 11 proxies = {} 12 try: 13 # print("start", url) 14 r = requests.get(url, proxies=proxies, headers=headers) 15 r.raise_for_status() 16 # r.encoding = r.apparent_encoding 17 # print('end', url) 18 return r 19 except: 20 return r.status_code 21 22 def parseByQB5200(soup, host, f): 23 """ 24 在全本小说网的源码下爬取小说 25 :param soup, host: 26 :param f: 27 :return: 28 """ 29 url_text = soup.find_all('div', 'listmain')[0] 30 main_text = url_text.find_all('dt')[1] 31 x = 0 32 for tag in main_text.next_siblings: 33 time.sleep(1) 34 try: 35 url = ''.join(['https://', host, tag.a.attrs['href']]) 36 print('parsering', url) 37 soup = BeautifulSoup(getHTMLText(url).text, "html.parser") 38 passage = soup.find_all("div", "content")[0] 39 title = passage.h1.string 40 f.writelines(''.join([title, '\n'])) 41 passage = soup.find_all("div", "showtxt")[0] 42 for i in passage.descendants: 43 if i.name != "br": 44 st = i.string 45 if st.strip().startswith('http') or st.strip().startswith('请记住本书'): 46 continue 47 f.writelines(''.join([' ', st.strip(), '\n'])) 48 x += 1 49 print('%d.%s 下载完成' % (x, title)) 50 except: 51 continue 52 53 def getNovelUrls(url): 54 """ 55 通过小说的目录网址判断小说所在的网站 56 并调用属于该网站的爬虫语句 57 :param url: 58 :return: 59 """ 60 61 response = getHTMLText(url) 62 host = url.split('//')[1].split('/')[0] 63 host_list = { 64 "www.qb5200.tw": parseByQB5200, 65 # "www.qu.la": parseByQuLa, 66 "quanben5.com": parseByQB5 67 } 68 print(response) 69 soup = BeautifulSoup(response.text, 'html.parser') 70 with open('1.txt', 'w', encoding='utf8') as f: 71 host_list[host](soup, host, f) 72 73 if __name__ == '__main__': 74 getNovelUrls("https://www.qb5200.tw/xiaoshuo/0/357/")

问题在于

全本小说网("www.qb5200.tw")只允许爬3次,之后就403错误

解决方法暂时未知

因此换了一个网站

全本5小说网("quanben5.com")

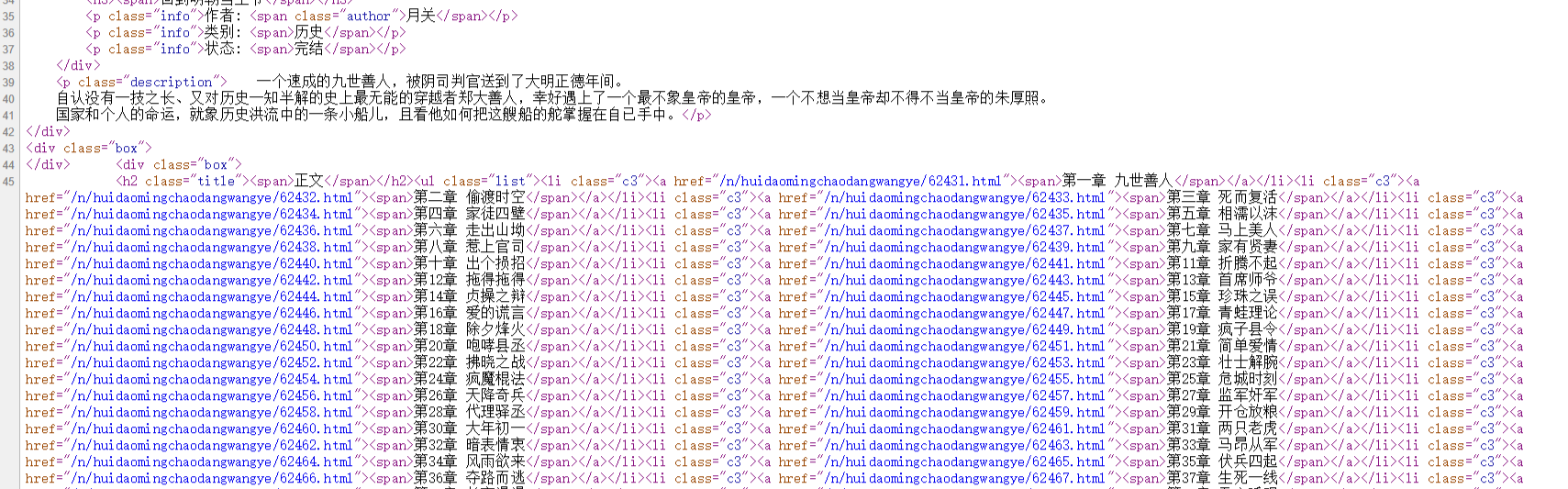

同样的方法搜索源代码

然而发现了问题

给出的html页面只有一半的源码

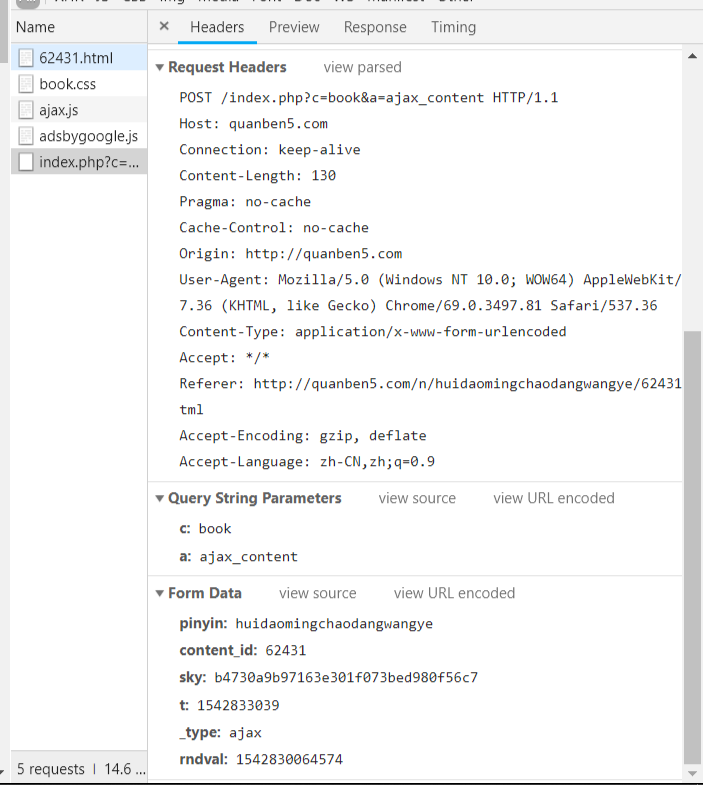

因此按F12打开检查

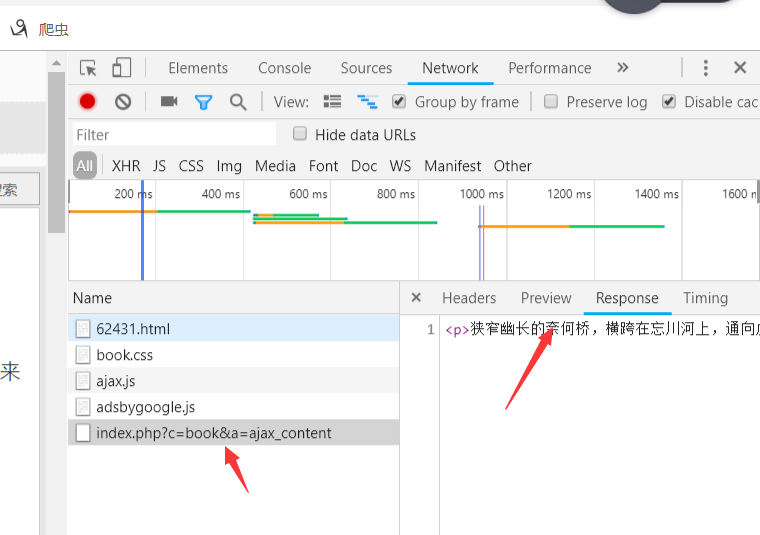

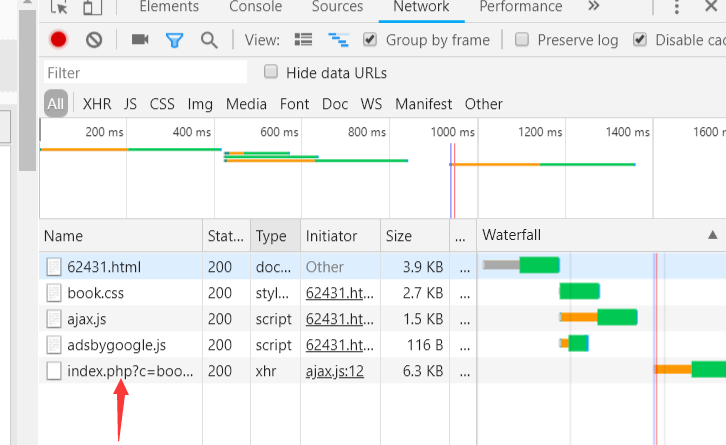

发现所有的文本存在这个xhr里

点击查看请求头信息

发现是post请求

请求的url是/index.php?c=book&a=ajax_content

请求的数据在最下面的form表单里

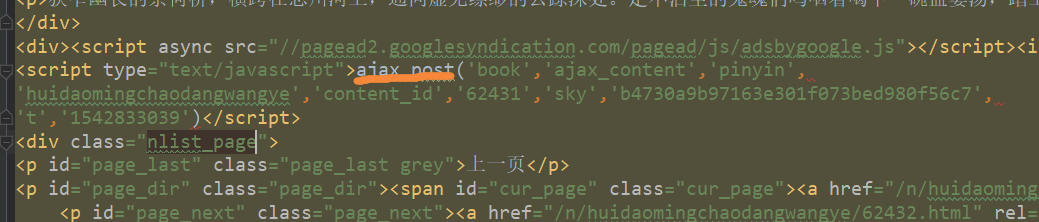

打开网页源文件和js文件,搜索这些表单信息

分别在ajax.js里和源文件里找到了这些

源文件里面的可以直接生成data数据表单

在ajax.js里可以知道rndval字段是当前时间,精确到毫秒

优化

采用了gvent进行异步IO处理,每一张网页保存在temp里面,最后将文件合成一个txt

代码如下:

1 #!/usr/bin/env python 2 # encoding: utf-8 3 4 """ 5 @version: 6 @author: Wish Chen 7 @contact: [email protected] 8 @file: get_novels.py 9 @time: 2018/11/21 19:43 10 11 """ 12 import gevent 13 from gevent import monkey 14 monkey.patch_all() 15 import requests, time, random, re, os 16 from bs4 import BeautifulSoup 17 18 dir = os.path.dirname(os.path.abspath(__file__)) 19 20 def getHTMLText(url, data=[], method='get'): 21 """ 22 获取网站的源代码 23 请求默认为get 24 :param url: 25 :param data: 26 :param method: 27 :return: 28 """ 29 headers = {"User-Agent":"Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/69.0.3497.81 Safari/537.36"} 30 proxies = {} 31 try: 32 # print("start", url) 33 r = requests.request(method, url, proxies=proxies, headers=headers, data=data) 34 r.raise_for_status() 35 # r.encoding = r.apparent_encoding 36 # print('end', url) 37 return r 38 except: 39 return r.status_code 40 41 42 def fetch_async(x, url): 43 """ 44 异步IO所需要执行的操作 45 获取源文件 46 模拟向ajax请求获取完整文字 47 每一章输入到temp文件夹下 48 :param x: 49 :param url: 50 :return: 51 """ 52 url_main = "http://quanben5.com/index.php?c=book&a=ajax_content" 53 r = getHTMLText(url) # 获取每一章的源文件 54 title = re.search(r'<h1 class="title1">(.*)</h1>', r.text).group(1) 55 result = re.search(r'<script type="text/javascript">ajax_post\((.*)\)</script>', r.text).group(1) 56 num_list = result.split("','") 57 num_list[9] = num_list[9][:-1] 58 content = {} # 开始模拟post请求发送的表单 59 for i in range(1, 5): 60 content[num_list[i * 2]] = num_list[i * 2 + 1] 61 content['_type'] = "ajax" 62 content['rndval'] = int(time.time() * 1000) 63 r = getHTMLText(url_main, data=content, method='post') # 模拟post请求 64 soup = BeautifulSoup(r.text, "lxml") 65 with open(os.path.join(dir, 'temp', "%s.txt" % x), "w") as f: 66 f.writelines(''.join([str(x), '.', title, '\n\n'])) 67 for tag in soup.body.children: 68 if tag.name == 'p': 69 f.writelines(''.join([' ', tag.string.strip(), '\n\n'])) 70 print('%d.%s 下载完成' % (x, title)) 71 72 73 74 def get_together(name, author): 75 """ 76 将temp目录下的各网页下载下来的txt 77 合并在一起 78 并删除temp文件 79 :param name: 80 :param author: 81 :return: 82 """ 83 with open(os.path.join(dir, "%s.txt" % name), "w") as f: 84 f.writelines(''.join([name, '\n\n作者:', author, '\n\n'])) 85 for i in range(len(os.listdir(os.path.join(dir, 'temp')))): 86 f.write(open(os.path.join(dir, 'temp', "%s.txt" % (i+1)), "r").read()) 87 f.write('\n\n') 88 # os.remove(os.path.join(dir, 'temp', "%s.txt" % (i+1))) 89 90 91 def parseByQB5(response, host): 92 """ 93 在全本5小说网的源码下爬取小说 94 获得书名和作者 95 采用gevent异步IO优化 96 :param response: 97 :param host: 98 :return: 99 """ 100 soup = BeautifulSoup(response.text, 'html.parser') 101 url_text = soup.find_all('div', 'box')[2] 102 main_text = url_text.find_all('h2')[0].next_sibling 103 url_list = [] 104 for tag in main_text.descendants: 105 if tag.name == 'li': 106 url = ''.join(['http://', host, tag.a.attrs['href']]) 107 url_list.append(url) 108 from gevent.pool import Pool 109 pool = Pool(20) 110 gevent.joinall([pool.spawn(fetch_async, i+1, url=url_list[i]) for i in range(len(url_list))]) 111 name = re.search(r"<h3><span>(.*)</span></h3>", response.text).group(1) 112 author = re.search(r'<span class="author">(.*)</span></p>', response.text).group(1) 113 get_together(name, author) 114 115 116 117 118 def getNovelUrls(url): 119 """ 120 通过小说的目录网址判断小说所在的网站 121 并调用属于该网站的爬虫语句 122 :param url: 123 :return: 124 """ 125 126 response = getHTMLText(url) 127 host = url.split('//')[1].split('/')[0] 128 host_list = { 129 "quanben5.com": parseByQB5 130 } 131 host_list[host](response, host) 132 133 134 if __name__ == '__main__': 135 url_list = [ 136 "https://www.qu.la/book/365/", 137 "https://www.qb5200.tw/xiaoshuo/0/357/", 138 "http://quanben5.com/n/doupocangqiong/xiaoshuo.html", 139 "http://quanben5.com/n/dazhuzai/xiaoshuo.html", 140 "http://quanben5.com/n/douluodalu/xiaoshuo.html", 141 "http://quanben5.com/n/renxingderuodian/xiaoshuo.html" 142 ] 143 if not os.path.exists('temp'): 144 os.mkdir('temp') 145 getNovelUrls(url_list[5])

封装性还不够好

最好一个网站用一个类来封装

采用scrapy框架

正在设计中...

未解决问题:

代理IP问题:

使用的是免费的代理

还是无法解决只能下载3个页面之后报错503的问题

搜索功能:

模拟搜索界面提交请求,在返回页中列出所有小说的名字和作者以及简介

可以简单实现

多网站定制

要观察各个网站的目录源代码结构以及文章源代码结构

每一个网站都可以用一个parse函数来解析其内容