版权声明:未经允许,私自转载,版权必究。 https://blog.csdn.net/Charles_TheGod/article/details/83588212

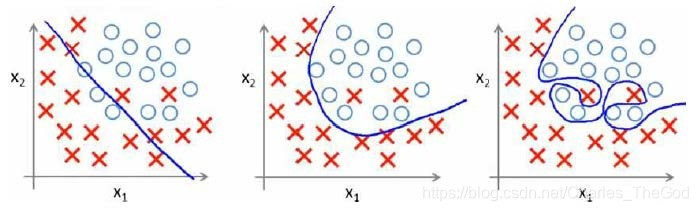

过拟合问题:

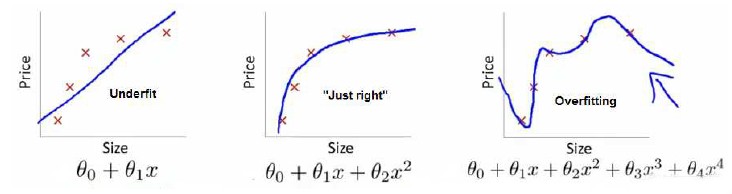

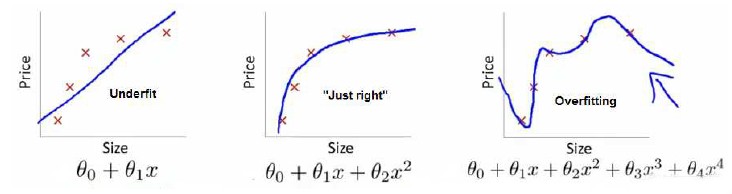

下图是一个回归问题

第一个模型是一个线性模型,欠拟合,不能很好地适应我们的训练集;我们看看这些数据,很明显,随着房子面积增大,住房价格的变化趋于稳定或者说越往右越平缓。因此线性回归并没有很好拟合训练数据。

没有很好地拟合训练数据,我们称之为欠拟合,或者叫做高偏差

第三个模型是一个四次方的模型,过于强调拟合原始数据,而丢失了算法的本质:预测新数据。我们可以看出,若给出一个新的值使之预测,它将表现的很差,是过拟合,虽然能非常好地适应我们的训练集但在新输入变量进行预测时可能会效果不好;

完美的拟合了训练数据,而不能够很好地预测新数据,我们称之为过拟合,或者叫做高方差

第二个而中间的模型似乎最合适.

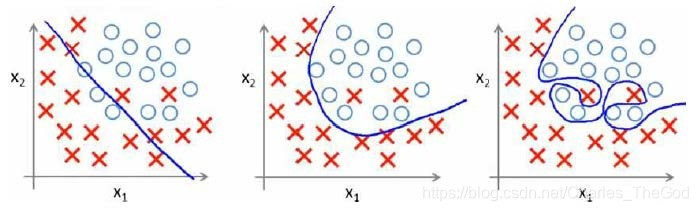

下图是一个分类问题

分类问题我们就以多项式理解,

x 的次数越高,拟合的越好,但相应的预测的能力就可能变差。

问题是,如果我们发现了过拟合问题,应该如何处理?

- 丢弃一些不能帮助我们正确预测的特征。可以是手工选择保留哪些特征,或者使用一些模型选择的算法来帮忙(例如PCA)

- 正则化。 保留所有的特征,但是减少参数的大小(magnitude)。

正规化代价函数

假设上面的回归问题我们使用的模型是:

hθ(x)=θ0+θ1x1+θ2x22+θ3x33+θ4x44

我们从前面的图形可以看出,正是那些高次项导致了过拟合的产生,所以如果我们能让这些高次项的系数接近于0的话,我们就能很好的拟合了

所以我们要做的就是在一定程度上减小这些参数

θ 的值,这就是正则化的基本方法。我们决定要减少

θ3和

θ4的大小,我们要做的便是修改代价函数,在其中

θ3和

θ4 设置一点惩罚。这样做的话,我们在尝试最小化代价时也需要将这个惩罚纳入考虑中,并最终导致选择较小一些的

θ3和

θ4。

惩罚:就是指减少参数的大小。

修改后的代价函数:

θmin2m1[i=1∑m(hθ(x(i))−y(i))2+1000θ32+10000θ42]

通过这样的代价函数选择出的

θ3和

θ4 对预测结果的影响就比之前要小许多。假如我们有非常多的特征,我们并不知道其中哪些特征我们要惩罚,我们将对所有的特征进行惩罚,并且让代价函数最优化的软件来选择这些惩罚的程度

这样我们就得到了一个更简单的可以防止过拟合问题的假设:

J(θ)=2m1[i=1∑m(hθ(x(i))−y(i))2+λj=1∑nθj2]

其中

λ又称为正则化参数(Regularization Parameter)

注意:根据惯例我们不对

θ0进行惩罚

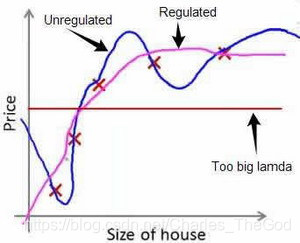

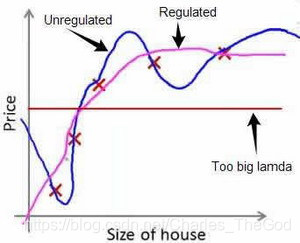

经过正则化处理的模型与原模型的可能对比如下图所示:

如果选择的正则化参数

λ 过大,则会把所有的参数都最小化了,导致模型变成

hθ(x)=θ0,也就是上图中红色直线所示的情况,造成欠拟合。

那为什么增加的一项

λ=j=1∑nθj2 可以使

θ的值减小呢?

因为如果我们令

λ 的值很大的话,为了使Cost Function 尽可能的小,所有的

θ 的值(不包括

θ0)都会在一定程度上减小。

但若

λ 的值太大了,那么

θ(不包括

θ0)都会趋近于0,这样我们所得到的只能是一条平行于

x轴的直线。

所以对于正则化,我们要取一个合理的

λ 的值,这样才能更好的应用正则化。

回顾一下代价函数,为了使用正则化,让我们把这些概念应用到到线性回归和逻辑回归中去,那么我们就可以让他们避免过度拟合了。

正规化线性回归模型

正则化线性回归代价函数:

J(θ)=2m1i=1∑m[((hθ(x(i))−y(i))2+λj=1∑nθj2)]

梯度下降算法:

θj:=θj(1−amλ)−am1i=1∑m(hθ(x(i))−y(i))xj(i)

正则化逻辑回归模型

正则化逻辑回归代价函数:

J(θ)=m1i=1∑m[−y(i)log(hθ(x(i)))−(1−y(i))log(1−hθ(x(i)))]+2mλj=1∑nθj2

梯度下降算法

θj:=θj−a[m1i=1∑m(hθ(x(i))−y(i))xj(i)+mλθj]

注意:

- 虽然正则化的逻辑回归中的梯度下降和正则化的线性回归中的表达式看起来一样,但由于两者的

hθ(x)不同所以还是有很大差别。

-

θ0不参与其中的任何一个正则化。