版权声明:本文为博主原创文章,遵循 CC 4.0 BY-SA 版权协议,转载请附上原文出处链接和本声明。

regression(回归)和regularization(正则化)

一,regression是什么

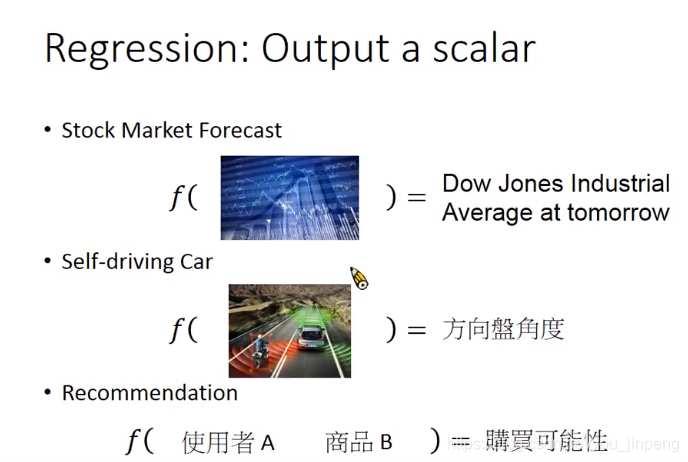

翻译:回归,输出一个数值的函数就叫regression,是机器学习的一种任务。

例子1输出明天股票的升涨数值,例子2输出方向盘应该转动多少角度,例子3输出购物者可能购买某件商品的可能性。

二,regression

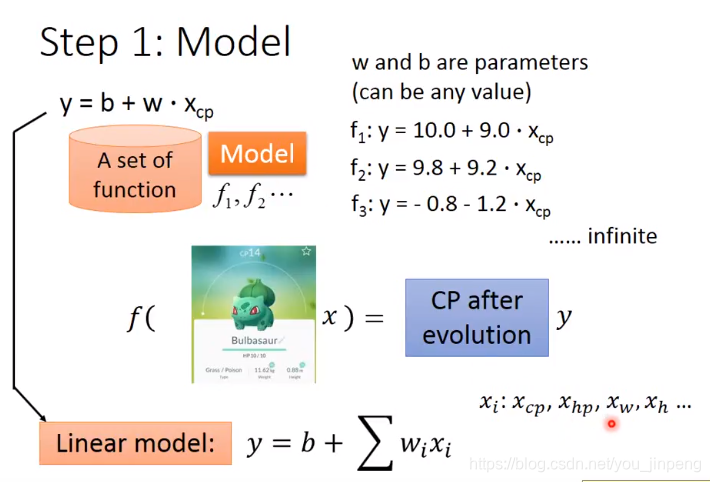

step1:model

model就是要给他拟一条函数,可以考虑多少次方和考虑多少参数参与,这就是model。

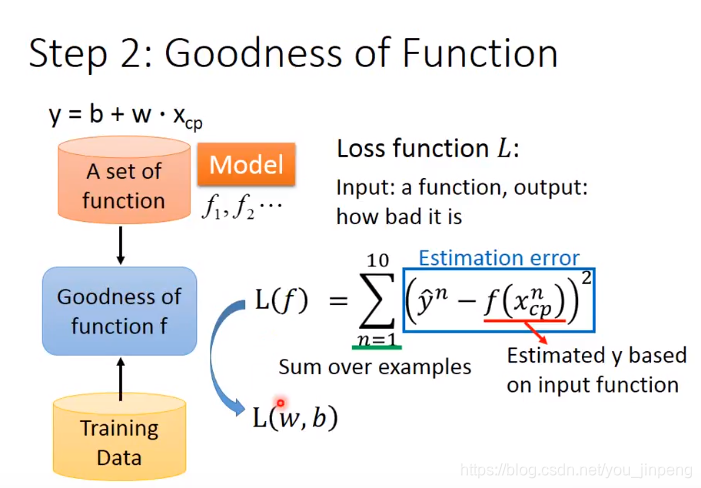

step2:goodness of function(直译:函数的优度)

损失函数:实际与测试结果的偏差。

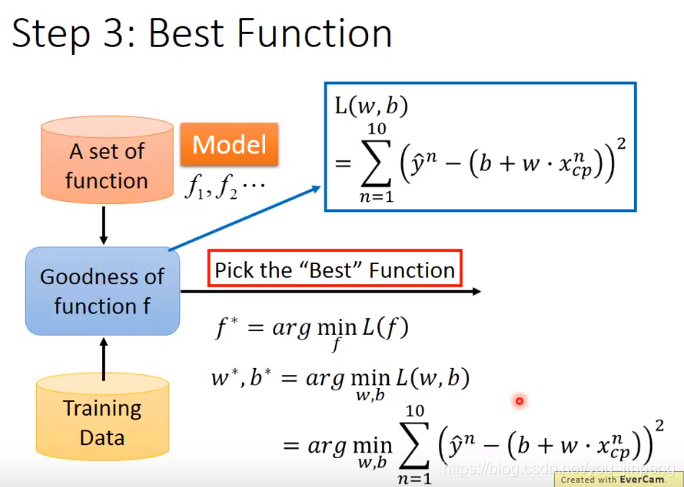

step3:best function

,来找出model一系列函数(因为w和b可变)中最符合的函数(让损失函数最小),实际上是确定w和b的值。

三 梯度下降 (Gradient Descent)

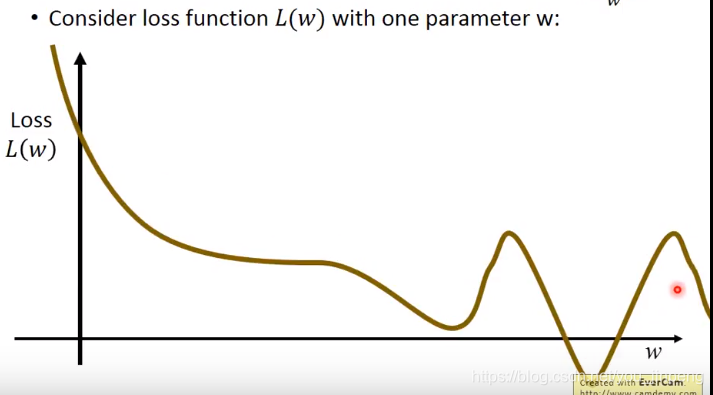

假设只有一个参数,如上图,x轴是该参数w,y轴是错误率,那么要找错误率最低的地方:先随机确定一点(w。),求一下该点的导,看一下是正还是负。如果正,说明原函数是上升,反之下降。然后参数w再根据正负,决定应该向左还是右边(即要加还是减),假设,要向右边,则加上【学习率】。。。多个参数分别这样求

该方法确定的最优参数有可能陷入局部最优解而不是最局最优借,如上图。

四 模型函数的次方加多或者参数加多

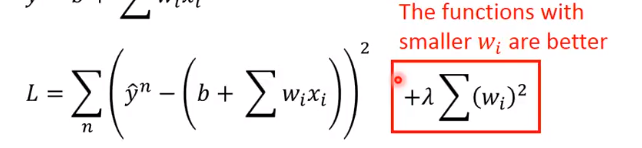

regularization(正则化,规范化)

寻找一个loss最小的,又使得参数尽量小的函数。参数尽量小的意义是:使得模型的函数最平滑(smoother):因为我们相信,比较smoother的方程是比较有可能是正确的方程。(我也不知道为什么,待继续学习)