(mnist_test.py)。

前向传播过程文件(mnist_forward.py)

'''

在前向传播过程中,需要定义网络模型输入层个数、隐藏层节点数、输出层个数,

定义网络参数 w、偏置 b,定义由输入到输出的神经网络架构。

实现手写体 mnist 数据集的识别任务前向传播过程如下:

'''

import tensorflow as tf

INPUT_NODE = 784

OUTPUT_NODE = 10

LAYER1_NODE = 500

#设置权重

def get_weight(shape, regularizer):

w = tf.Variable(tf.truncated_normal(shape,stddev=0.1))

#当在前向传播过程中即 forward.py 文件中,设置正则化参数 regularization为1时,则表明在反向传播过程中优化模型参数时,需要在损失函数中加入正则化项。

if regularizer != None: tf.add_to_collection('losses', tf.contrib.layers.l2_regularizer(regularizer)(w))

return w

#设置偏值项

def get_bias(shape):

b = tf.Variable(tf.zeros(shape))

return b

#前向传播定义

def forward(x, regularizer):

w1 = get_weight([INPUT_NODE, LAYER1_NODE], regularizer)

b1 = get_bias([LAYER1_NODE])

#防止过拟合,x*w1+b1

y1 = tf.nn.relu(tf.matmul(x, w1) + b1)

w2 = get_weight([LAYER1_NODE, OUTPUT_NODE], regularizer)

b2 = get_bias([OUTPUT_NODE])

# y=y1*w2+b2

y = tf.matmul(y1, w2) + b2

return y

由上述代码可知,在前向传播过程中,规定网络输入结点为 784 个(代表每张输入图片的像素个数), 隐藏层节点 500 个,输出节点 10 个(表示输出为数字 0-9的十分类)。 由输入层到隐藏层的参数 w1 形状为[784,500],由隐藏层到输出层的参数 w2 形状为[500,10],参数满足截断正态分布,并使用正则化,将每个参数的正则化损失加到总损失中。由输入层到隐藏层的偏置 b1 形状为长度为 500的一维数组, 由隐藏层到输出层的偏置 b2 形状为长度为 10 的一维数组,初始化值为全 0。 前向传播结构第一层为输入 x 与参数 w1 矩阵相乘加上偏置 b1,再经过 relu 函数,得到隐藏层输出 y1。 前向传播结构第二层为隐藏层输出 y1 与参数 w2 矩阵相乘加上偏置 b2,得到输出 y。由于输出 y 要经过 softmax 函数,使其符合概率分布,故输出 y 不经过 relu 函数。

反向传播过程文件(mnist_backward.py)

'''

反向传播过程实现利用训练数据集对神经网络模型训练,通过降低损失函数值,

实现网络模型参数的优化,从而得到准确率高且泛化能力强的神经网络模型。

实现手写体 mnist 数据集的识别任务反向传播过程如下:

'''

import tensorflow as tf

from tensorflow.examples.tutorials.mnist import input_data

import mnist_forward

import os

BATCH_SIZE = 200 #数据集大小

LEARNING_RATE_BASE = 0.1 #学习率

LEARNING_RATE_DECAY = 0.99 #学习衰减率

REGULARIZER = 0.0001 #防止过拟合,正则化

STEPS = 50000 #轮数

MOVING_AVERAGE_DECAY = 0.99 #滑动平均值

MODEL_SAVE_PATH="./model/" #模型保存路径

MODEL_NAME="mnist_model" #模型

#反向传播过程完成网络参数的训练,引入数据集,训练模型

def backward(mnist):

#定义神经网络的输入、参数和输出,定义后向传播过程

x = tf.placeholder(tf.float32, [None, mnist_forward.INPUT_NODE])

y_ = tf.placeholder(tf.float32, [None, mnist_forward.OUTPUT_NODE])

#定义前向传播函数

y = mnist_forward.forward(x, REGULARIZER)

global_step = tf.Variable(0, trainable=False)

#正则化项在前向传播中已加入,tf.nn.sparse_softmax_cross_entropy_with_logits()表示 softmax()函数与交叉熵一起使用。

ce = tf.nn.sparse_softmax_cross_entropy_with_logits(logits=y, labels=tf.argmax(y_, 1))

cem = tf.reduce_mean(ce)

loss = cem + tf.add_n(tf.get_collection('losses'))

#在训练模型时,使用指数衰减学习率可以使模型在训练的前期快速收敛接近较优解,又可以保证模型在训练后期不会有太大波动

learning_rate = tf.train.exponential_decay(

LEARNING_RATE_BASE,

global_step,

mnist.train.num_examples / BATCH_SIZE,

LEARNING_RATE_DECAY,

staircase=True)

#随机梯度下降算法保持单一的学习率更新所有的参数,学习率在训练过程中并不会改变。

# train_step 表示利用优化算法对模型参数进行优化

train_step = tf.train.GradientDescentOptimizer(learning_rate).minimize(loss, global_step=global_step)

#在模型训练时引入滑动平均可以使模型在测试数据上表现的更加健壮。

ema = tf.train.ExponentialMovingAverage(MOVING_AVERAGE_DECAY, global_step)

ema_op = ema.apply(tf.trainable_variables())

with tf.control_dependencies([train_step, ema_op]):

train_op = tf.no_op(name='train')

#保存模型,tf.train.Saver()用来实例化 saver 对象。

saver = tf.train.Saver()

with tf.Session() as sess:

init_op = tf.global_variables_initializer()#初始化所有参数

sess.run(init_op)

#训练模型

for i in range(STEPS):

xs, ys = mnist.train.next_batch(BATCH_SIZE)

_, loss_value, step = sess.run([train_op, loss, global_step], feed_dict={x: xs, y_: ys})

if i % 1000 == 0: #每隔1000轮统计一次损失函数最小值

print("After %d training step(s), loss on training batch is %g." % (step, loss_value))

saver.save(sess, os.path.join(MODEL_SAVE_PATH, MODEL_NAME), global_step=global_step) #保存模型

def main():

mnist = input_data.read_data_sets("./data/", one_hot=True) #输入数据集

backward(mnist) #调用后向传播,训练模型

if __name__ == '__main__': #主函数执行

main()由上述代码可知,在反向传播过程中,首先引入 tensorflow、 input_data、前向传播 mnist_forward 和 os 模块,定义每轮喂入神经网络的图片数、初始学习率、学习率衰减率、正则化系数、训练轮数、模型保存路径以及模型保存名称等相关信息。 在反向传播函数 backword 中, 首先读入 mnist,用 placeholder 给训练数据 x 和标签 y_占位,调用 mnist_forward 文件中的前向传播过程 forword()函数,并设置正则化,计算训练数据集上的预测结果 y,并给当前计算轮数计数器赋值,设定为不可训练类型。 接着, 调用包含所有参数正则化损失的损失函数loss, 并设定指数衰减学习率 learning_rate。然后,使用梯度衰减算法对模型优化,降低损失函数,并定义参数的滑动平均。最后,在 with 结构中,实现所有参数初始化,每次喂入 batch_size 组(即 200 组)训练数据和对应标签,循环迭代 steps 轮,并每隔 1000 轮打印出一次损失函数值信息,并将当前会话加载到指定路径。 最后,通过主函数 main(),加载指定路径下的训练数据集,并调用规定的 backward()函数训练模型。

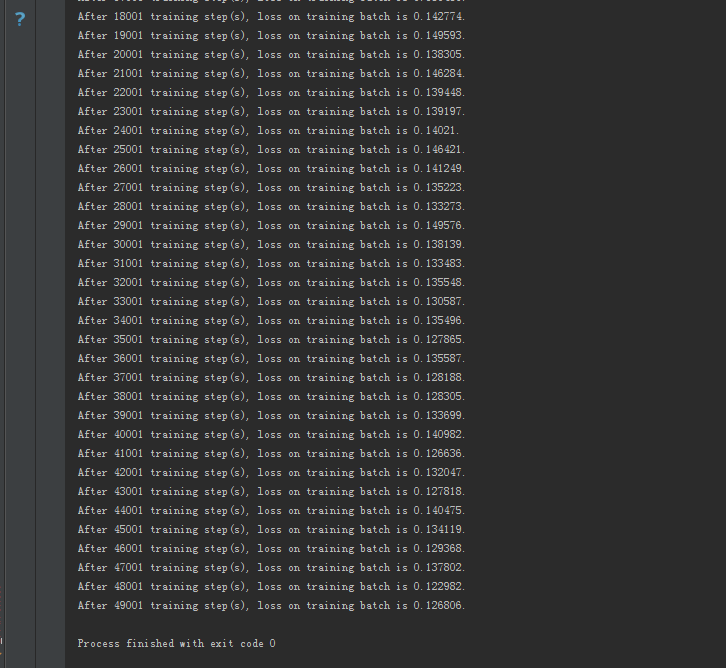

反向传播文件下的运行结果如下:

#coding:utf-8

'''

当训练完模型后, 给神经网络模型输入测试集验证网络的准确性和泛化性。注意,

所用的测试集和训练集是相互独立的。

实现手写体 mnist 数据集的识别任务测试传播过程如下:

'''

import time

import tensorflow as tf

from tensorflow.examples.tutorials.mnist import input_data

import mnist_forward

import mnist_backward

TEST_INTERVAL_SECS = 5

#制定模型测试函数

def test(mnist):

with tf.Graph().as_default() as g:

x = tf.placeholder(tf.float32, [None, mnist_forward.INPUT_NODE])

y_ = tf.placeholder(tf.float32, [None, mnist_forward.OUTPUT_NODE])

# 前向传播得到预测结果 y

y = mnist_forward.forward(x, None)

#在保存模型时,若模型中采用滑动平均,则参数的滑动平均值会保存在相应文件中。 通过实例化 saver 对象, 实现参数滑动平均值的加载

ema = tf.train.ExponentialMovingAverage(mnist_backward.MOVING_AVERAGE_DECAY)

ema_restore = ema.variables_to_restore()

saver = tf.train.Saver(ema_restore)

#在网络评估时,一般通过计算在一组数据上的识别准确率, 评估神经网络的效果

correct_prediction = tf.equal(tf.argmax(y, 1), tf.argmax(y_, 1))

#reduce_mean(x,axis)函数表示求取矩阵或张量指定维度的平均值

accuracy = tf.reduce_mean(tf.cast(correct_prediction, tf.float32))

while True:

with tf.Session() as sess:

# 加载训练好的模型

ckpt = tf.train.get_checkpoint_state(mnist_backward.MODEL_SAVE_PATH)#存储路径

# 如果已有 ckpt 模型则恢复

if ckpt and ckpt.model_checkpoint_path:

# 恢复会话

saver.restore(sess, ckpt.model_checkpoint_path)

##恢复轮数,字符串.split( )函数表示按照指定“拆分符” 对字符串拆分, 返回拆分列表

global_step = ckpt.model_checkpoint_path.split('/')[-1].split('-')[-1]

accuracy_score = sess.run(accuracy, feed_dict={x: mnist.test.images, y_: mnist.test.labels})#喂入数据计算

print("After %s training step(s), test accuracy = %g" % (global_step, accuracy_score))

else:

print('No checkpoint file found')

return

time.sleep(TEST_INTERVAL_SECS)

def main():

#加载数据集,第一个参数表示数据集存放路径, 第二个参数表示数据集的存取形式。当第二个参数为 Ture 时, 表示以独热码形式存取数据集。

##read_data_sets()会检查指定路径内是否已经有数据集,若指定路径中没有数据集,则自动下载,并将 mnist 数据集分为训练集 train、验证集 validation 和测试集 test 存放。

mnist = input_data.read_data_sets("./data/", one_hot=True)

test(mnist) #调用测试数据集函数

if __name__ == '__main__':

main()

进行模型在测试集上的准确率验证。

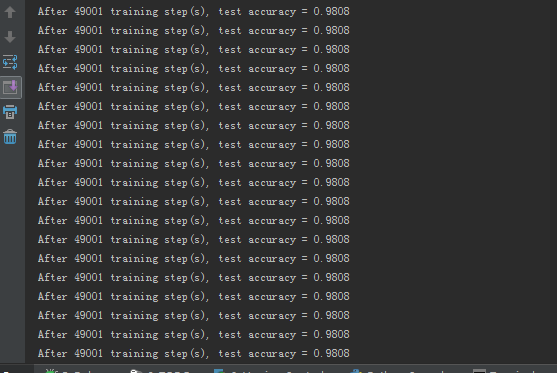

测试文件下运行结果如下:

由运行结果可以看出,随着训练轮数的增加, 网络模型的损失函数值在不断降低,并且在测试集上的准确率在不断提升,有较好的泛化能力。