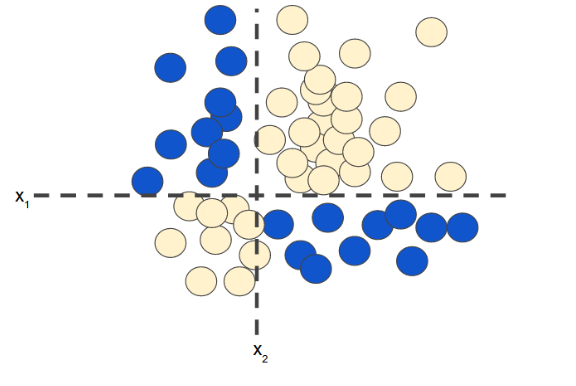

回归模型可用于预测连续值,分类模型可用于预测离散值。

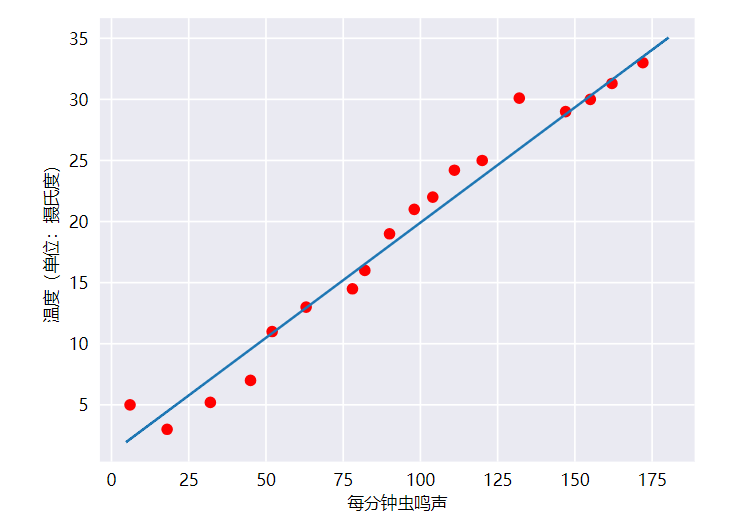

线性回归是一种回归模型,通过将特征之间进行线性组合,从而得到连续的输出。可用特征组合处理非线性规律。

逻辑回归是分类模型,可用于二分类也可用于多分类问题。是从线性回归中衍生出来的分类策略,通过将S型函数用于线性预测而得到分类任务中每个标签的概率。逻辑回归是一种极其高效的概率计算机制。

1、线性回归

线性回归用于预测连续值。

可用于处理线性问题,也可用于处理非线性问题。对于非线性问题,使用特征组合来解决。

是输入的特征, 是权重, 是偏差

线性回归损失函数

均方误差 (MSE) 指的是每个样本的平均平方损失。要计算 MSE,请求出各个样本的所有平方损失之和,然后除以样本数量:

2、逻辑回归

逻辑回归可用于二分类问题也可用于多分类问题,输出的结果为概率值。

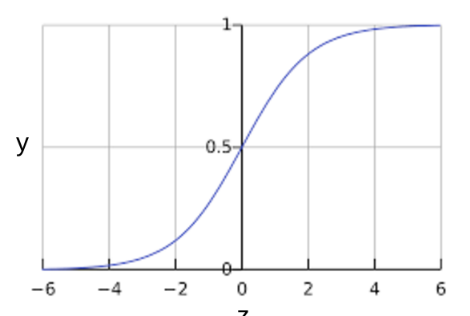

逻辑回归通过S型函数将逻辑回归的输出固定在0~1之间。

S型函数

表示逻辑回归模型线性层的输出, 。

是逻辑回归模型针对特定样本 的输出。

S型函数图像如下:

逻辑回归与似然函数

逻辑回归的损失函数是对数损失函数,定义如下:

“ ”是有标签样本中的标签。由于这是逻辑回归,因此“ ”的每个值必须是 0 或 1。

“ ”是对于特征集“ ”的预测值(介于 0 和 1 之间)。

对数损失函数是似然函数的负对数(假设“

”属于伯努利分布即两点分布)。

实际上使用最大似然估计求逻辑回归中的一系列参数(权重和偏差)

似然函数

似然函数是一种关于统计模型中参数的函数,在参数估计方法中具有重要作用,表示模型参数的似然性。

概率用于在已知一些参数的情况下,预测接下来的观测所得到的结果,而似然性则是用于在已知某些观测所得到的结果时,对有关事物的性质的参数进行估计。

似然函数也是一种条件概率函数,似然函数取得最大值表示相应的参数能够使得统计模型最为合理。