概要

本篇博客的所上传的资源主要同步网易云课堂上吴恩达的机器学习视频的第二集的主要内容,只同步到局部加权线性回归(即LWR)。资源已经上传,链接为:https://download.csdn.net/download/qq_30091945/10449863

如果想要转载请注明:http://blog.csdn.net/qq_30091945

主要内容

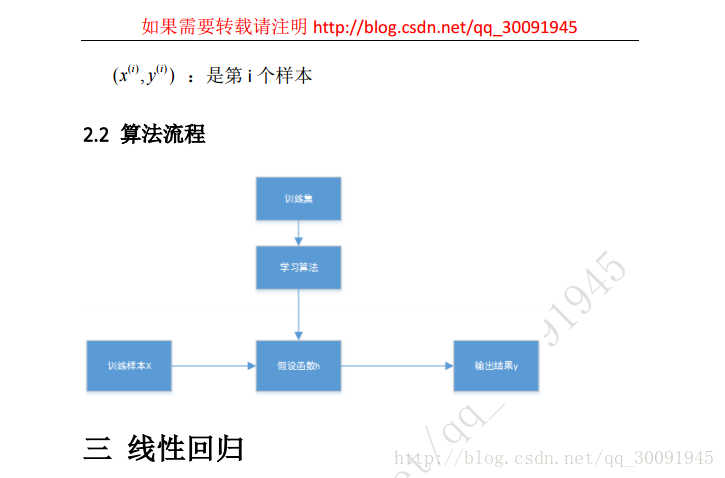

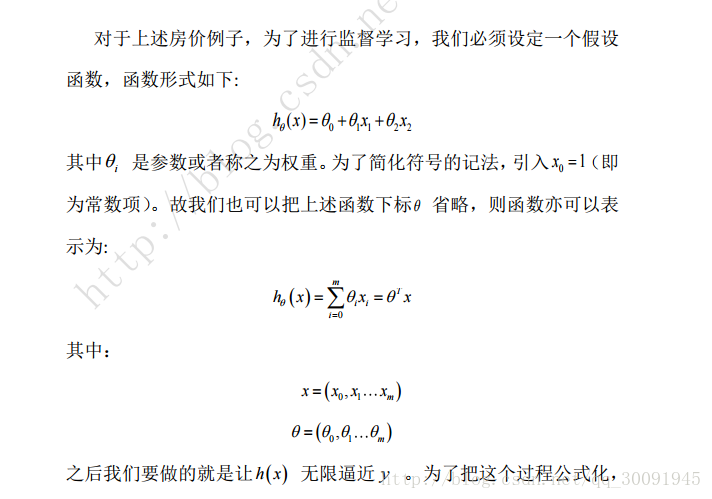

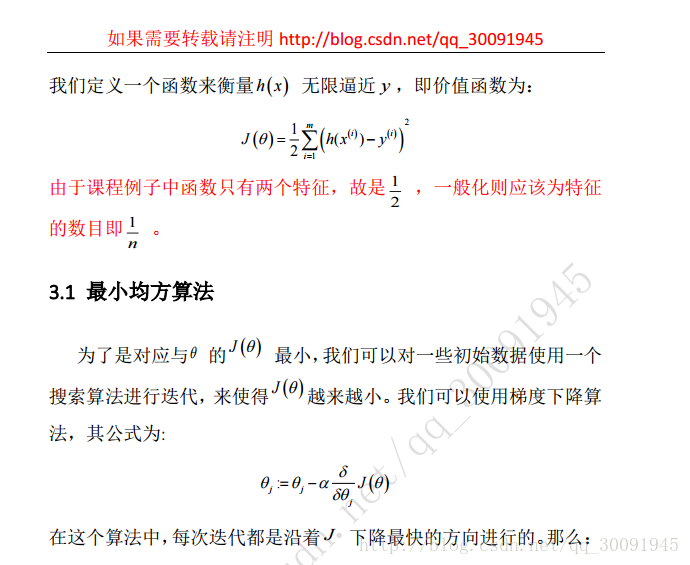

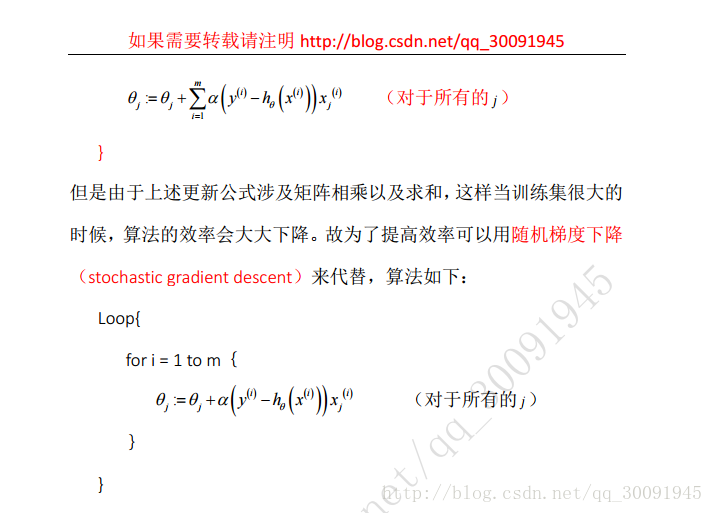

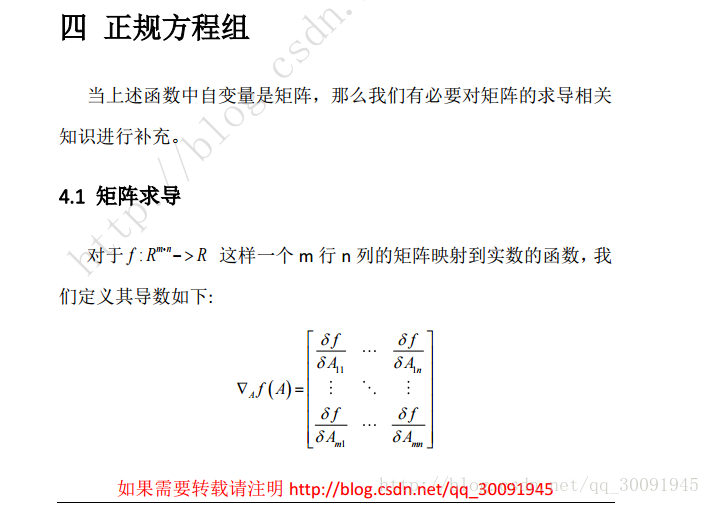

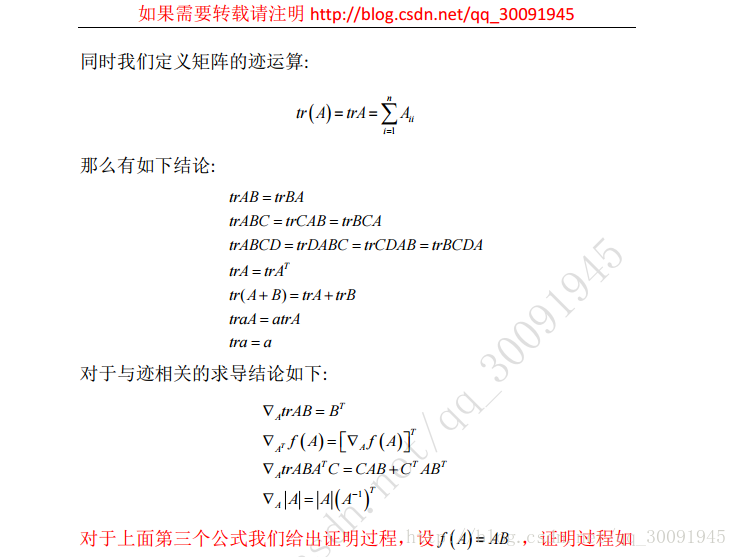

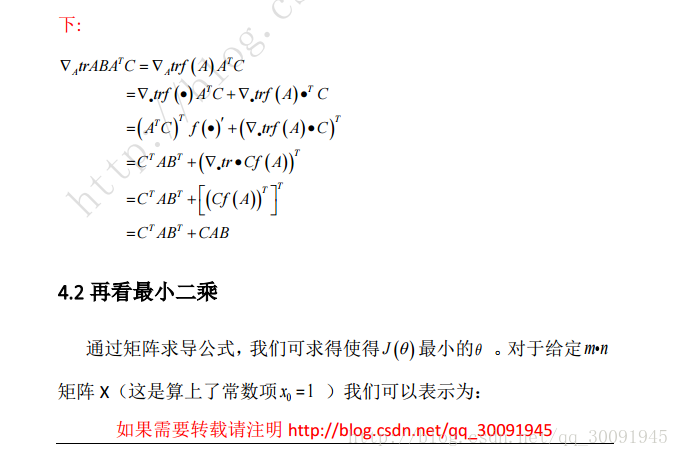

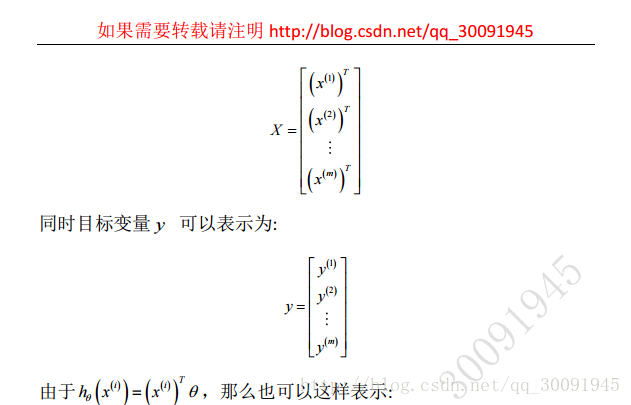

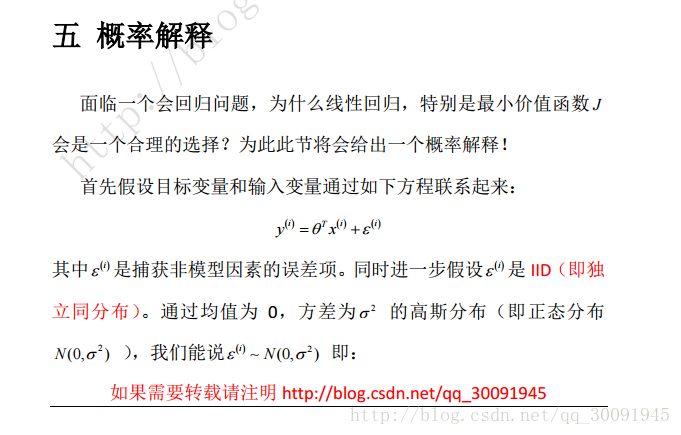

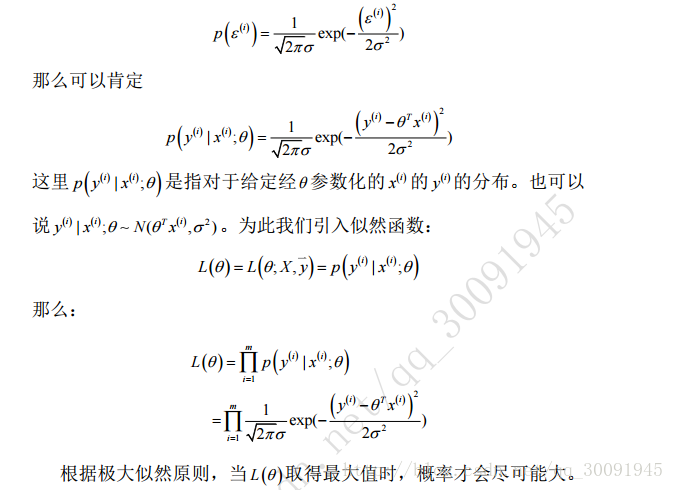

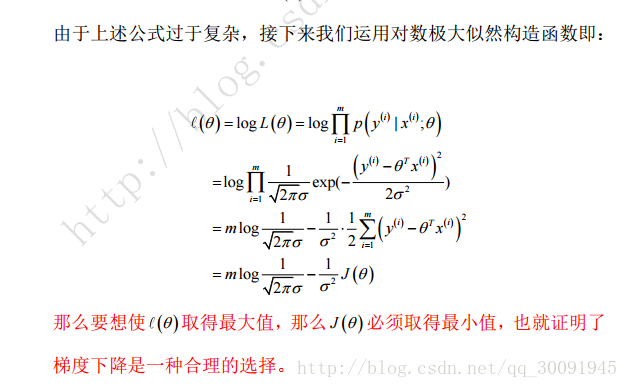

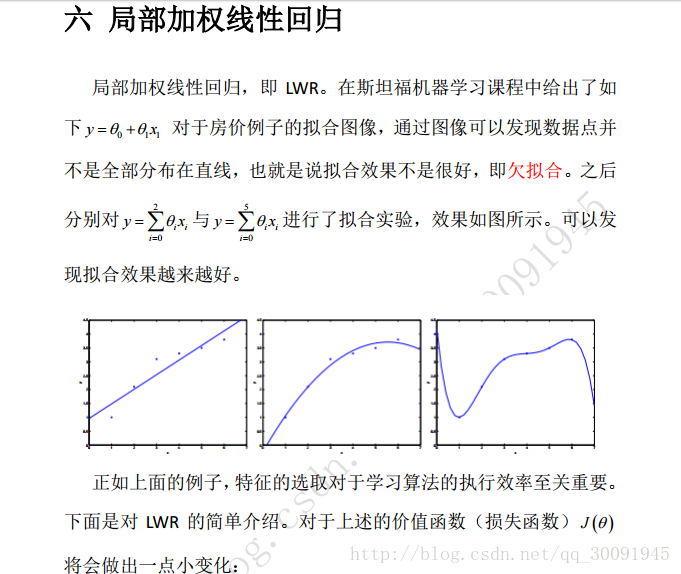

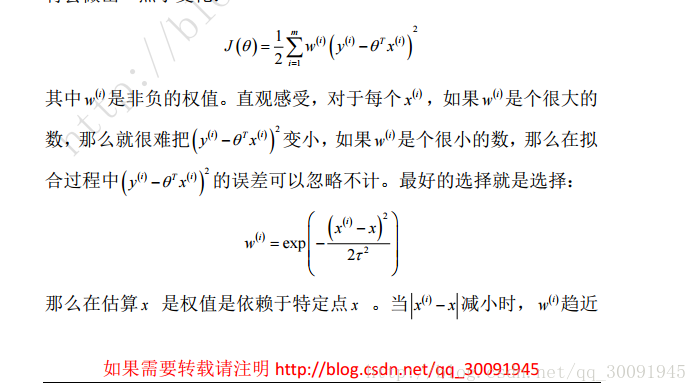

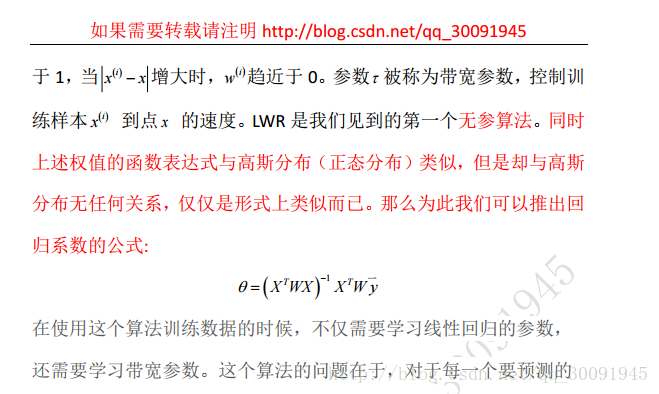

在这一讲中,吴恩达主要讲解了监督学习的概念,机器学习算法大致流程,线性回归概念及其拟合方程。之后定义了损失函数,并具体介绍了损失函数下的梯度下降算法的相关公式推导。详细讲解了BGD(批量梯度下降)算法和SGD(随机梯度下降)算法的原理及其优缺点。之后重点回归了矩阵的求导、矩阵的迹的相关结论与证明。并利用矩阵的迹推导出矩阵形式下的梯度下降公式(正规方程组)。接着利用最大似然估计来对梯度下降算法和损失函数进行严谨的数学解释。并最后把线性回归推广到局部加权回归。

PS:由于讲义内容过多,虽然下面对pdf文件进行了截图展示,但是为了读者阅读方便,还请转到网址下载:https://download.csdn.net/download/qq_30091945/10449863。

同时由于word文档丢失,自己为了方便以后更改方便,因此把之前的pdf文件重新复制粘贴到word重新排版,故下面的截图和资源的pdf有些区别,请谅解。