前提

hadoop2.7.5搭建完成

hadoop2.7.5搭建可以参考:https://blog.csdn.net/qq_40856560/article/details/80636173

三台主机

192.168.79.132 master

192.168.79.135 slave1

192.168.79.133 slave2

Hbase文件下载:http://archive.apache.org/dist/hbase/

1.解压Hbase

tar -zxvf hbase-1.2.6.1-bin.tar.gz -C /opt/

2.改名

mv /opt/hbase1.2.6.1/ /opt/hbase

3.修改配置文件

1)vi /opt/hbase/conf/hbase-env.sh

在文件末尾添加

| export JAVA_HOME=/opt/jdk(java的安装路径) |

因为默认就是使用自带的zookeeper,而HBase又依赖java,所以要加上javahome

2)vi /opt/hbase/conf/hbase-site.xml

<configuration> <!--指定Hbase在hdfs上存储数据的文件夹---> <name>hbase.rootdir</name> <value>hdfs://master:9000/opt/hbase/hbase_db</value> </property> <!--开启Hbase的集群模式--> <name>hbase.cluster.distributed</name> <value>true</value> </property> <!--指定zookeeper集群的主机--> <name>hbase.zookeeper.quorum</name> <value>master,slave1,slave2</value> </property> </configuration> |

3)vi /opt/hbase/conf/regionservers

指定其他两台从节点的主机名

| slave1 slave2 |

4.将Hbase复制到从节点

scp -r /opt/hbase/ slave1:/opt/hbase/

scp -r /opt/hbase/ slave2:/opt/hbase/

5.启动

首先要确保Hadoop已经启动

1)start-hbase.sh

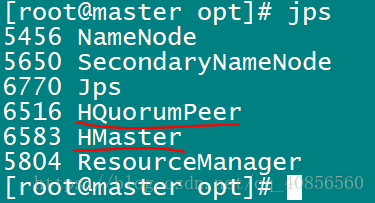

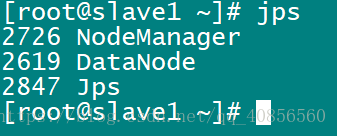

2)jps 查看各个节点的java进程

master

slave1

slave2

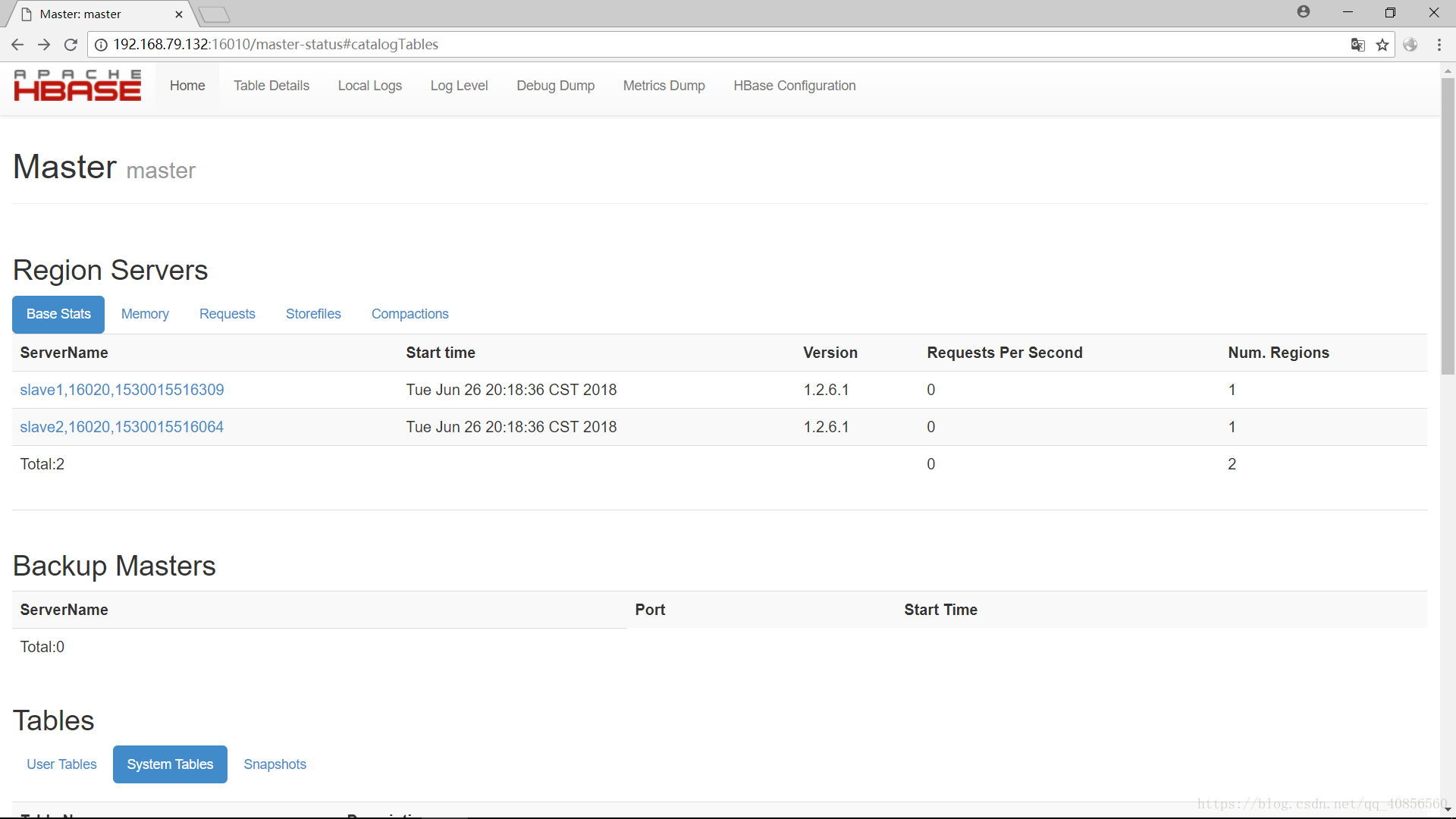

也可以访问web界面 http://192.168.79.132:16010

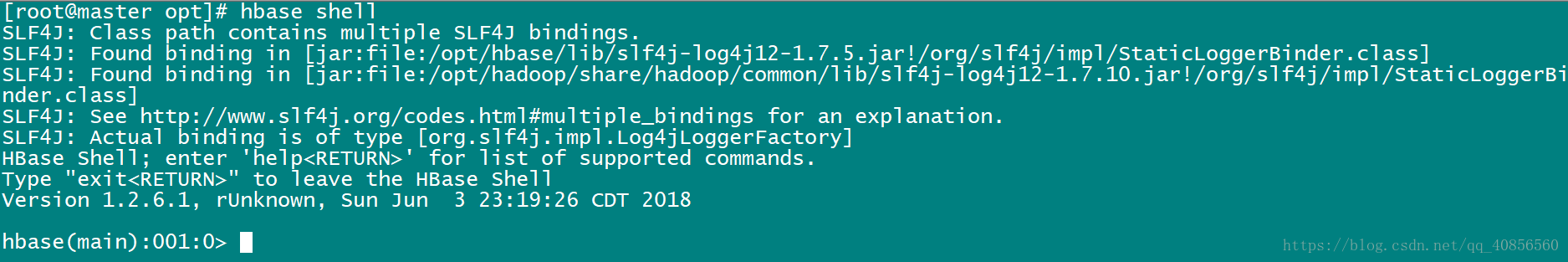

6.Hbase shell

Hbase启动后 使用 hbase shell 命令进入hbase shell命令行

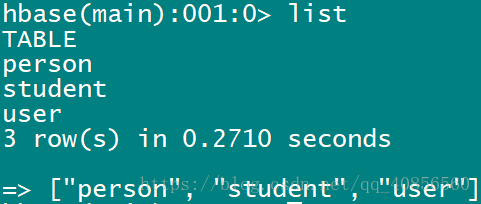

1.list 查看所有表

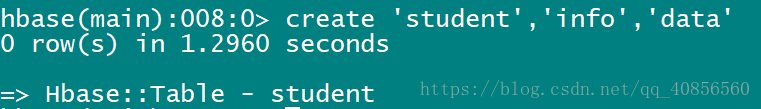

2.创建表

create 'tablename' ,'f1','f2'.....

3.插入数据

put 'tablename','0001','info:name','values'

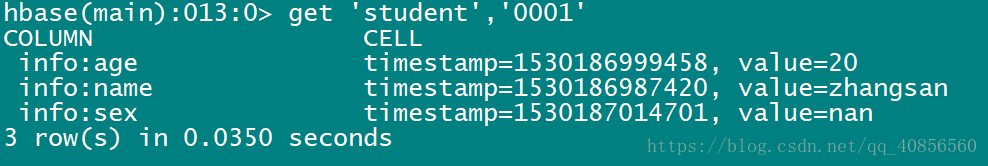

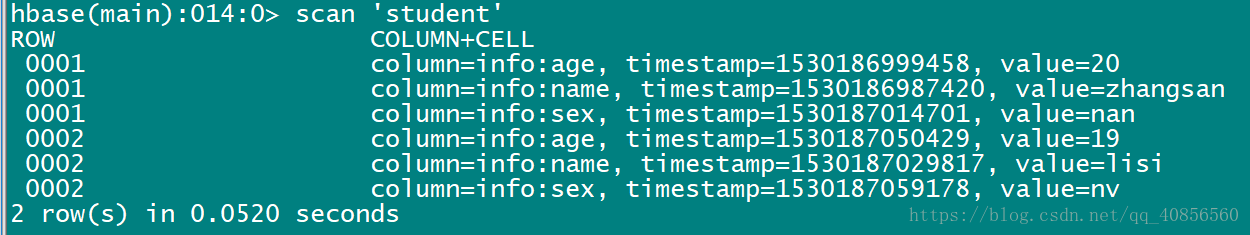

4.查询数据

get 'tablename','0001'

scan 'tablename'

5.删除表

disable 'tablename' 禁用表

drop 'tablename' 删除表