1.Cross-attention vs Self-attention

Cross-attention的输入来自不同的序列,Self-attention的输入来自同序列,也就是所谓的输入不同,但是除此之外,基本一致。

具体而言,

self-attention输入则是一个单一的嵌入序列。

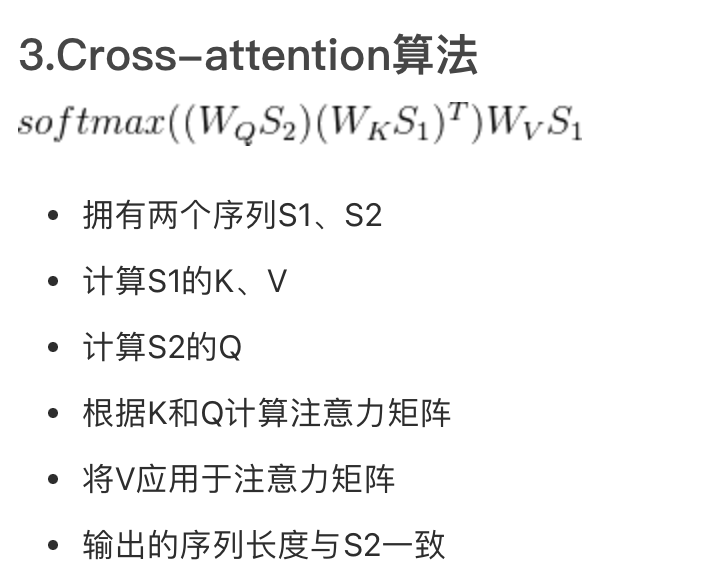

Cross-attention将两个相同维度的嵌入序列不对称地组合在一起,而其中一个序列用作查询Q输入,而另一个序列用作键K和值V输入。当然也存在个别情况,在SelfDoc的cross-attention,使用一个序列的查询和值,另一个序列的键。总而言之,QKV是由两序列拼凑的,不单一。

深度学习:cross-attention介绍以及与self-attention的区别

猜你喜欢

转载自blog.csdn.net/qq_45560230/article/details/132976196

今日推荐

周排行