CV - 计算机视觉 | ML - 机器学习 | RL - 强化学习 | NLP 自然语言处理

Subjects: cs.CV

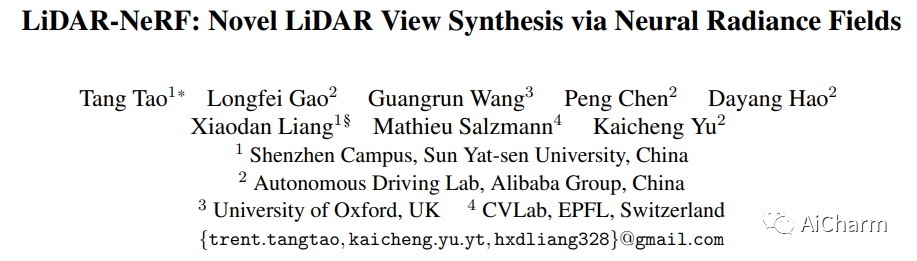

1.LiDAR-NeRF: Novel LiDAR View Synthesis via Neural Radiance Fields

标题:LiDAR-NeRF:通过神经辐射场的新型 LiDAR 视图合成

作者:Tang Tao, Longfei Gao, Guangrun Wang, Peng Chen, Dayang Hao, Xiaodan Liang, Mathieu Salzmann, Kaicheng Yu

文章链接:https://arxiv.org/abs/2304.10406

摘要:

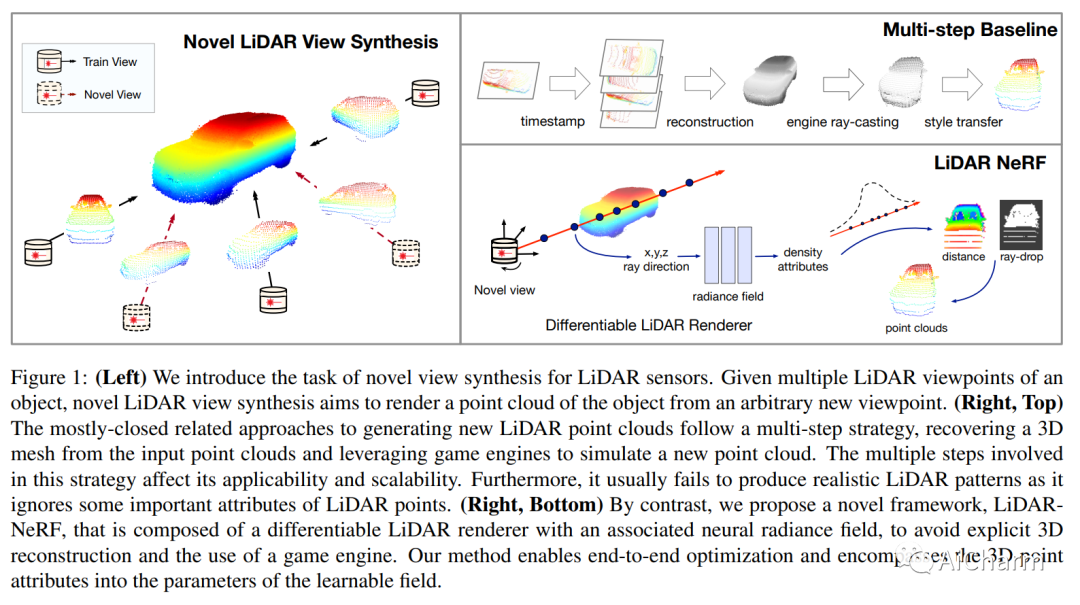

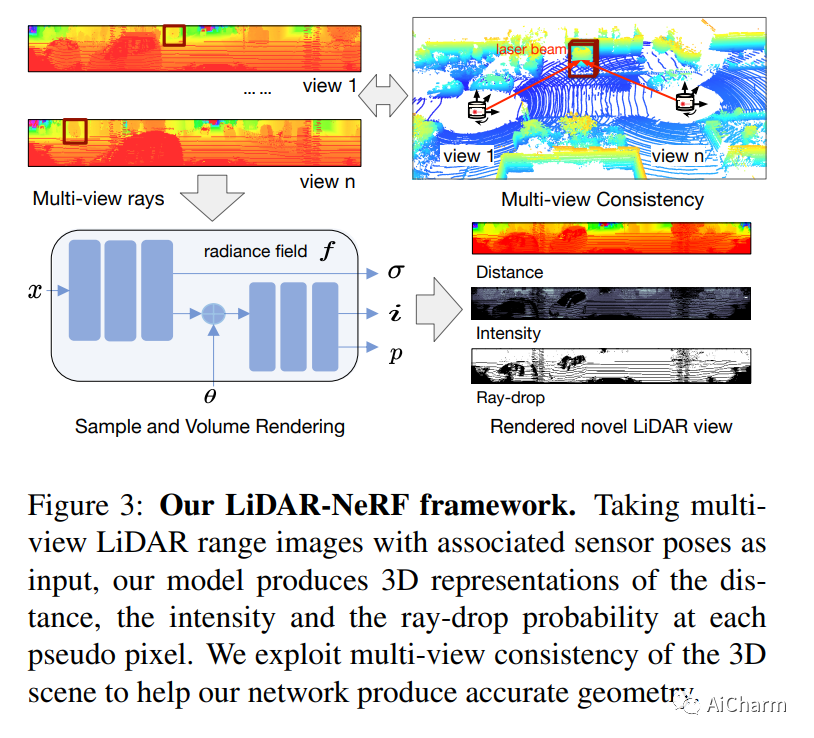

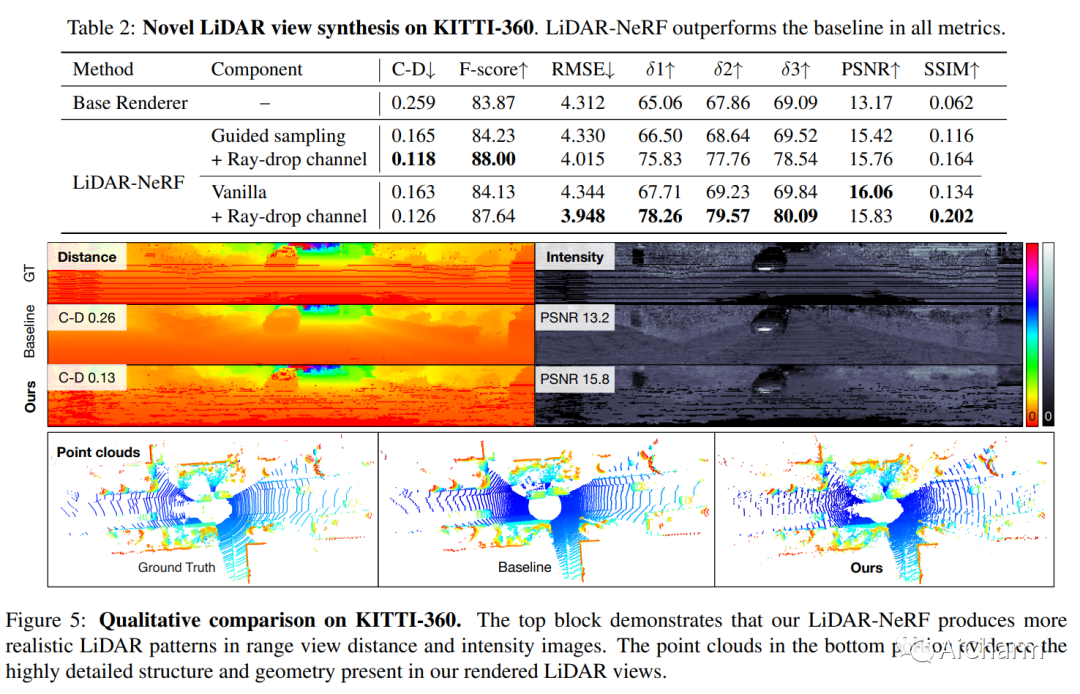

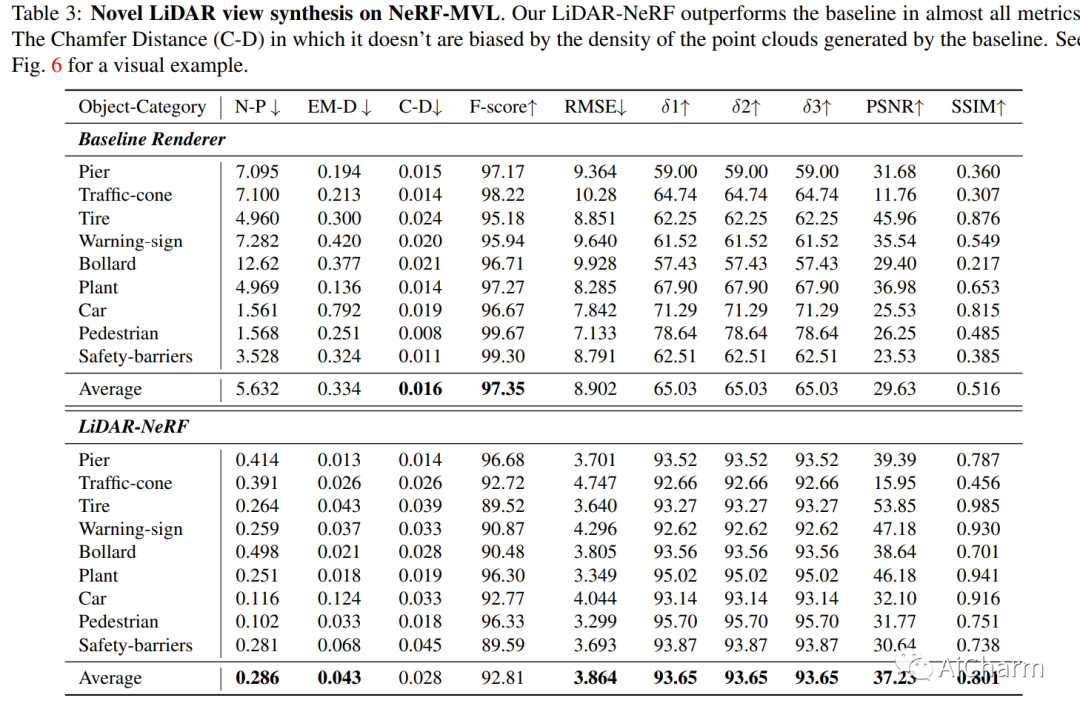

我们介绍了一项新任务,即 LiDAR 传感器的新颖视图合成。虽然带有风格迁移神经网络的传统基于模型的 LiDAR 模拟器可用于渲染新颖的视图,但它们在生成准确和逼真的 LiDAR 模式方面存在不足,因为它们所依赖的渲染器利用的是不可微分的游戏引擎。据我们所知,我们通过制定第一个可区分的 LiDAR 渲染器来解决这个问题,并提出了一个端到端的框架 LiDAR-NeRF,利用神经辐射场 (NeRF) 来共同学习几何和属性的 3D 点。为了评估我们方法的有效性,我们建立了一个以对象为中心的多视图 LiDAR 数据集,称为 NeRF-MVL。它包含从使用多个 LiDAR 传感器捕获的 360 度视点观察到的 9 个类别的对象观察结果。我们在场景级 KITTI-360 数据集和对象级 NeRF-MVL 上进行的大量实验表明,我们的 LiDAR-NeRF 显着优于基于模型的算法。

2.Tetra-NeRF: Representing Neural Radiance Fields Using Tetrahedra

标题:Tetra-NeRF:使用四面体表示神经辐射场

作者:Jonas Kulhanek, Torsten Sattler

文章链接:https://arxiv.org/abs/2304.06018

项目代码:https://jkulhanek.com/tetra-nerf

摘要:

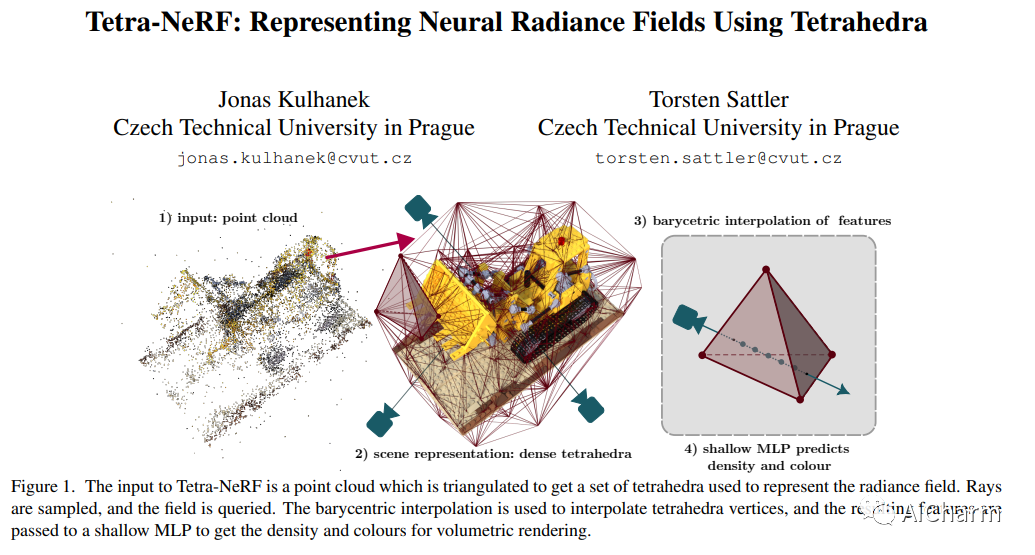

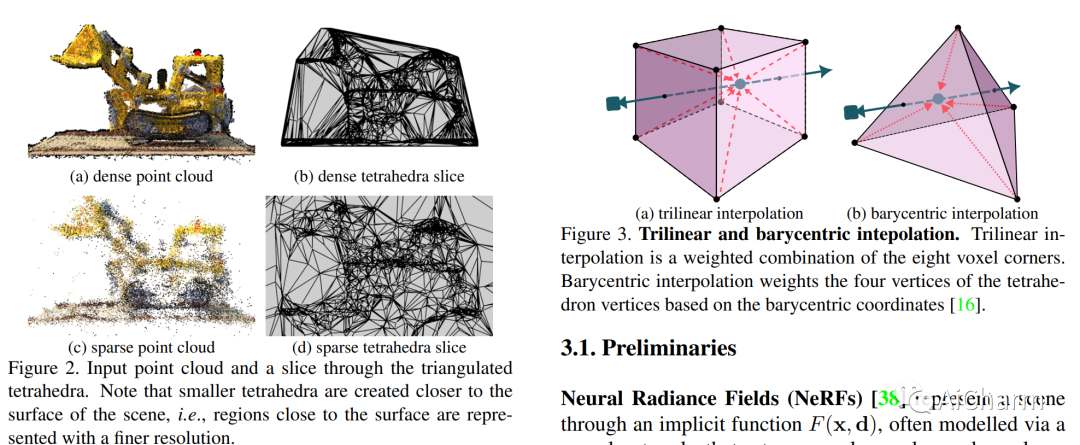

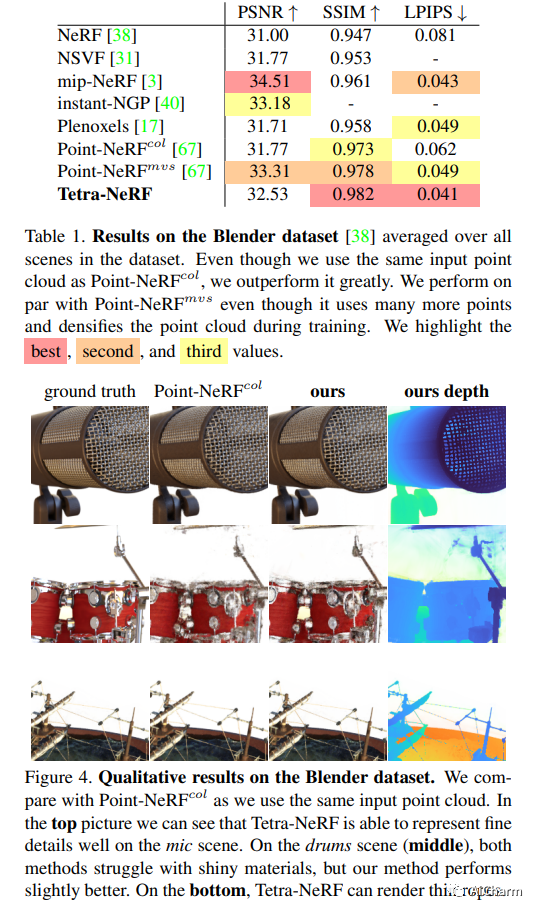

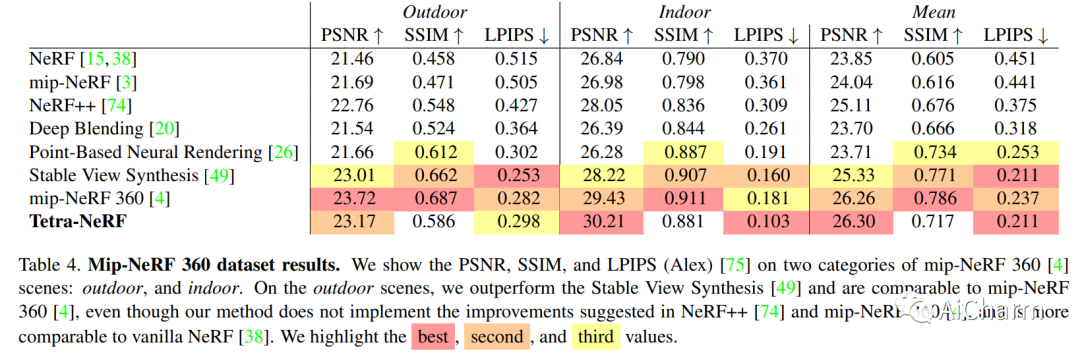

神经辐射场 (NeRFs) 是一种非常新近且非常流行的方法,用于解决新视图合成和 3D 重建问题。NeRFs 使用的一种流行的场景表示是将场景的统一的、基于体素的细分与 MLP 相结合。基于场景的(稀疏)点云通常可用的观察,本文提出使用基于四面体和 Delaunay 表示的自适应表示,而不是均匀细分或基于点的表示。我们表明,这样的表示可以进行有效的训练并产生最先进的结果。我们的方法优雅地结合了 3D 几何处理、基于三角形的渲染和现代神经辐射场的概念。与基于体素的表示相比,我们的表示提供了可能靠近表面的场景部分的更多细节。与基于点的表示相比,我们的方法实现了更好的性能。

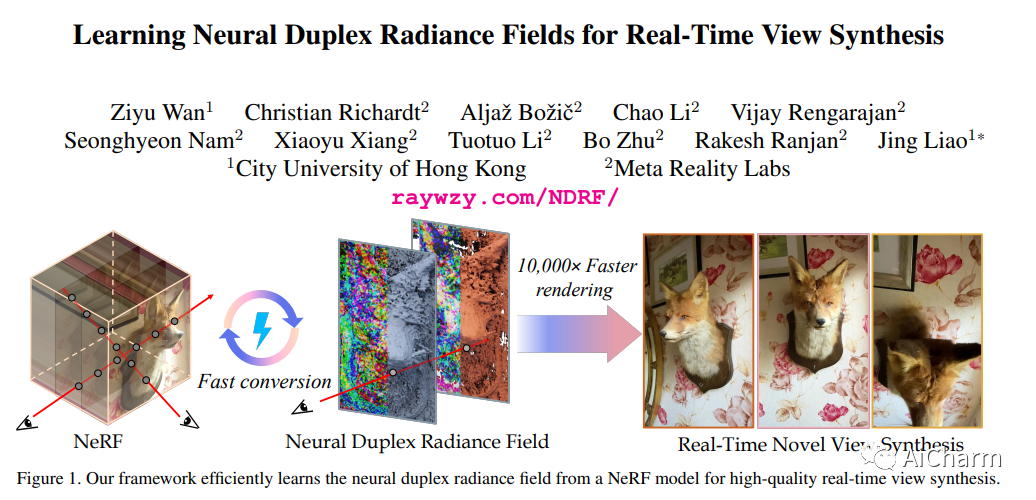

3.Learning Neural Duplex Radiance Fields for Real-Time View Synthesis(CVPR 2023)

标题:学习用于实时视图合成的神经双工辐射场

作者:Ziyu Wan, Christian Richardt, Aljaž Božič, Chao Li, Vijay Rengarajan, Seonghyeon Nam, Xiaoyu Xiang, Tuotuo Li, Bo Zhu, Rakesh Ranjan, Jing Liao

文章链接:https://arxiv.org/abs/2304.05977

项目代码:http://raywzy.com/NDRF/

摘要:

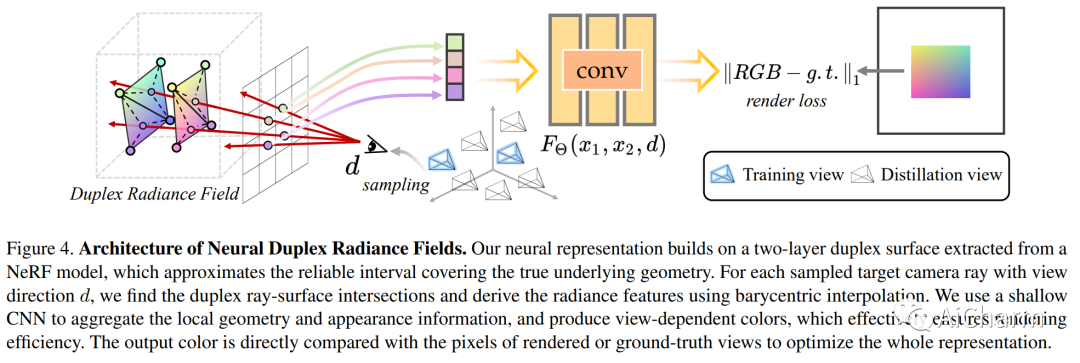

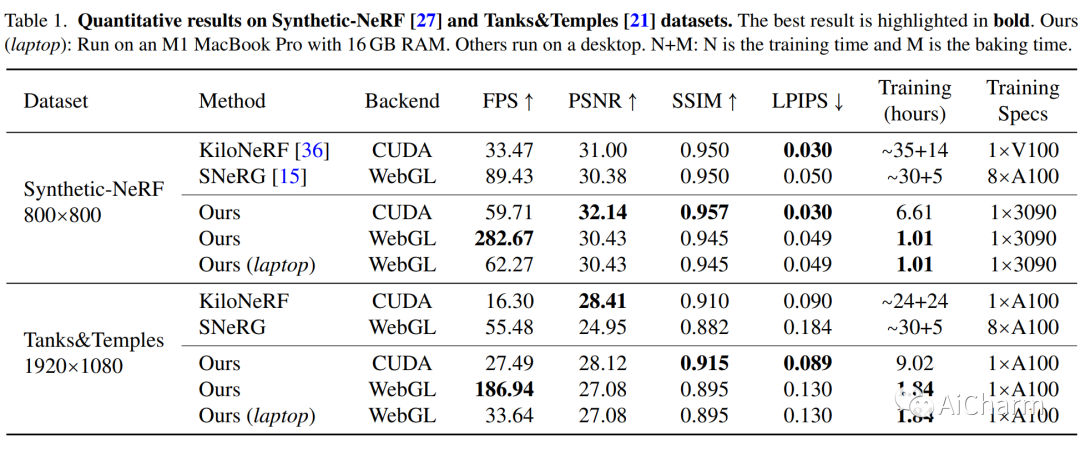

神经辐射场 (NeRF) 能够以前所未有的视觉质量实现新颖的视图合成。然而,为了渲染逼真的图像,NeRF 需要对每个像素进行数百次深度多层感知器 (MLP) 评估。这是非常昂贵的,并且使实时渲染变得不可行,即使在强大的现代 GPU 上也是如此。在本文中,我们提出了一种新颖的方法来将 NeRF 提取和烘焙为高效的基于网格的神经表示,这些表示与大规模并行图形渲染管道完全兼容。我们将场景表示为在双层双工网格上编码的神经辐射特征,通过从可靠的光线-表面相交区间学习聚合辐射信息,有效克服了 3D 表面重建中固有的不准确性。为了利用附近像素的局部几何关系,我们利用屏幕空间卷积代替 NeRF 中使用的 MLP 来实现高质量的外观。最后,整个框架的性能通过一种新颖的多视图蒸馏优化策略得到进一步提升。我们通过对一系列标准数据集的广泛实验证明了我们方法的有效性和优越性。

更多Ai资讯:公主号AiCharm