0、前言

天鹰优化的半监督拉普拉斯深度核极限学习机分类方法:首先采用拉普拉斯半监督深度ELM-AE实现抽象特征提取,然后将提取的抽象特征用来训练一个天鹰优化的核极限学习机实现分类。半监督拉普拉斯深度核极限学习机实际上是由半监督拉普拉斯多层极限学习机+KELM构成。

1、理论简介

1.1 ELMAE

ELMAE与ELM都是三层网络结构,但是ELM-AE 是无监督学习算法 , 其输出与输入一致。

ELMAE的输出权重计算公式如下:

1.2 多层极限学习机ML-ELM

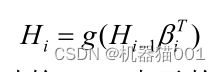

ML-ELM 使用 ELM-AE 逐层训练,ML-ELM 利用 ELM-AE 训练时,第 i 个隐层的输出和第(i-1)个隐层上的输出的数值关系可用以下公式表示:

1.3 半监督拉普拉斯深度ELM( Lap-ML-ELM)

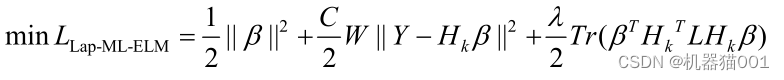

文献《拉普拉斯多层极速学习机》 把流形正则化框架引入多层极速学习机模型 , 提出了拉普拉斯多层极速学习机( Lap-ML-ELM)。Lap-ML-ELM 模型结构与 ML-ELM 相同 , 但是 Lap-ML-ELM 把标记样本和未标记样本一起训练 .Lap-ML-ELM 和ML-ELM 最大的不同之处是最后的输出权值的求法不同 :ML-ELM 是直接通过最小化最小二乘估计的广义正则化代价函数求得, Lap-ML-ELM 是利用流形正则化框架求得。

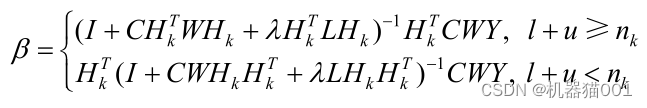

假设 Lap-ML-ELM 有 k 个隐层 , 则可通过上述公式(2) 把第 k 隐层输出Hk求得。我们通过使以下代价函数最小化求出输出权值

其中 ,nk是 Lap-ML-ELM 中第 k 个隐层的节点数。

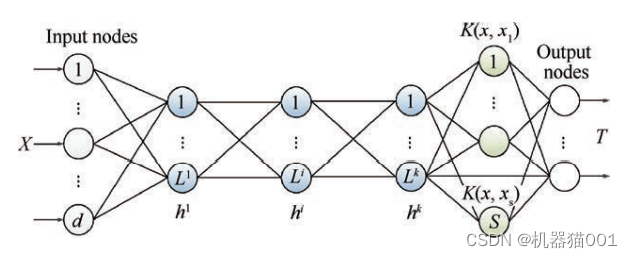

1.4 半监督拉普拉斯深度核极限学习机

半监督拉普拉斯深度核极限学习机首先利用半监督拉普拉斯深度ELM( Lap-ML-ELM)对输入数据进行逐层抽取从而得到更为有效的特征,有利于区分容易混淆的类型,提高分类精度;而基于这些更为抽象的特征而非原始的输入样本数据,利用核函数计算代替高维空间的内积运算,从而实现将特征映射到更高维空间进行决策,则有利于进一步提高分类的准确性和算法的泛化性能。半监督拉普拉斯深度核极限学习机结构如下:

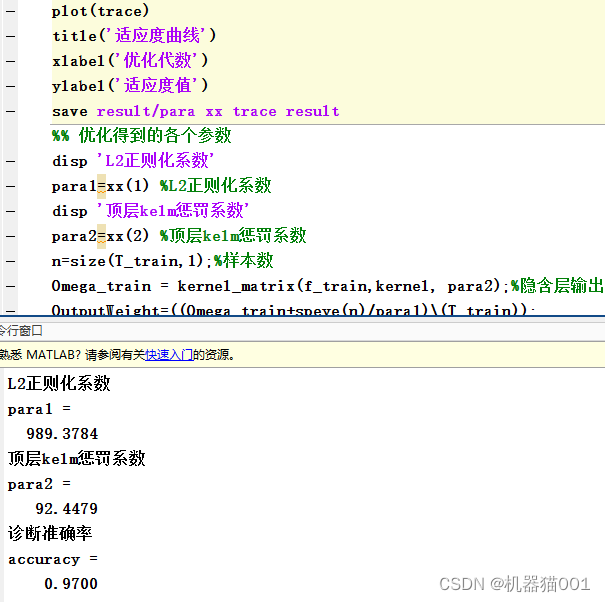

2、天鹰优化半监督拉普拉斯深度核极限学习机

考虑到半监督拉普拉斯深度核极限学习机最后分类效果受核参数影响,因此采用天鹰优化算法进行优化,适应度函数为分类精度。

3、效果对比

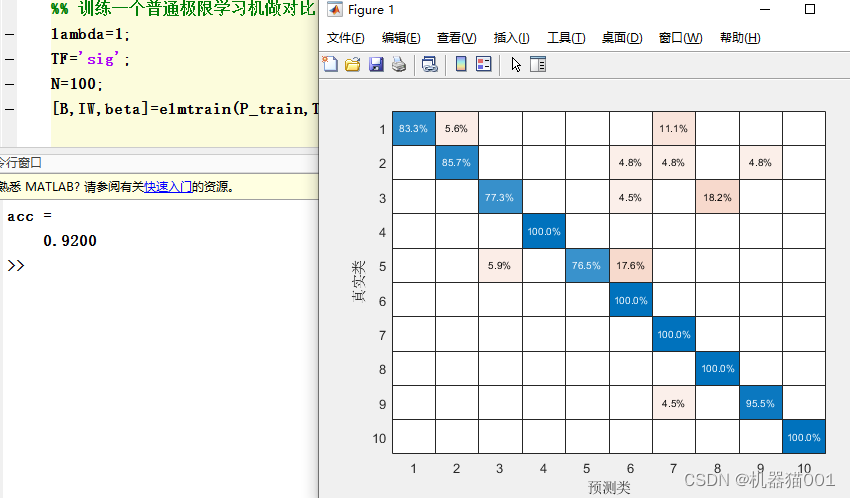

普通ELM分类效果如下:

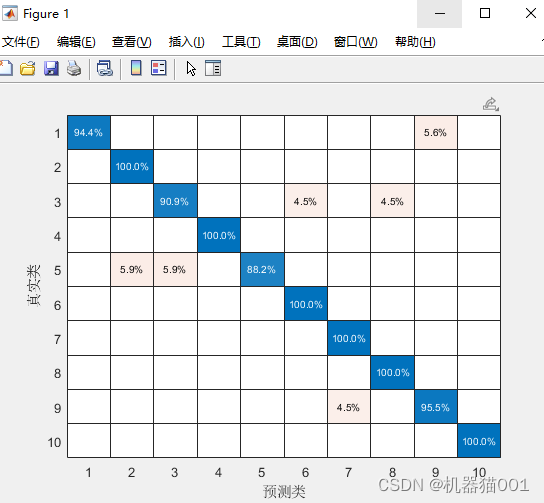

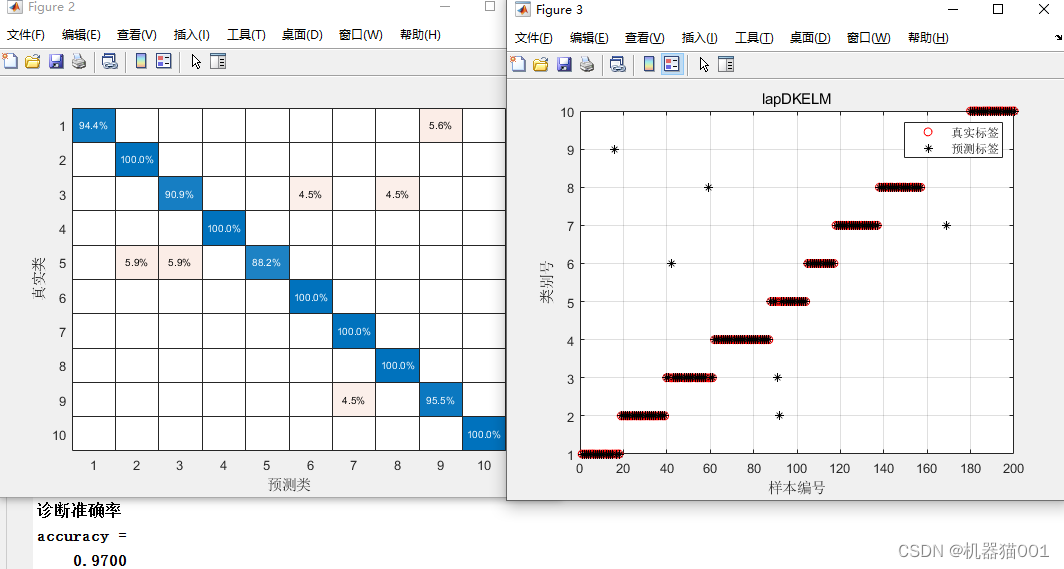

lap-ML-ELM分类效果如下:

半监督拉普拉斯深度核极限学习机分类效果如下:

可以看出半监督拉普拉斯深度核极限学习机分类精度最高。