两个现象。

第一个是高维神经网络的神经元并不是代表着某一个特征,而是所有特征混杂在所有神经元中;第二个是在原样本点上加上一些针对性的但是不易察觉的扰动,就很容易导致神经网络的分类错误。

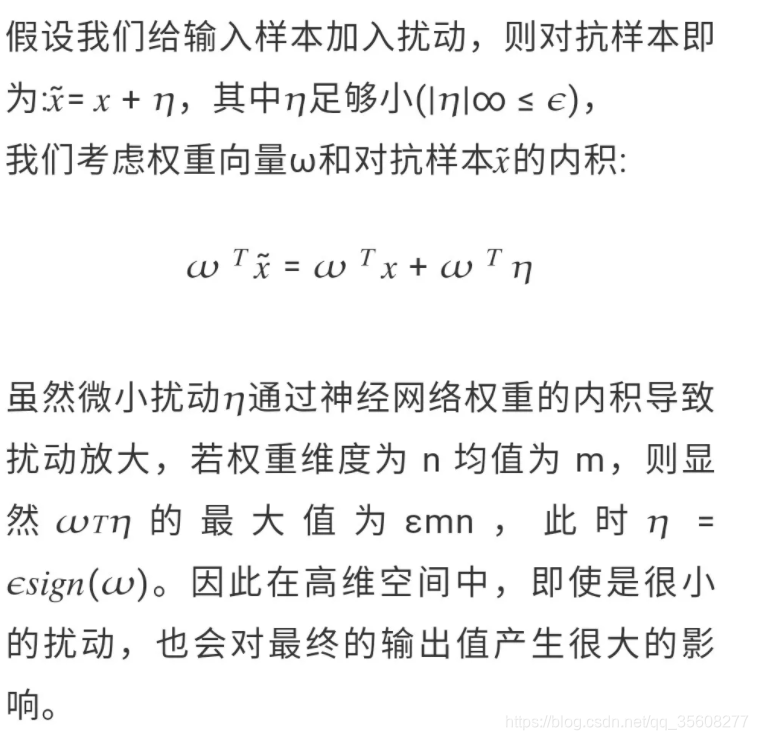

第二个性质就是对抗攻击的理论基础,后来Goodfellow 在 Explaining and Harnessing Adversarial Examples[13]中提出原因并非是深层神经网络的高度非线性和过拟合,即使是线性模型也存在对抗样本。在这篇论文中,我们可以粗浅地认为对抗攻击之所以能够成功的原因是误差放大效应:

对抗网络之目标检测应用:A-Fast-RCNN

https://blog.csdn.net/jxy0123456789/article/details/80690503?utm_medium=distribute.pc_relevant.none-task-blog-baidujs_title-3&spm=1001.2101.3001.4242

综述

https://www.jiqizhixin.com/articles/2018-03-05-4

https://zhuanlan.zhihu.com/p/37260275

攻击防御

https://zhuanlan.zhihu.com/p/136174052