时序差分(TD)学习结合了蒙特卡洛方法和动态规划的方式:

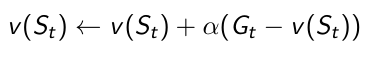

对于蒙特卡洛方法,其迭代的方式是用episode中所有的样本结果作为更新的目标,如下所示,Gt代表的是时刻t真实的回报,他是有所有根据样本得到。

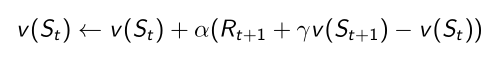

对于时序差分TD(0)则是用了其下一步状态的回报值作为 bootstrap 代替原样本的结果:

所以对于蒙特卡洛方式,TD(0)只是改变了一个地方,即用 下一状态得到的真实值 + 下一状态的估计值 v(s+1)乘上一个折扣因子 gamma 代表全样本的sample 结果。

这样的好处是,只需要通过该状态下的下一状态就能更新价值函数,而不用像蒙特卡洛一样在全部episode结束后才能更新值。

就像上面一张图一样,完全的树是DP算法的复杂度,蒙特卡洛是下面这颗树,上面这颗树是TD(0)算法的复杂度。

MC 与 TD0 对比:

强化学习 model free 蒙特卡洛增量 与 TD(0)

猜你喜欢

转载自blog.csdn.net/qq_36336522/article/details/107869246

今日推荐

周排行