我们往往能看到在对模型进行优化时,有的说用梯度下降,有的说用梯度上升,这是为什么呢。最主要是因为目标不一样,梯度下降是求局部极小值,而梯度上升是求局部最大值。

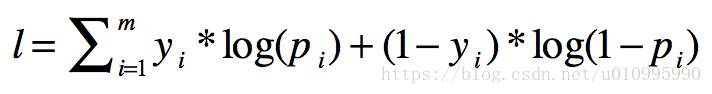

如logistic的目标函数:

这里的优化目标是出现的概率值,我们要求概率的最大值,也就是MLE(极大似然估计),所以用梯度上升法。

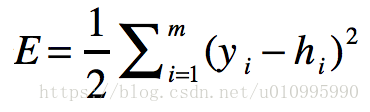

而线性回归的代价函数为:

优化的目标值是误差,我们要求误差最小值,所以使用的是梯度下降算法。

参考地址:https://blog.csdn.net/u010310527/article/details/77150888