定理:设A为n x n对称正定矩阵,其最大与最小特征值分别为

λ

1

\lambda _{1}

λ 1

λ

n

\lambda _{n}

λ n

A

x

=

b

Ax = b

A x = b

x

∗

x^{*}

x ∗

x

(

0

)

x^{(0)}

x ( 0 )

A

x

=

b

Ax = b

A x = b

∥

x

(

k

)

−

x

∗

∥

A

⩽

2

(

c

o

n

d

(

A

)

−

1

c

o

n

d

(

A

)

+

1

)

k

∥

x

(

0

)

−

x

∗

∥

A

\left \|x^{(k)}-x^{*}\right \|_{A}\leqslant 2(\frac{\sqrt{cond(A)}-1}{\sqrt{cond(A)}+1})^{k}\left \|x^{(0)}-x^*\right \|_{A}

∥ ∥ ∥ x ( k ) − x ∗ ∥ ∥ ∥ A ⩽ 2 ( c o n d ( A )

+ 1 c o n d ( A )

− 1 ) k ∥ ∥ ∥ x ( 0 ) − x ∗ ∥ ∥ ∥ A

c

o

n

d

(

A

)

2

=

λ

1

(

A

)

λ

n

(

A

)

cond(A)_2=\frac{\lambda_1(A)}{\lambda_n(A)}

c o n d ( A ) 2 = λ n ( A ) λ 1 ( A )

我们观察

(

c

o

n

d

(

A

)

−

1

c

o

n

d

(

A

)

+

1

)

k

(\frac{\sqrt{cond(A)}-1}{\sqrt{cond(A)}+1})^{k}

( c o n d ( A )

+ 1 c o n d ( A )

− 1 ) k

当

λ

1

>

>

λ

n

\lambda_1>>\lambda_n

λ 1 > > λ n

c

o

n

d

(

A

)

2

cond(A)_2

c o n d ( A ) 2

预处理被称为PCG方法(preconditioned conjugated gradient method)

既然共轭梯度法的收敛速度取决于系数矩阵的特征值,那么我们可以将

A

x

=

b

Ax = b

A x = b

A

~

x

=

b

~

\widetilde{A}x = \widetilde{b}

A

x = b

使得

A

~

x

=

b

~

\widetilde{A}x = \widetilde{b}

A

x = b

A

x

=

b

Ax = b

A x = b

A

~

\widetilde{A}

A

从而再次运用共轭梯度法求解方程组能够达到提高收敛速度的效果。

求解

A

x

=

b

Ax = b

A x = b

A

‾

=

C

−

1

A

(

C

−

1

)

T

\overline{A} = C^{-1}A (C^{-1})^T

A = C − 1 A ( C − 1 ) T

A

‾

\overline{A}

A

我们接着令

x

‾

=

C

T

x

,

b

=

C

−

1

b

\overline{x} = C^{T}x,b = C^{-1}b

x = C T x , b = C − 1 b

A

‾

x

‾

=

b

‾

\overline{A}\overline{x} = \overline{b}

A x = b

x

=

(

C

T

)

−

1

x

‾

x = (C^{T})^{-1}\overline{x}

x = ( C T ) − 1 x

已知在通过迭代法求解线性方程组的过程中,我们需要清楚每次下降的方向和下降的步长。

d

‾

(

k

+

1

)

=

d

‾

(

r

+

1

)

+

β

‾

k

d

‾

(

k

)

\overline{d}^{(k+1)}=\overline{d}^{(r+1)}+\overline{\beta}_{k}\overline{d}^{(k)}

d ( k + 1 ) = d ( r + 1 ) + β k d ( k )

通过已知的变换,我们可以得出

d

‾

(

k

)

=

C

T

d

(

k

)

\overline{d}^{(k)} = C^Td^{(k)}

d ( k ) = C T d ( k )

x

x

x

r

‾

(

k

)

=

C

−

1

r

(

k

)

\overline{r}^{(k)}=C^{-1}r^{(k)}

r ( k ) = C − 1 r ( k )

我们有:

d

(

k

+

1

)

=

C

−

T

d

‾

(

k

+

1

)

=

C

−

T

(

r

‾

(

k

+

1

)

+

β

‾

k

d

‾

(

k

)

)

d^{(k+1)}=C^{-T}\overline{d}^{(k+1)}=C^{-T}(\overline{r}^{(k+1)}+\overline{\beta}_{k}\overline{d}^{(k)})

d ( k + 1 ) = C − T d ( k + 1 ) = C − T ( r ( k + 1 ) + β k d ( k ) )

β

‾

k

=

(

r

‾

(

k

+

1

)

,

r

‾

(

k

+

1

)

)

(

r

‾

(

k

)

,

r

‾

(

k

)

)

\overline{\beta}_{k}=\frac{(\overline{r}^{(k+1)},\overline{r}^{(k+1)})}{(\overline{r}^{(k)},\overline{r}^{(k)})}

β k = ( r ( k ) , r ( k ) ) ( r ( k + 1 ) , r ( k + 1 ) )

带入求解后:

d

(

k

+

1

)

=

(

C

C

T

)

−

1

r

(

k

+

1

)

+

β

‾

k

d

(

k

)

d^{(k+1)}=(CC^T)^{-1}r^{(k+1)}+\overline{\beta}_kd^{(k)}

d ( k + 1 ) = ( C C T ) − 1 r ( k + 1 ) + β k d ( k ) 我们令

M

=

C

C

T

M = CC^{T}

M = C C T

同时我们可以得到:

β

‾

k

=

(

r

‾

(

k

+

1

)

,

r

‾

(

k

+

1

)

)

(

r

‾

(

k

)

,

r

‾

(

k

)

)

=

(

z

(

k

+

1

)

,

r

(

k

+

1

)

)

(

z

(

k

)

,

r

(

k

)

)

\overline{\beta}_{k}=\frac{(\overline{r}^{(k+1)},\overline{r}^{(k+1)})}{(\overline{r}^{(k)},\overline{r}^{(k)})}=\frac{({z}^{(k+1)},{r}^{(k+1)})}{({z}^{(k)},{r}^{(k)})}

β k = ( r ( k ) , r ( k ) ) ( r ( k + 1 ) , r ( k + 1 ) ) = ( z ( k ) , r ( k ) ) ( z ( k + 1 ) , r ( k + 1 ) )

α

‾

k

=

(

r

‾

(

k

)

,

r

‾

(

k

)

)

(

d

(

k

)

,

A

d

(

k

)

)

=

(

z

(

k

)

,

r

(

k

+

1

)

)

(

A

d

(

k

)

,

d

(

k

)

)

\overline{\alpha}_{k}=\frac{(\overline{r}^{(k)},\overline{r}^{(k)})}{({d}^{(k)},{Ad}^{(k)})}=\frac{({z}^{(k)},{r}^{(k+1)})}{(Ad^{(k)},{d}^{(k)})}

α k = ( d ( k ) , A d ( k ) ) ( r ( k ) , r ( k ) ) = ( A d ( k ) , d ( k ) ) ( z ( k ) , r ( k + 1 ) )

万事俱备后,我么就可以开始将迭代法进行下去了。

我们先构造预处理矩阵M(对称正定)

于是我们接下来的问题就是如何选取预处理矩阵M了

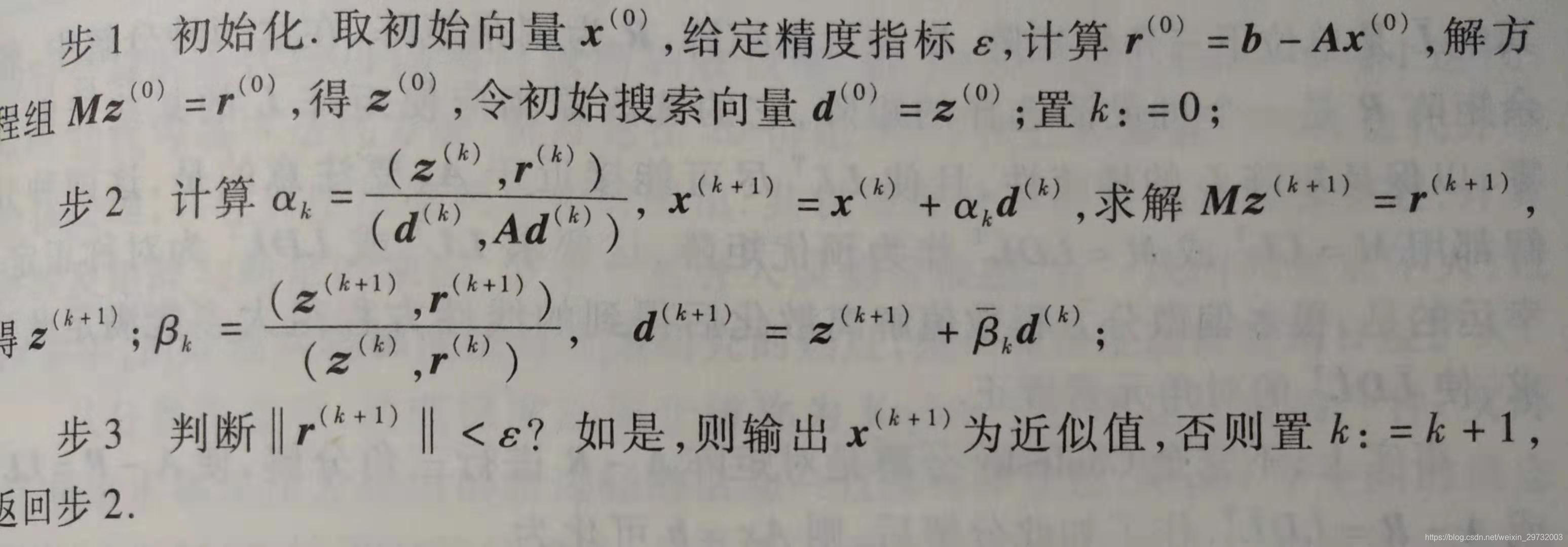

算法:

算法: